Auteur : Yiping, IOSG Ventures

écrire devant

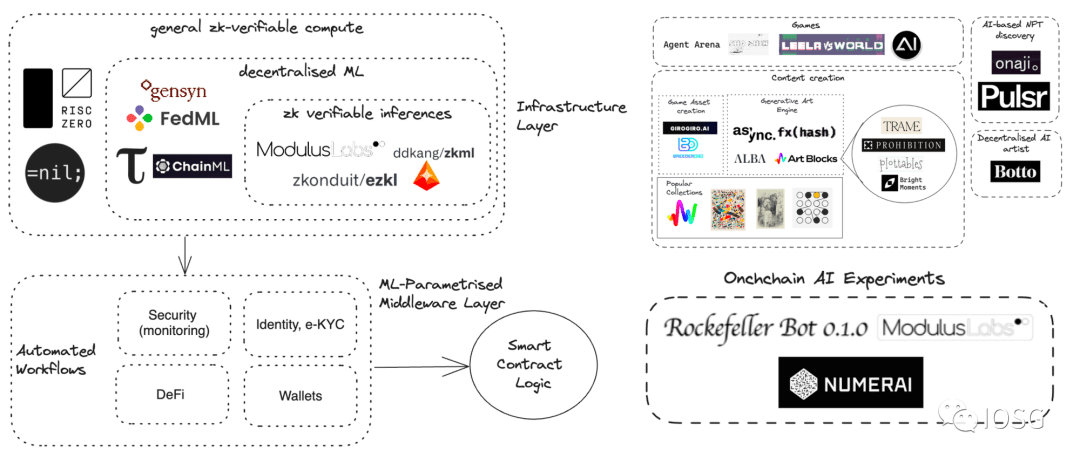

Alors que les grands modèles linguistiques (LLM) deviennent de plus en plus populaires, nous voyons de nombreux projets intégrer l’intelligence artificielle (IA) et la blockchain. La combinaison du LLM et de la blockchain augmente, et nous voyons également des opportunités pour la réintégration de l’intelligence artificielle avec la blockchain. Il convient de mentionner l’apprentissage automatique sans connaissance (ZKML).

L’intelligence artificielle et la blockchain sont deux technologies transformatrices aux caractéristiques fondamentalement différentes. L’intelligence artificielle nécessite une puissance de calcul puissante, généralement fournie par des centres de données centralisés. Bien que la blockchain assure une informatique décentralisée et une protection de la vie privée, elle fonctionne mal sur les tâches qui nécessitent un calcul et un stockage à grande échelle. Nous explorons et recherchons toujours les meilleures pratiques pour l'intégration de l'intelligence artificielle et de la blockchain. Nous vous présenterons également quelques cas de projets en cours qui combinent « IA + blockchain » dans le futur.

Source : IOSG Ventures

Ce rapport de recherche est publié en deux parties. Cet article constitue la partie supérieure. Nous nous concentrerons sur l'application du LLM dans le domaine du chiffrement et explorerons les stratégies de mise en œuvre des applications.

Qu’est-ce que le LLM ?

Un LLM (Large Language Model) est un modèle de langage informatisé constitué d'un réseau de neurones artificiels avec un grand nombre de paramètres (généralement des milliards). Ces modèles sont formés sur de grandes quantités de texte non étiqueté.

Vers 2018, la naissance du LLM a complètement changé la recherche sur le traitement du langage naturel. Contrairement aux méthodes précédentes qui nécessitent la formation d'un modèle supervisé spécifique pour une tâche spécifique, le LLM, en tant que modèle général, fonctionne bien sur une variété de tâches. Ses capacités et applications incluent :

Comprendre et résumer du texte : LLM peut comprendre et résumer de grandes quantités de langage humain et de données textuelles. Ils peuvent extraire des informations clés et générer des résumés concis.

Générer du nouveau contenu : LLM a la capacité de générer du contenu textuel. En fournissant des invites au modèle, il peut répondre à des questions, au texte nouvellement généré, aux résumés ou à l'analyse des sentiments.

Traduction : LLM peut être utilisé pour traduire entre différentes langues. Ils utilisent des algorithmes d'apprentissage profond et des réseaux de neurones pour comprendre le contexte et les relations entre les mots.

Prédire et générer du texte : LLM peut prédire et générer du texte en fonction d'un arrière-plan contextuel, similaire au contenu généré par l'homme, notamment des chansons, des poèmes, des histoires, des supports marketing, etc.

Applications dans divers domaines : les grands modèles de langage ont une large applicabilité dans les tâches de traitement du langage naturel. Ils sont utilisés dans l’IA conversationnelle, les chatbots, les soins de santé, le développement de logiciels, les moteurs de recherche, le tutorat, les outils d’écriture et bien d’autres encore.

Les avantages de LLM incluent sa capacité à comprendre de grandes quantités de données, sa capacité à effectuer plusieurs tâches liées au langage et sa capacité à adapter les résultats aux besoins des utilisateurs.

Applications courantes de modèles de langage à grande échelle

En raison de ses capacités exceptionnelles de compréhension du langage naturel, LLM a un potentiel considérable, et les développeurs se concentrent principalement sur les deux aspects suivants :

Fournir aux utilisateurs des réponses précises et à jour basées sur des données et du contenu contextuels étendus

Effectuer des tâches spécifiques assignées par les utilisateurs en utilisant différents agents et outils

Ce sont ces deux aspects qui ont conduit à la prolifération des applications LLM permettant de discuter avec XX. Par exemple, discutez avec des PDF, discutez avec des documents et discutez avec des articles universitaires.

Par la suite, des tentatives ont été faites pour fusionner le LLM avec diverses sources de données. Les développeurs ont intégré avec succès des plates-formes telles que Github, Notion et certains logiciels de prise de notes avec LLM.

Pour surmonter les limites inhérentes au LLM, différents outils sont intégrés au système. Le premier outil de ce type était un moteur de recherche, offrant à LLM la possibilité d'accéder aux connaissances les plus récentes. De nouveaux progrès intégreront des outils tels que WolframAlpha, Google Suites et Etherscan avec de grands modèles de langage.

Architecture des applications LLM

La figure ci-dessous décrit le flux d'une application LLM pour répondre aux requêtes des utilisateurs : Tout d'abord, les sources de données pertinentes sont converties en vecteurs intégrés et stockées dans une base de données vectorielles. L'adaptateur LLM utilise les requêtes des utilisateurs et les recherches de similarité pour trouver un contexte pertinent à partir de la base de données vectorielles. Le contexte pertinent est placé dans une invite et envoyé à LLM. LLM exécutera ces invites et utilisera des outils pour générer des réponses. Parfois, les LLM sont ajustés sur des ensembles de données spécifiques pour améliorer la précision et réduire les coûts.

Le flux de travail d'une candidature LLM peut être divisé en trois étapes principales :

Préparation et intégration des données : cette phase implique la conservation d'informations confidentielles (telles que les mémos de projet) pour un accès ultérieur. En règle générale, les fichiers sont segmentés et traités via un modèle d'intégration, puis stockés dans un type spécial de base de données appelé base de données vectorielle.

Formulation et extraction d'invites : lorsqu'un utilisateur soumet une demande de recherche (dans ce cas, recherche d'informations sur le projet), le logiciel crée une série d'invites et les saisit dans le modèle de langage. L'invite finale contient généralement un modèle d'invite codé en dur par le développeur du logiciel, un exemple de sortie valide sous forme d'exemple ponctuel, ainsi que tous les nombres requis obtenus à partir de l'API externe et des fichiers associés extraits de la base de données vectorielles.

Exécution et inférence des invites : une fois les invites terminées, elles sont transmises à un modèle de langage préexistant à des fins d'inférence, qui peut inclure des API de modèles propriétaires, des modèles open source ou des modèles affinés individuellement. À ce stade, certains développeurs peuvent également intégrer des systèmes d'exploitation (tels que la journalisation, la mise en cache et la validation) dans le système.

Apporter le LLM à la cryptographie

Bien que le domaine du chiffrement (Web3) ait des applications similaires à celles du Web2, le développement de bonnes applications LLM dans le domaine du chiffrement nécessite une prudence particulière.

L’écosystème crypto est unique, avec sa propre culture, ses propres données et sa propre convergence. Les LLM affinés sur ces ensembles de données cryptographiquement restreints peuvent fournir des résultats supérieurs à un coût relativement faible. Bien que les données soient abondamment disponibles, il existe un manque flagrant d’ensembles de données ouvertes sur des plateformes comme HuggingFace. Actuellement, il n’existe qu’un seul ensemble de données relatives aux contrats intelligents, qui contient 113 000 contrats intelligents.

Les développeurs sont également confrontés au défi d'intégrer différents outils dans LLM. Ces outils sont différents de ceux utilisés dans Web2 et donnent à LLM la possibilité d'accéder aux données liées aux transactions, d'interagir avec des applications décentralisées (Dapps) et d'exécuter des transactions. Jusqu'à présent, nous n'avons trouvé aucune intégration de Dapps dans Langchain.

Bien que le développement d’applications LLM cryptographiques de haute qualité puisse nécessiter des investissements supplémentaires, le LLM constitue un choix naturel pour le monde de la cryptographie. Ce domaine fournit des données riches, propres et structurées. Couplé au fait que le code Solidity est généralement concis et clair, cela permet à LLM de générer plus facilement du code fonctionnel.

Dans la « Partie 2 », nous discuterons de 8 directions potentielles dans lesquelles le LLM peut aider le domaine de la blockchain, telles que :

Intégrer les capacités IA/LLM intégrées dans la blockchain

Analyser les enregistrements de transactions à l'aide de LLM

Identifiez les robots potentiels à l’aide de LLM

Écrire du code avec LLM

Lire du code avec LLM

Aidez la communauté avec LLM

Suivez le marché avec LLM

Analyser des projets à l'aide du LLM