Auteur original : YBB Capital Zeke

Préface

Le 16 février, OpenAI a annoncé le dernier modèle de diffusion de génération vidéo contrôlée par texte « Sora », qui a démontré un autre moment marquant dans l'IA générative grâce à plusieurs vidéos générées de haute qualité couvrant un large éventail de types de données visuelles. Contrairement aux outils de génération vidéo d'IA tels que Pika, qui sont encore en train de générer quelques secondes de vidéo à partir de plusieurs images, Sora réalise une génération vidéo évolutive en s'entraînant dans l'espace latent compressé des vidéos et des images, en les décomposant en patchs de localisation spatio-temporels. . De plus, le modèle reflète également la capacité à simuler le monde physique et le monde numérique. La démo de 60 secondes finalement présentée n'est pas exagérée de dire qu'il s'agit d'un « simulateur universel du monde physique ».

En termes de méthode de construction, Sora poursuit le chemin technique de « données sources-Transformateur-Diffusion-émergence » du modèle GPT précédent, ce qui signifie que son développement mature nécessite également de la puissance de calcul en tant que moteur, et parce que la quantité de données requise pour la formation vidéo est beaucoup plus volumineuse que le texte La quantité de données de formation augmentera encore la demande de puissance de calcul. Cependant, nous avons déjà discuté de l'importance de la puissance de calcul à l'ère de l'IA dans notre article précédent (Aperçu de Potential Track: Decentralized Computing Power Market), et avec la récente montée en popularité de l'IA, il existe déjà un grand nombre Des projets de puissance de calcul sur le marché ont commencé à émerger, et d'autres projets Depin (stockage, puissance de calcul, etc.) qui en bénéficiaient passivement ont également connu un essor. Donc, en plus de Depin, avec quel genre d’étincelles l’intersection du Web3 et de l’IA peut-elle entrer en collision ? Quelles autres opportunités cette piste contient-elle ? L’objectif principal de cet article est de mettre à jour et de compléter les articles précédents, et de réfléchir aux possibilités du Web3 à l’ère de l’IA.

Trois orientations majeures dans l'histoire du développement de l'IA

L'intelligence artificielle (Intelligence artificielle) est une science et une technologie émergentes conçues pour simuler, développer et améliorer l'intelligence humaine. Depuis sa naissance dans les années 1950 et 1960, l’intelligence artificielle a connu plus d’un demi-siècle de développement et est aujourd’hui devenue une technologie importante qui favorise les changements dans la vie sociale et dans tous les domaines. Dans ce processus, le développement étroitement lié des trois principales directions de recherche que sont le symbolisme, le connexionnisme et le behaviorisme est devenu aujourd’hui la pierre angulaire du développement rapide de l’IA.

Symbolisme

Également connu sous le nom de logicisme ou régularisme, c'est la conviction qu'il est possible de simuler l'intelligence humaine en traitant des symboles. Cette méthode utilise des symboles pour représenter et faire fonctionner des objets, des concepts et leurs relations dans le domaine du problème, et utilise le raisonnement logique pour résoudre des problèmes, en particulier dans les systèmes experts et la représentation des connaissances, ce qui a donné des résultats remarquables. L'idée centrale du symbolisme est qu'un comportement intelligent peut être obtenu grâce au fonctionnement de symboles et à un raisonnement logique, où les symboles représentent un degré élevé d'abstraction du monde réel ;

Connexionnisme

Ou appelée méthode des réseaux neuronaux, elle vise à atteindre l’intelligence en imitant la structure et la fonction du cerveau humain. Cette méthode permet d'apprendre en construisant un réseau de nombreuses unités de traitement simples (semblables aux neurones) et en ajustant la force des connexions entre ces unités (semblables aux synapses). Le connexionnisme met particulièrement l'accent sur la capacité d'apprendre et de généraliser à partir de données et est particulièrement adapté aux problèmes de reconnaissance de formes, de classification et de cartographie entrée-sortie continue. L'apprentissage profond, en tant que développement du connexionnisme, a réalisé des percées dans des domaines tels que la reconnaissance d'images, la reconnaissance vocale et le traitement du langage naturel ;

Behaviorisme

Le behaviorisme est étroitement lié à la recherche sur la robotique bionique et les systèmes intelligents autonomes, soulignant que les agents intelligents peuvent apprendre en interagissant avec l'environnement. Contrairement aux deux premiers, le behaviorisme ne se concentre pas sur la simulation de représentations internes ou de processus de pensée, mais plutôt sur la réalisation d'un comportement adaptatif à travers des cycles de perception et d'action. Le behaviorisme estime que l'intelligence se démontre par une interaction dynamique et un apprentissage avec l'environnement. Cette méthode est particulièrement efficace lorsqu'elle est appliquée aux robots mobiles et aux systèmes de contrôle adaptatifs qui doivent agir dans des environnements complexes et imprévisibles.

Bien qu'il existe des différences essentielles entre ces trois directions de recherche, dans la recherche et les applications réelles de l'IA, elles peuvent également interagir et s'intégrer pour promouvoir conjointement le développement du domaine de l'IA.

Présentation du principe AIGC

L'IA générative (Artificial Intelligence Generated Content, AIGC), qui connaît actuellement un développement explosif, est une évolution et une application du connexionnisme. L'AIGC peut imiter la créativité humaine pour générer du contenu nouveau. Ces modèles sont entraînés à l’aide de grands ensembles de données et d’algorithmes d’apprentissage en profondeur pour apprendre les structures, relations et modèles sous-jacents présents dans les données. Générez une sortie nouvelle et unique basée sur les invites de saisie de l'utilisateur, notamment des images, des vidéos, du code, de la musique, des conceptions, des traductions, des réponses aux questions et du texte. L’AIGC actuel est essentiellement composé de trois éléments : le Deep Learning (DL), le big data et la puissance de calcul à grande échelle.

apprentissage profond

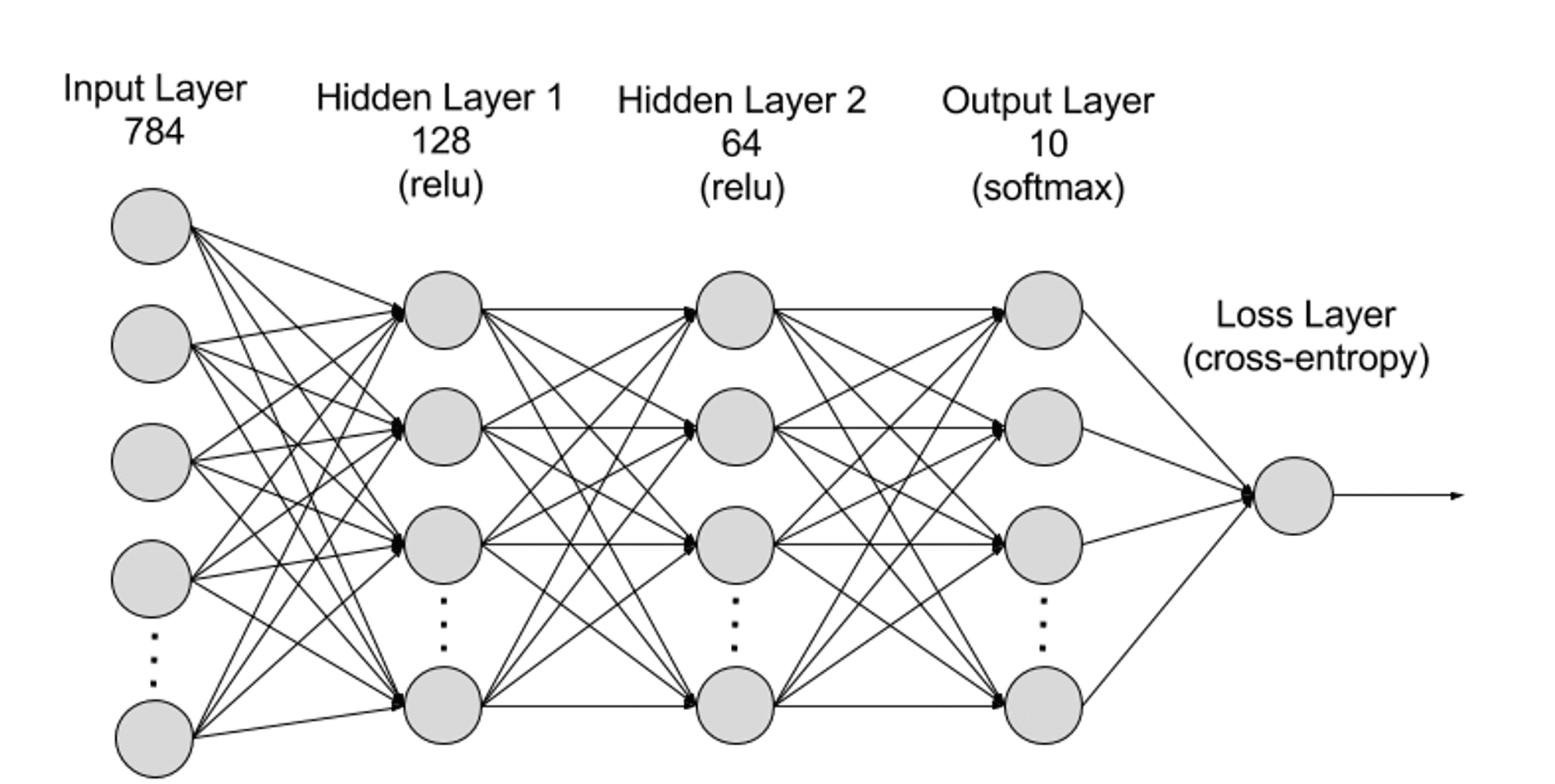

L'apprentissage profond est un sous-domaine de l'apprentissage automatique (ML), et les algorithmes d'apprentissage profond sont des réseaux de neurones calqués sur le modèle du cerveau humain. Par exemple, le cerveau humain contient des millions de neurones interconnectés qui travaillent ensemble pour apprendre et traiter les informations. De même, les réseaux de neurones d’apprentissage profond (ou réseaux de neurones artificiels) sont composés de plusieurs couches de neurones artificiels travaillant ensemble à l’intérieur d’un ordinateur. Les neurones artificiels sont des modules logiciels appelés nœuds qui utilisent des calculs mathématiques pour traiter les données. Les réseaux de neurones artificiels sont des algorithmes d'apprentissage profond qui utilisent ces nœuds pour résoudre des problèmes complexes.

Les réseaux de neurones peuvent être divisés en couche d'entrée, couche cachée et couche de sortie à partir d'un niveau hiérarchique, et les paramètres sont connectés entre différentes couches.

Couche d'entrée : la couche d'entrée est la première couche du réseau neuronal et est responsable de la réception des données d'entrée externes. Chaque neurone de la couche d'entrée correspond à une caractéristique des données d'entrée. Par exemple, lors du traitement de données d'image, chaque neurone peut correspondre à une valeur de pixel dans l'image ;

Couche cachée : la couche d'entrée traite les données et les transmet à d'autres couches du réseau neuronal. Ces couches cachées traitent les informations à différents niveaux, ajustant leur comportement à mesure qu’elles reçoivent de nouvelles informations. Les réseaux d’apprentissage profond comportent des centaines de couches cachées et peuvent être utilisés pour analyser les problèmes sous de nombreux angles différents. Par exemple, si l’on vous donne l’image d’un animal inconnu que vous devez classer, vous pouvez la comparer à des animaux que vous connaissez déjà. Par exemple, vous pouvez déterminer de quel type d’animal il s’agit grâce à la forme de ses oreilles, au nombre de pattes et à la taille de ses pupilles. Les couches cachées des réseaux neuronaux profonds fonctionnent de la même manière. Si un algorithme d'apprentissage profond tente de classer l'image d'un animal, chacune de ses couches cachées traitera une caractéristique différente de l'animal et tentera de le classer avec précision ;

Couche de sortie : la couche de sortie est la dernière couche du réseau neuronal et est responsable de la génération de la sortie du réseau. Chaque neurone de la couche de sortie représente une catégorie ou une valeur de sortie possible. Par exemple, dans un problème de classification, chaque neurone de la couche de sortie peut correspondre à une catégorie, tandis que dans un problème de régression, la couche de sortie peut n'avoir qu'un seul neurone dont la valeur représente le résultat de la prédiction ;

Paramètres : dans les réseaux de neurones, les connexions entre les différentes couches sont représentées par des paramètres de pondération et de biais, qui sont optimisés pendant le processus de formation pour permettre au réseau d'identifier avec précision les modèles dans les données et de faire des prédictions. L'augmentation des paramètres peut améliorer la capacité du modèle du réseau neuronal, c'est-à-dire la capacité du modèle à apprendre et à représenter des modèles complexes dans les données. Mais en conséquence, l’augmentation des paramètres augmentera la demande de puissance de calcul.

mégadonnées

Pour être formés efficacement, les réseaux de neurones nécessitent généralement de grandes quantités de données diverses, de haute qualité et multi-sources. C'est la base de la formation et de la validation des modèles d'apprentissage automatique. En analysant le Big Data, les modèles d'apprentissage automatique peuvent apprendre des modèles et des relations dans les données pour effectuer des prédictions ou des classifications.

Puissance de calcul à grande échelle

La structure complexe multicouche du réseau neuronal, un grand nombre de paramètres, les exigences de traitement du Big Data et les méthodes de formation itératives (dans la phase de formation, le modèle doit être itéré à plusieurs reprises, et pendant le processus de formation, la propagation vers l'avant et vers l'arrière propagation sont nécessaires pour chaque calcul de couche, y compris le calcul de la fonction d'activation, le calcul de la fonction de perte, le calcul du gradient et la mise à jour du poids), les exigences de calcul de haute précision, les capacités de calcul parallèle, les techniques d'optimisation et de régularisation, ainsi que les processus d'évaluation et de vérification du modèle conduisent conjointement à son demande de puissance de calcul élevée.

Sora

En tant que dernier modèle d'IA de génération vidéo publié par OpenAI, Sora représente une avancée considérable dans la capacité de l'intelligence artificielle à traiter et à comprendre diverses données visuelles. En utilisant un réseau de compression vidéo et une technologie de patch spatio-temporel, Sora est capable de convertir des données visuelles massives capturées par différents appareils du monde entier en une représentation unifiée, permettant ainsi un traitement et une compréhension efficaces de contenus visuels complexes. S'appuyant sur le modèle de diffusion conditionné par le texte, Sora peut générer des vidéos ou des images hautement adaptées basées sur des invites textuelles, faisant preuve d'une créativité et d'une adaptabilité extrêmement élevées.

Cependant, bien que Sora ait fait des percées dans la génération vidéo et la simulation des interactions du monde réel, il reste confronté à certaines limites, notamment la précision de la simulation du monde physique, la cohérence de la génération vidéo longue, la compréhension des instructions textuelles complexes et l'efficacité de la formation et de la génération. Et Sora atteint essentiellement une esthétique violente grâce à l'ancienne voie technologique du « Big Data-Transformer-Diffusion-Emergence » grâce à la puissance de calcul de niveau monopolistique d'OpenAI et à l'avantage du premier arrivé. D'autres sociétés d'IA doivent encore passer par des détours techniques. .

Bien que Sora n’ait pas grand-chose à voir avec la blockchain, je pense personnellement que cela sera possible dans un ou deux ans. Parce que l'influence de Sora forcera d'autres outils de génération d'IA de haute qualité à émerger et à se développer rapidement, et rayonnera sur de nombreux domaines tels que GameFi, les réseaux sociaux, les plateformes de création et Depin au sein de Web3, il est nécessaire d'avoir une compréhension générale de Sora. La manière dont l’IA sera efficacement combinée avec le Web3 à l’avenir est peut-être un point clé auquel nous devons réfléchir.

Quatre grandes voies de l'IA x Web3

Comme mentionné ci-dessus, nous pouvons savoir que le fondement sous-jacent requis pour l’IA générative ne repose en réalité que sur trois points : l’algorithme, les données et la puissance de calcul. En revanche, du point de vue de la polyvalence et des effets de génération, l’IA est un outil qui subvertit le monde. méthode de production. Le rôle principal de la blockchain est double : la reconstruction des relations de production et la décentralisation. Par conséquent, je pense personnellement qu’il existe quatre chemins qui peuvent être générés par la collision des deux :

Puissance de calcul décentralisée

Étant donné que des articles connexes ont été écrits dans le passé, l'objectif principal de ce paragraphe est de mettre à jour l'état actuel de la piste de puissance de calcul. Lorsqu’il s’agit d’IA, la puissance de calcul est toujours un facteur incontournable. La demande de puissance de calcul de l’IA est si grande qu’elle était inimaginable après la naissance de Sora. Récemment, lors du Forum économique mondial 2024 à Davos, en Suisse, le PDG d'OpenAI, Sam Altman, a déclaré sans ambages que la puissance de calcul et l'énergie sont les plus gros obstacles à ce stade, et que leur importance à l'avenir sera même égale à celle de la monnaie. Le 10 février, Sam Altman a annoncé sur Twitter un plan extrêmement étonnant visant à lever 7 000 milliards de dollars américains (l’équivalent de 40 % du PIB national de la Chine en 2023) pour réécrire le modèle actuel de l’industrie mondiale des semi-conducteurs. Lorsque j'écrivais des articles sur la puissance de calcul, mon imagination se limitait encore aux blocus nationaux et aux monopoles géants. De nos jours, il est vraiment fou qu'une seule entreprise veuille contrôler l'industrie mondiale des semi-conducteurs.

Par conséquent, l’importance de la puissance de calcul décentralisée va de soi. Les caractéristiques de la blockchain peuvent en effet résoudre le problème actuel du monopole extrême de la puissance de calcul et de l’achat coûteux de GPU dédiés. Du point de vue des besoins de l'IA, l'utilisation de la puissance de calcul peut être divisée en deux directions : l'inférence et la formation. Il n'existe actuellement que quelques projets axés sur la formation, allant de la nécessité de réseaux décentralisés à la conception de réseaux neuronaux. le besoin d'ultra-matériel La forte demande est destinée à être une direction avec un seuil extrêmement élevé et extrêmement difficile à mettre en œuvre. Le raisonnement est relativement simple. D'une part, la conception du réseau décentralisé n'est pas compliquée, et d'autre part, les besoins en matériel et en bande passante sont faibles, ce qui est actuellement considéré comme une orientation relativement courante.

L'espace d'imagination du marché centralisé de la puissance de calcul est immense, et il est souvent lié au mot-clé « niveau billion ». C'est également le sujet le plus fréquemment médiatisé à l'ère de l'IA. Cependant, à en juger par le grand nombre de projets apparus récemment, la plupart d'entre eux se précipitent encore sur les étagères pour gagner en popularité. Tenant toujours haut le bon étendard de la décentralisation, mais gardant le silence sur l'inefficacité des réseaux décentralisés. De plus, il existe un haut degré d'homogénéité dans la conception et un grand nombre de projets sont très similaires (conception L2 en un clic plus conception minière), ce qui peut éventuellement conduire à une situation où il est difficile d'obtenir une part de l'IA traditionnelle. piste.

Algorithme et système de collaboration modèle

Les algorithmes d'apprentissage automatique font référence à ces algorithmes qui peuvent apprendre des règles et des modèles à partir de données et faire des prédictions ou des décisions en fonction de ceux-ci. Les algorithmes sont à forte intensité technologique car leur conception et leur optimisation nécessitent une expertise approfondie et une innovation technologique. Les algorithmes sont au cœur de la formation des modèles d’IA et définissent la manière dont les données sont transformées en informations ou décisions utiles. Les algorithmes d'IA générative les plus courants tels que Generative Adversarial Network (GAN), Variational Autoencoder (VAE) et Transformer sont chacun conçus pour un domaine spécifique (tel que la peinture, la reconnaissance linguistique, la traduction et la génération vidéo) ou nés dans un but précis. , puis entraînez un modèle d'IA dédié via des algorithmes.

Il existe donc de nombreux algorithmes et modèles, chacun ayant ses propres mérites. Pouvons-nous les intégrer dans un modèle qui peut être à la fois civil et militaire ? Bittensor, qui est devenu très populaire récemment, est le leader dans cette direction. Il utilise des incitations minières pour permettre à différents modèles et algorithmes d'IA de collaborer et d'apprendre les uns des autres, créant ainsi des modèles d'IA plus efficaces et plus polyvalents. Commune AI (collaboration de code), etc., se concentre également sur cette direction. Cependant, pour les entreprises d'IA actuelles, les algorithmes et les modèles sont leurs propres gardiens et ne seront pas empruntés à volonté.

Par conséquent, le récit de l'écologie collaborative de l'IA est très nouveau et intéressant. L'écosystème collaboratif profite de la blockchain pour intégrer les inconvénients de l'îlot d'algorithmes d'IA, mais on ne sait pas encore s'il peut créer la valeur correspondante. Après tout, les algorithmes et modèles fermés des principales sociétés d'IA ont une très forte capacité de mise à jour, d'itération et d'intégration. Par exemple, en moins de deux ans de développement, OpenAI est passé des premiers modèles de génération de texte à des modèles générés dans plusieurs domaines. Des projets tels que Bittensor ont fait de grands progrès en matière de modèles et d'algorithmes. Les domaines ciblés peuvent nécessiter de nouvelles approches.

Big data décentralisé

D'un point de vue simple, l'utilisation de données privées pour alimenter l'IA et l'étiquetage des données sont des orientations très cohérentes avec la blockchain. Il vous suffit de prêter attention à la manière de prévenir les données indésirables et les actes malveillants, et le stockage de données peut également utiliser FIL, AR Attendre. le projet Depin en bénéficiera. D'un point de vue complexe, l'utilisation des données blockchain pour l'apprentissage automatique (ML) afin de résoudre l'accessibilité des données blockchain est également une direction intéressante (l'une des directions d'exploration de Gizeh).

En théorie, les données de la blockchain sont accessibles à tout moment et reflètent l’état de l’ensemble de la blockchain. Mais pour ceux qui ne font pas partie de l’écosystème blockchain, accéder à ces quantités massives de données n’est pas facile. Stocker une blockchain dans son intégralité nécessite une expertise approfondie et une grande quantité de ressources matérielles dédiées. Pour surmonter les défis liés à l’accès aux données blockchain, plusieurs solutions ont émergé dans l’industrie. Par exemple, les fournisseurs RPC accèdent aux nœuds via des API, tandis que les services d'indexation rendent possible l'extraction de données via SQL et GraphQL, qui jouent tous deux un rôle clé dans la résolution du problème. Ces méthodes présentent cependant des limites. Les services RPC ne conviennent pas aux scénarios d'utilisation à haute densité qui nécessitent de grandes quantités de requêtes de données et ne peuvent souvent pas répondre à la demande. Dans le même temps, bien que le service d'indexation offre une manière plus structurée de récupérer des données, la complexité du protocole Web3 rend extrêmement difficile la création de requêtes efficaces, nécessitant parfois l'écriture de centaines, voire de milliers de lignes de code complexe. Cette complexité constitue un énorme obstacle pour les praticiens généralistes des données et pour ceux qui ne comprennent pas en profondeur les détails du Web3. L’effet cumulatif de ces limitations met en évidence la nécessité de trouver un moyen plus simple d’obtenir et d’utiliser les données de la blockchain, ce qui pourrait favoriser une adoption et une innovation plus larges dans ce domaine.

Ensuite, en combinant des données blockchain de haute qualité avec ZKML (apprentissage automatique sans connaissance, réduisant le fardeau de l'apprentissage automatique sur la chaîne), il peut être possible de créer un ensemble de données qui résout le problème de l'accessibilité de la blockchain, et l'IA peut considérablement réduire le coût de la blockchain pour l'accessibilité des données, de sorte qu'au fil du temps, les développeurs, les chercheurs et les passionnés du domaine du ML puissent accéder à des ensembles de données plus pertinents et de meilleure qualité pour créer des solutions efficaces et innovantes.

Dapp doté de l'IA

Depuis que ChatGPT 3 est devenu populaire en 2023, le Dapp basé sur l'IA est devenu une direction très courante. L'IA générative extrêmement polyvalente est accessible via l'API, simplifiant et analysant ainsi intelligemment les plateformes de données, les robots de trading, les encyclopédies blockchain et d'autres applications. D'un autre côté, vous pouvez également agir comme un chatbot (comme Myshell) ou un compagnon d'IA (Sleepless AI), ou même créer des PNJ dans des jeux en chaîne grâce à l'IA générative. Cependant, comme les barrières techniques sont très faibles, la plupart d’entre elles sont affinées après l’accès à une API, et l’intégration avec le projet lui-même n’est pas parfaite, c’est pourquoi elle est rarement mentionnée.

Mais après l’arrivée de Sora, je pense personnellement que l’orientation de l’IA vers GameFi (y compris le Metaverse) et la plateforme de création sera au centre de la prochaine étape. En raison de la nature ascendante du domaine du Web3, il sera certainement difficile de produire des produits qui concurrencent les jeux traditionnels ou les entreprises créatives, et l'émergence de Sora est susceptible de résoudre ce dilemme (peut-être dans seulement deux à trois ans). À en juger par la démo de Sora, elle a déjà le potentiel de rivaliser avec les sociétés de micro-courts métrages. La culture communautaire active du Web3 peut également donner naissance à un grand nombre d'idées intéressantes lorsque la restriction n'est que l'imagination, l'industrie ascendante et. Les barrières descendantes entre les industries traditionnelles seront supprimées.

Conclusion

À mesure que les outils d’IA générative continuent de progresser, nous connaîtrons à l’avenir davantage de « moments iPhone » qui feront date. Bien que beaucoup de gens se moquent de la combinaison de l'IA et du Web3, en fait, je pense qu'il n'y a pratiquement aucun problème avec la direction actuelle. Il n'y a en fait que trois problèmes à résoudre, à savoir la nécessité, l'efficacité et l'adéquation. Bien que l'intégration des deux soit au stade exploratoire, cela n'empêche pas cette piste de devenir le courant dominant du prochain marché haussier.

Toujours maintenir suffisamment de curiosité et d'acceptation pour les nouveautés est une mentalité incontournable pour nous. Historiquement, le changement de voitures pour remplacer les calèches est devenu une fatalité en un instant, tout comme les inscriptions et les NFT dans le passé. trop de préjugés. Vous ne ferez que manquer l'occasion.