O crescente problema de confiabilidade na inteligência artificial

Nos últimos anos, notei algo interessante sobre inteligência artificial. A tecnologia está se tornando incrivelmente poderosa, mas ao mesmo tempo há um problema silencioso que a maioria das pessoas não fala o suficiente. A IA pode soar muito confiante mesmo quando está errada. Qualquer um que tenha usado ferramentas modernas de IA provavelmente já passou por isso. Você faz uma pergunta e o sistema dá uma resposta clara, às vezes até com explicações e referências. Mas depois você percebe que alguma parte da resposta estava incorreta.

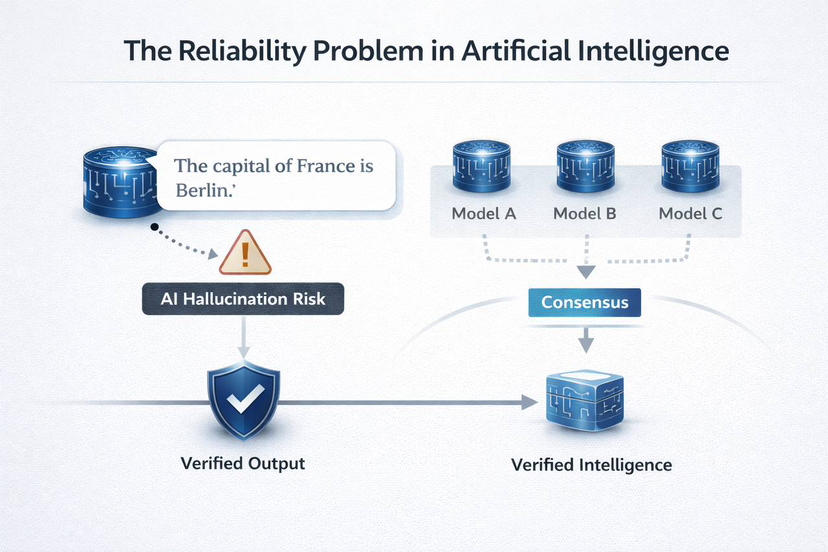

Isso acontece porque a maioria dos sistemas de IA funciona prevendo a próxima palavra mais provável, em vez de provar fatos. Eles são extremamente bons em produzir linguagem que parece correta, mas isso não significa que a informação seja sempre precisa. Esse problema é frequentemente chamado de "alucinação de IA". Mesmo modelos avançados ainda produzem informações erradas ou tendenciosas às vezes, o que os torna difíceis de confiar em áreas importantes como finanças, educação, saúde ou direito.

Por que a verificação pode ser mais importante do que a inteligência

O conceito de Mira se torna mais compreensível uma vez que se considera a maneira como os humanos confirmam informações. Na ciência, dificilmente se pode acreditar em uma afirmação feita por um indivíduo. A afirmação é testada por outros pesquisadores, recriando o experimento e verificando as evidências. Não é até que essa afirmação seja provada repetidamente que se torna conhecimento aceito.

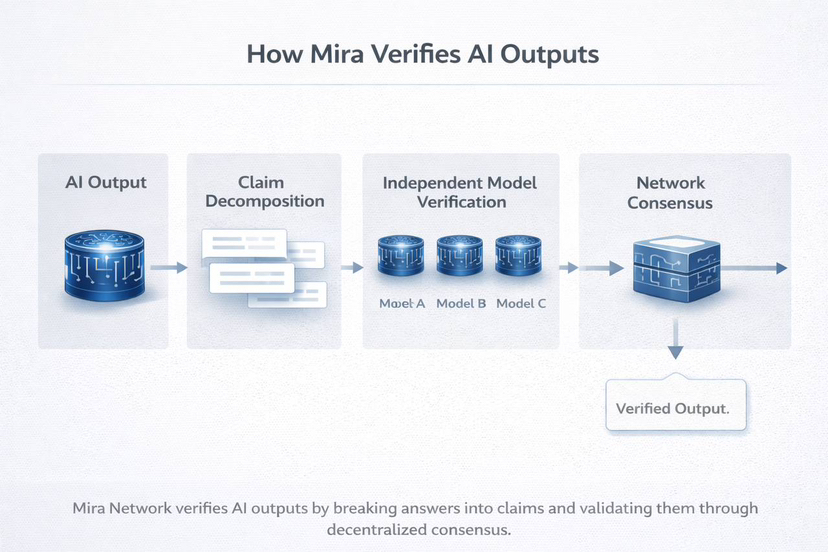

A Mira tenta transferir um valor comparável para a inteligência artificial. A saída do modelo de um único modelo não é automaticamente confiável na rede. Em vez disso, decompõe uma resposta de IA em reivindicações menores que podem ser verificadas. Essas afirmações são então submetidas a vários modelos independentes ou nós de verificação que as examinam individualmente.

O que é interessante neste design é que ele vê a verdade como algo que surge do consenso entre várias atitudes, em vez de ser algo que é interpretado centralmente.

O propósito da descentralização do sistema.

O outro aspecto que faz a Mira se destacar, na minha opinião, é a maneira como sua verificação é organizada. A rede não depende de uma única empresa ou servidor centralizado para realizar a verificação, mas sim de um grande número de participantes independentes. Esses participantes executam vários modelos de IA e reivindicações apresentadas à rede.

Essa organização descentralizada é importante, pois elimina as chances de favorecimento ou manipulação. Quando a verificação é feita por uma única organização, há a possibilidade de que possa ser tendenciosa quanto às respostas que devem ser consideradas aceitáveis. No entanto, uma vez que o número de validadores independentes é grande, o resultado será mais equilibrado.

Simplificando, a Mira está tentando estabelecer uma camada de confiança com inteligência artificial.

Motivos que tornam o sistema honesto.

Incentivos é uma das coisas que nunca negligencio ao estudar projetos de cripto. A tecnologia por si só é difícil de ser suficiente. Esses sistemas tendem a funcionar, pois indivíduos são punidos quando não agem de forma correta.

A Mira propõe um sistema de incentivos em tokens que motiva os validadores a submeterem a verificação correta. As partes interessadas podem fazer apostas para se juntar à rede e receber uma recompensa quando realizam a verificação corretamente. Caso ofereçam uma verificação negligente ou falsa, parte de sua aposta pode ser perdida.

Outra abordagem de pensar a infraestrutura de IA.

Quanto menos considero a Mira, mais ela parece ser um projeto de infraestrutura e não outro token de cripto. Não está visando criar um chatbot melhor ou um modelo mais inteligente. Em vez disso, está preocupada com algo mais profundo: garantir que as saídas de IA sejam credíveis.

A Mira está buscando o conceito de que não é apenas a inteligência que é suficiente. O que precisamos é da inteligência em que podemos confiar.