Google は、あらゆるビジュアル スタイルを模倣し、次の世代に転送できる新しいニューラル ネットワークである StyleDrop を発表しました。Muse の高速テキスト画像変換モデルを搭載したこの革新的なテクノロジーにより、ユーザーは特定のスタイルを忠実に体現し、そのニュアンスや複雑さを捉えた画像を簡単に生成できます。

クレジット: Midjourney / Chaffro#6204

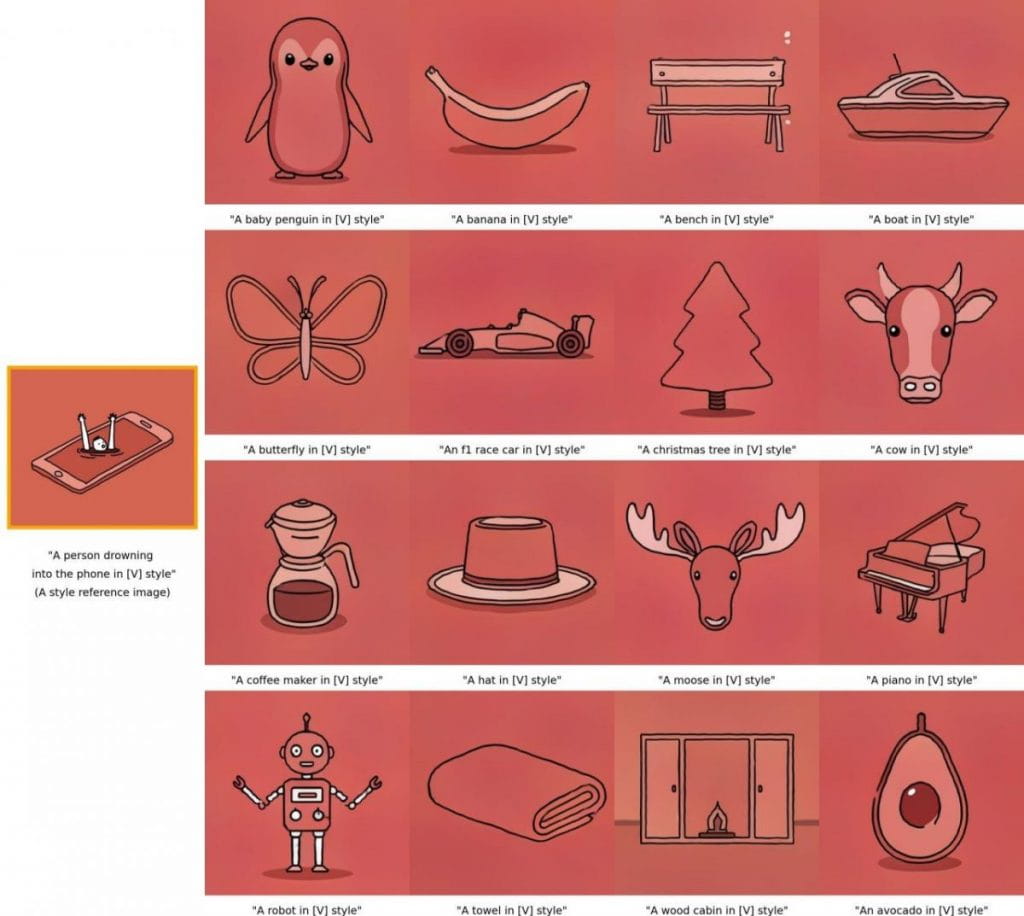

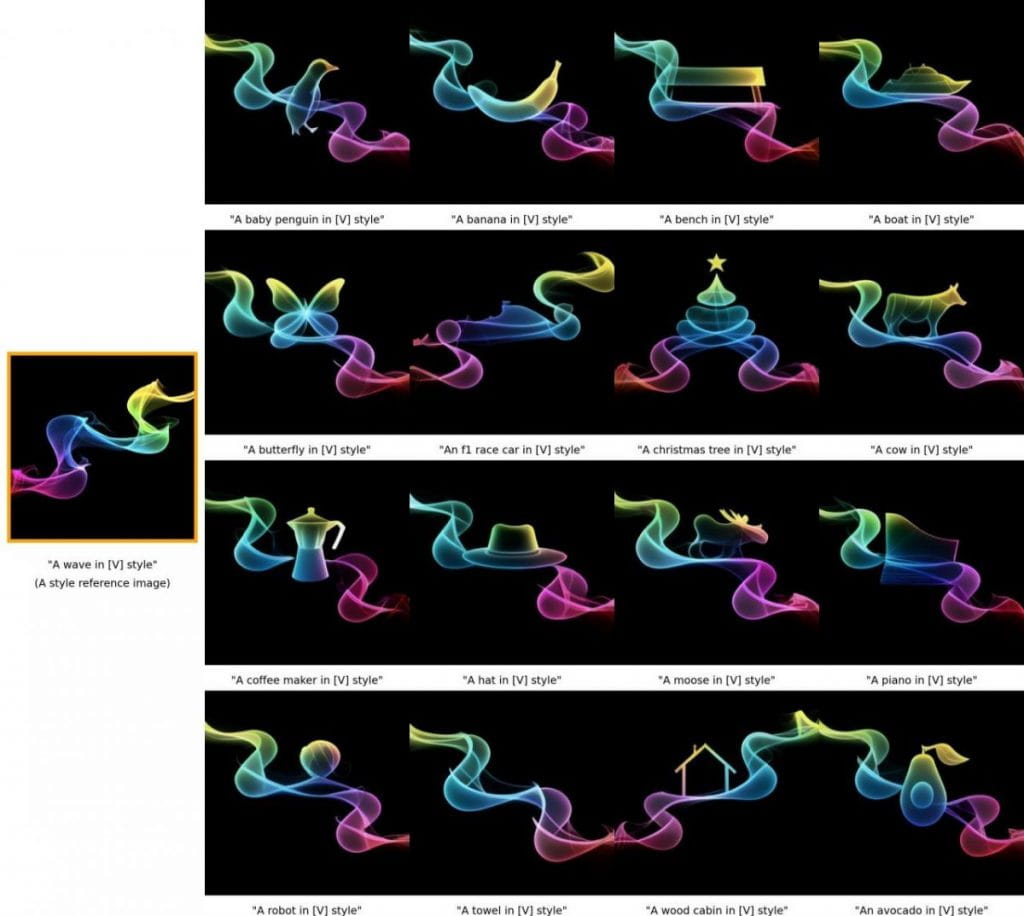

StyleDrop を使用すると、希望するビジュアル スタイルの元の画像を選択し、選択したスタイルの固有の特性をすべて保持しながら、新しい画像にシームレスに転送できます。このアプリケーションは、互いに完全に異なる画像でも使用できます。たとえば、ユーザーは子供の絵をベースにして、様式化されたロゴやキャラクターを生成できます。

StyleDrop は、Muse の高度な生成ビジョン トランスフォーマーに基づいて、ユーザー フィードバック、生成された画像、およびクリップ スコアの組み合わせを使用してトレーニングされます。ニューラル ネットワークは、モデル パラメータ全体の 1% 未満を占める最小限のトレーニング可能なパラメータで微調整されます。反復的なトレーニングを通じて、StyleDrop は生成された画像の品質を継続的に向上させ、わずか数分で印象的な結果を保証します。

StyleDrop は多用途であるため、独自のビジュアル スタイルを開発したいブランドにとって欠かせないツールです。StyleDrop を使用すると、ブランドは好みのスタイルでアイデアを効率的にプロトタイプ化できるため、クリエイティブ チームやデザイナーにとって貴重な資産となります。

クレジット: styledrop.github.io

クレジット: styledrop.github.io

テキストから画像へのモデルのスタイル調整における StyleDrop のパフォーマンスについて実施された広範な調査では、DreamBooth、Imagen の Textual Inversion、Stable Diffusion などの他の方法よりも StyleDrop が優れていることが示されました。StyleDrop は一貫してこれらのアプローチを上回り、ユーザーが指定したスタイルに厳密に準拠した高品質の画像を提供しました。

ユーザーが提供するテキストベースのプロンプトは、StyleDrop の画像生成プロセスで重要な役割を果たします。トレーニングと生成の両方で、コンテンツ記述子に自然言語のスタイル記述子 (「溶けた金色の 3D レンダリング スタイル」や「抽象的な虹色の流れる煙の波のデザイン」など) を追加することで、StyleDrop は目的のスタイルを正確に捉えます。

クレジット: styledrop.github.io

クレジット: styledrop.github.io

さらに、StyleDrop は、ユーザーが独自のブランド資産を使用してニューラル ネットワークをトレーニングする機会を提供し、独自のビジュアル アイデンティティをシームレスに統合できるようにします。トレーニングと生成中にコンテンツ記述子に自然言語のスタイル記述子を追加することで、ブランドは独自のスタイルでアイデアを迅速にプロトタイプ化できます。

StyleDrop による生成プロセスは驚くほど効率的で、3 分もかかりません。この短い処理時間により、ユーザーはさまざまなクリエイティブな可能性を探り、さまざまなスタイルを素早く試すことができます。

クレジット: styledrop.github.io

クレジット: styledrop.github.io

StyleDrop はブランド開発に大きな可能性を秘めていますが、このアプリケーションはまだ一般に公開されていないことに注意する必要があります。Google チームは著作権の問題に積極的に対処し、法令遵守の確保に取り組んでおり、スムーズで安全なリリースが実現します。

クレジット: styledrop.github.io

クレジット: styledrop.github.io

このニューラル ネットワークは、あらゆるビジュアル スタイルを簡単に再現することで、ブランドや人々が創造性を発揮し、競争が激化するデジタル環境において魅力的なビジュアル アイデンティティを作成するのに役立ちます。ブランドは、StyleDrop を使用して独自のビジュアル ストーリーラインを作成する貴重なツールを手に入れ、比類のない容易さと精度でそれを行うことができます。

AI について詳しく読む:

Midjourney と Dall-E のアーティスト スタイル ダンプと例: 有名な AI ペイント テクニック 130 選

GPT-4 対 GPT-3: 新しいモデルには何がありますか?

VToonify: 芸術的なポートレート動画を生成するリアルタイム AI モデル

StyleDrop: あらゆるビジュアル スタイルを複製する Google のニューラル ネットワークという記事が最初に Metaverse Post に掲載されました。