Penulis asli: YBB Capital Zeke

Kata pengantar

Pada tanggal 16 Februari, OpenAI mengumumkan model difusi generasi video terbaru yang dikontrol teks "Sora", yang mendemonstrasikan momen penting lainnya dalam AI generatif melalui beberapa video yang dihasilkan berkualitas tinggi yang mencakup berbagai jenis data visual. Tidak seperti alat pembuatan video AI seperti Pika, yang masih dalam tahap menghasilkan video berdurasi beberapa detik dari beberapa gambar, Sora mencapai pembuatan video yang skalabel dengan melatih ruang laten terkompresi dari video dan gambar, menguraikannya menjadi patch lokasi spatiotemporal. . Selain itu, model tersebut juga mencerminkan kemampuan simulasi dunia fisik dan dunia digital. Demo berdurasi 60 detik yang akhirnya dihadirkan tidak berlebihan jika dikatakan sebagai "simulator universal dunia fisik".

Dalam hal metode konstruksi, Sora melanjutkan jalur teknis "sumber data-Transformer-Diffusi-kemunculan" dari model GPT sebelumnya, yang berarti bahwa pengembangannya yang matang juga memerlukan daya komputasi sebagai mesin, dan karena jumlah data yang diperlukan untuk pelatihan video jauh lebih besar daripada teks. Jumlah data pelatihan akan semakin meningkatkan kebutuhan daya komputasi. Namun, kami telah membahas pentingnya daya komputasi di era AI di artikel kami sebelumnya (Pratinjau Jalur Potensial: Pasar Daya Komputasi Terdesentralisasi), dan dengan meningkatnya popularitas AI baru-baru ini, sudah ada sejumlah besar proyek daya komputasi di pasar mulai bermunculan, dan proyek Depin lainnya (penyimpanan, daya komputasi, dll.) yang diuntungkan secara pasif juga mengalami lonjakan. Jadi selain Depin, percikan seperti apa yang bisa terjadi pada persimpangan Web3 dan AI? Peluang apa lagi yang ada di jalur ini? Tujuan utama artikel ini adalah untuk memperbarui dan melengkapi artikel sebelumnya, serta memikirkan kemungkinan Web3 di era AI.

Tiga arah utama dalam sejarah perkembangan AI

Kecerdasan Buatan (Artificial Intelligence) adalah ilmu pengetahuan dan teknologi baru yang dirancang untuk mensimulasikan, memperluas, dan meningkatkan kecerdasan manusia. Sejak lahir pada tahun 1950-an dan 1960-an, kecerdasan buatan telah mengalami perkembangan lebih dari setengah abad dan kini telah menjadi teknologi penting yang mendorong perubahan dalam kehidupan sosial dan seluruh lapisan masyarakat. Dalam proses ini, pengembangan tiga arah penelitian utama yaitu simbolisme, koneksionisme, dan behaviorisme yang saling terkait telah menjadi landasan pesatnya perkembangan AI saat ini.

Simbolisme

Juga dikenal sebagai logikaisme atau regularisme, ini adalah keyakinan bahwa simulasi kecerdasan manusia dapat dilakukan dengan memproses simbol. Metode ini menggunakan simbol-simbol untuk mewakili dan mengoperasikan objek, konsep dan keterkaitannya dalam domain masalah, dan menggunakan penalaran logis untuk memecahkan masalah, terutama dalam sistem pakar dan representasi pengetahuan, yang telah mencapai hasil yang luar biasa. Ide inti dari simbolisme adalah bahwa perilaku cerdas dapat dicapai melalui pengoperasian simbol dan penalaran logis, di mana simbol mewakili abstraksi tingkat tinggi dari dunia nyata;

Koneksionisme

Atau disebut dengan metode jaringan saraf, bertujuan untuk mencapai kecerdasan dengan meniru struktur dan fungsi otak manusia. Metode ini mencapai pembelajaran dengan membangun jaringan dari banyak unit pemrosesan sederhana (mirip dengan neuron) dan menyesuaikan kekuatan hubungan antara unit-unit tersebut (mirip dengan sinapsis). Koneksionisme secara khusus menekankan kemampuan untuk belajar dan menggeneralisasi data, dan sangat cocok untuk masalah pengenalan pola, klasifikasi, dan pemetaan input-output berkelanjutan. Pembelajaran mendalam, sebagai pengembangan dari koneksionisme, telah membuat terobosan di berbagai bidang seperti pengenalan gambar, pengenalan ucapan, dan pemrosesan bahasa alami;

Behaviorisme

Behaviorisme terkait erat dengan penelitian robotika bionik dan sistem cerdas otonom, yang menekankan bahwa agen cerdas dapat belajar melalui interaksi dengan lingkungan. Berbeda dengan dua aliran pertama, behaviorisme tidak berfokus pada simulasi representasi internal atau proses berpikir, melainkan pada pencapaian perilaku adaptif melalui siklus persepsi dan tindakan. Behaviorisme percaya bahwa kecerdasan ditunjukkan melalui interaksi dinamis dan pembelajaran dengan lingkungan. Metode ini sangat efektif bila diterapkan pada robot bergerak dan sistem kontrol adaptif yang perlu bertindak dalam lingkungan yang kompleks dan tidak dapat diprediksi.

Meskipun terdapat perbedaan mendasar antara ketiga arah penelitian ini, dalam penelitian dan penerapan AI sebenarnya, ketiganya juga dapat berinteraksi dan berintegrasi untuk bersama-sama mendorong pengembangan bidang AI.

Ikhtisar prinsip AIGC

AI Generatif (Artificial Intelligence Generated Content, AIGC), yang saat ini sedang mengalami perkembangan eksplosif, merupakan evolusi dan penerapan koneksionisme yang dapat meniru kreativitas manusia untuk menghasilkan konten baru. Model-model ini dilatih menggunakan kumpulan data besar dan algoritme pembelajaran mendalam untuk mempelajari struktur, hubungan, dan pola mendasar yang ada dalam data. Hasilkan keluaran baru dan unik berdasarkan perintah masukan pengguna, termasuk gambar, video, kode, musik, desain, terjemahan, jawaban pertanyaan, dan teks. AIGC saat ini pada dasarnya terdiri dari tiga elemen: Pembelajaran Mendalam (DL), data besar, dan daya komputasi skala besar.

pembelajaran mendalam

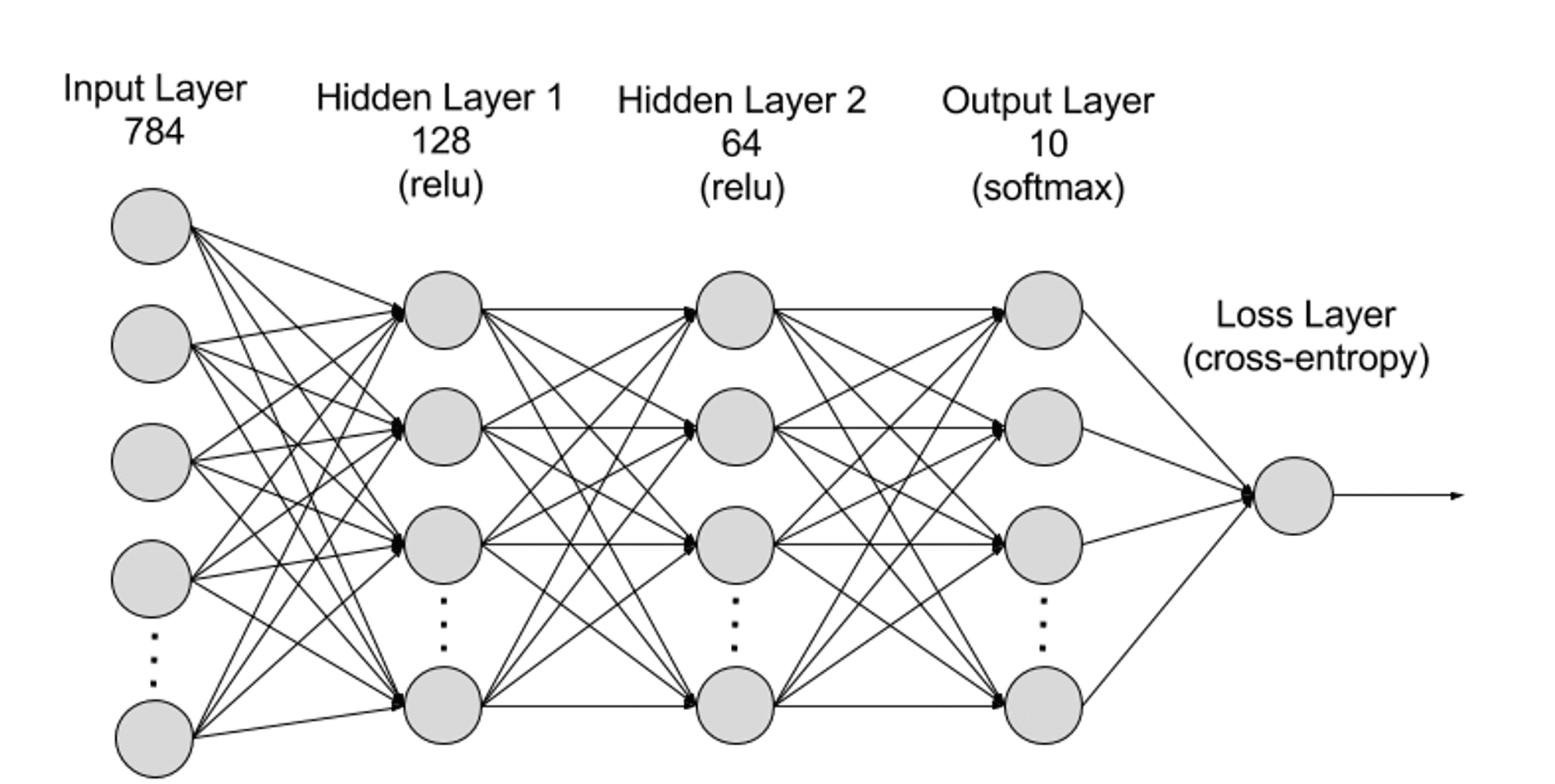

Pembelajaran mendalam adalah subbidang pembelajaran mesin (ML), dan algoritma pembelajaran mendalam adalah jaringan saraf yang meniru otak manusia. Misalnya, otak manusia mengandung jutaan neuron yang saling berhubungan yang bekerja sama untuk mempelajari dan memproses informasi. Demikian pula, jaringan saraf pembelajaran mendalam (atau jaringan saraf tiruan) terdiri dari beberapa lapisan neuron buatan yang bekerja bersama di dalam komputer. Neuron buatan adalah modul perangkat lunak yang disebut node yang menggunakan perhitungan matematis untuk memproses data. Jaringan saraf tiruan adalah algoritma pembelajaran mendalam yang menggunakan node ini untuk memecahkan masalah kompleks.

Jaringan saraf dapat dibagi menjadi lapisan masukan, lapisan tersembunyi, dan lapisan keluaran dari tingkat hierarki, dan parameternya dihubungkan antar lapisan yang berbeda.

Lapisan Masukan: Lapisan masukan adalah lapisan pertama dari jaringan saraf dan bertanggung jawab untuk menerima data masukan eksternal. Setiap neuron di lapisan masukan berhubungan dengan fitur data masukan. Misalnya, saat memproses data gambar, setiap neuron mungkin berhubungan dengan nilai piksel dalam gambar;

Lapisan Tersembunyi: Lapisan masukan memproses data dan meneruskannya ke lapisan lebih lanjut di jaringan saraf. Lapisan tersembunyi ini memproses informasi pada tingkat yang berbeda, menyesuaikan perilakunya saat menerima informasi baru. Jaringan pembelajaran mendalam memiliki ratusan lapisan tersembunyi dan dapat digunakan untuk menganalisis masalah dari berbagai perspektif. Misalnya, jika Anda diberikan gambar binatang tak dikenal yang harus Anda klasifikasikan, Anda bisa membandingkannya dengan binatang yang sudah Anda kenal. Misalnya, Anda dapat mengetahui jenis hewan dari bentuk telinganya, jumlah kakinya, dan ukuran pupilnya. Lapisan tersembunyi di jaringan saraf dalam bekerja dengan cara yang sama. Jika algoritme pembelajaran mendalam mencoba mengklasifikasikan gambar hewan, setiap lapisan tersembunyinya akan memproses fitur berbeda dari hewan tersebut dan mencoba mengklasifikasikannya secara akurat;

Lapisan Keluaran: Lapisan keluaran adalah lapisan terakhir dari jaringan saraf dan bertanggung jawab untuk menghasilkan keluaran jaringan. Setiap neuron di lapisan keluaran mewakili kategori atau nilai keluaran yang mungkin. Misalnya, dalam masalah klasifikasi, setiap neuron lapisan keluaran mungkin sesuai dengan suatu kategori, sedangkan dalam masalah regresi, lapisan keluaran mungkin hanya memiliki satu neuron yang nilainya mewakili hasil prediksi;

Parameter: Dalam jaringan saraf, koneksi antara lapisan yang berbeda diwakili oleh parameter bobot dan bias, yang dioptimalkan selama proses pelatihan untuk memungkinkan jaringan mengidentifikasi pola dalam data secara akurat dan membuat prediksi. Peningkatan parameter dapat meningkatkan kapasitas model jaringan saraf, yaitu kemampuan model untuk mempelajari dan merepresentasikan pola kompleks dalam data. Namun seiring dengan itu, peningkatan parameter akan meningkatkan permintaan daya komputasi.

data besar

Agar dapat dilatih secara efektif, jaringan saraf biasanya memerlukan sejumlah besar data yang beragam dan berkualitas tinggi dari berbagai sumber. Ini adalah dasar untuk pelatihan dan validasi model pembelajaran mesin. Dengan menganalisis data besar, model pembelajaran mesin dapat mempelajari pola dan hubungan dalam data untuk membuat prediksi atau klasifikasi.

Kekuatan komputasi skala besar

Struktur kompleks multi-lapisan jaringan saraf, sejumlah besar parameter, persyaratan pemrosesan data besar, dan metode pelatihan berulang (dalam fase pelatihan, model perlu diulang berulang kali, dan selama proses pelatihan, propagasi maju dan mundur propagasi diperlukan untuk setiap penghitungan lapisan, termasuk penghitungan fungsi aktivasi, penghitungan fungsi kerugian, penghitungan gradien, dan pembaruan bobot), persyaratan penghitungan presisi tinggi, kemampuan komputasi paralel, teknik pengoptimalan dan regularisasi, serta proses evaluasi dan verifikasi model bersama-sama mengarah pada permintaan akan daya komputasi yang tinggi.

Sora

Sebagai model AI generasi video terbaru yang dirilis oleh OpenAI, Sora mewakili kemajuan besar dalam kemampuan kecerdasan buatan untuk memproses dan memahami beragam data visual. Dengan menggunakan jaringan kompresi video dan teknologi patching spasial-temporal, Sora mampu mengubah data visual besar-besaran yang ditangkap oleh perangkat berbeda dari seluruh dunia menjadi representasi terpadu, sehingga mencapai pemrosesan yang efisien dan pemahaman konten visual yang kompleks. Mengandalkan model Difusi yang dikondisikan teks, Sora dapat menghasilkan video atau gambar yang sangat cocok berdasarkan petunjuk teks, menunjukkan kreativitas dan kemampuan beradaptasi yang sangat tinggi.

Namun, meskipun Sora telah membuat terobosan dalam pembuatan video dan simulasi interaksi dunia nyata, Sora masih menghadapi beberapa keterbatasan, termasuk keakuratan simulasi dunia fisik, konsistensi pembuatan video panjang, pemahaman instruksi teks yang kompleks, serta pelatihan dan efisiensi pembuatan. Dan Sora pada dasarnya mencapai estetika yang hebat melalui jalur teknologi lama "Big Data-Transformer-Diffusion-Emergence" melalui kekuatan komputasi tingkat monopoli OpenAI dan keunggulan penggerak pertama. Perusahaan AI lainnya masih harus melewati jalan memutar teknis .

Meskipun Sora tidak banyak berhubungan dengan blockchain, menurut saya pribadi dalam satu atau dua tahun ke depan. Karena pengaruh Sora akan memaksa alat generasi AI berkualitas tinggi lainnya untuk muncul dan berkembang dengan cepat, dan akan menyebar ke banyak jalur seperti GameFi, jejaring sosial, platform pembuatan, dan Depin dalam Web3, maka diperlukan pemahaman umum tentang Sora, bagaimana AI akan digabungkan secara efektif dengan Web3 di masa depan mungkin merupakan poin penting yang perlu kita pikirkan.

Empat jalur utama AI x Web3

Seperti disebutkan di atas, kita dapat mengetahui bahwa landasan mendasar yang diperlukan untuk AI generatif sebenarnya hanya tiga poin: algoritma, data, dan daya komputasi. Di sisi lain, dari perspektif keserbagunaan dan efek pembangkitan, AI adalah alat yang menumbangkan teknologi cara produksi. Peran terbesar blockchain ada dua: rekonstruksi hubungan produksi dan desentralisasi. Oleh karena itu, menurut saya pribadi, ada empat jalur yang dapat dihasilkan dari benturan keduanya:

Kekuatan komputasi terdesentralisasi

Karena artikel terkait telah ditulis sebelumnya, tujuan utama paragraf ini adalah untuk memperbarui status jalur daya komputasi saat ini. Dalam kaitannya dengan AI, kekuatan komputasi selalu menjadi faktor yang tidak dapat dihindari. Permintaan AI akan daya komputasi begitu besar sehingga tidak terbayangkan setelah kelahiran Sora. Baru-baru ini, pada Forum Ekonomi Dunia 2024 di Davos, Swiss, CEO OpenAI Sam Altman secara blak-blakan menyatakan bahwa daya komputasi dan energi adalah belenggu terbesar pada tahap ini, dan kepentingannya di masa depan bahkan akan setara dengan mata uang. Pada tanggal 10 Februari, Sam Altman mengumumkan rencana yang sangat mencengangkan di Twitter untuk mengumpulkan US$7 triliun (setara dengan 40% PDB nasional Tiongkok pada tahun 2023) untuk mengubah pola industri semikonduktor global saat ini. Saat menulis artikel terkait daya komputasi, imajinasi saya masih sebatas blokade nasional dan monopoli raksasa. Saat ini, sungguh gila jika ada satu perusahaan yang ingin menguasai industri semikonduktor global.

Oleh karena itu, pentingnya daya komputasi yang terdesentralisasi sudah terbukti dengan sendirinya. Karakteristik blockchain memang dapat memecahkan masalah monopoli daya komputasi yang ekstrim dan mahalnya pembelian GPU khusus. Dari perspektif kebutuhan AI, penggunaan daya komputasi dapat dibagi menjadi dua arah: inferensi dan pelatihan. Saat ini, hanya ada beberapa proyek yang berfokus pada pelatihan kebutuhan akan perangkat keras ultra Permintaan yang tinggi ditakdirkan menjadi arah dengan ambang batas yang sangat tinggi dan sangat sulit untuk diterapkan. Alasannya relatif sederhana. Di satu sisi, desain jaringan terdesentralisasi tidak rumit, dan di sisi lain, persyaratan perangkat keras dan bandwidth rendah, yang dianggap sebagai arah yang relatif umum saat ini.

Ruang imajinasi pasar daya komputasi terpusat sangat besar, dan sering kali dikaitkan dengan kata kunci "tingkat triliun". Ini juga merupakan topik yang paling sering dihebohkan di era AI. Namun, dilihat dari banyaknya proyek yang bermunculan akhir-akhir ini, sebagian besar masih berlomba-lomba untuk mendapatkan popularitas. Selalu menjunjung tinggi panji desentralisasi, namun tetap diam mengenai inefisiensi jaringan desentralisasi. Dan terdapat tingkat homogenitas yang tinggi dalam desain. Sejumlah besar proyek sangat mirip (L2 sekali klik plus desain penambangan), yang pada akhirnya dapat mengarah pada situasi di mana sangat sulit untuk mendapatkan bagian dari jalur AI tradisional. .

Algoritma dan model sistem kolaborasi

Algoritma pembelajaran mesin mengacu pada algoritma yang dapat mempelajari aturan dan pola dari data dan membuat prediksi atau keputusan berdasarkan data tersebut. Algoritma bersifat intensif teknologi karena desain dan optimalisasinya memerlukan keahlian mendalam dan inovasi teknologi. Algoritma adalah inti dari pelatihan model AI dan menentukan bagaimana data diubah menjadi wawasan atau keputusan yang berguna. Algoritme AI generatif yang lebih umum seperti Generative Adversarial Network (GAN), Variational Autoencoder (VAE), dan Transformer masing-masing dirancang untuk bidang tertentu (seperti lukisan, pengenalan bahasa, terjemahan, dan pembuatan video) atau dengan kata lain , ia lahir berdasarkan tujuannya, dan kemudian model AI khusus dilatih melalui algoritme.

Jadi ada begitu banyak algoritma dan model, masing-masing memiliki kelebihannya masing-masing. Bisakah kita mengintegrasikannya ke dalam model yang bersifat sipil dan militer? Bittensor, yang menjadi sangat populer akhir-akhir ini, adalah pemimpin dalam bidang ini. Bittensor menggunakan insentif penambangan untuk memungkinkan berbagai model dan algoritme AI berkolaborasi dan belajar satu sama lain, sehingga menciptakan model AI yang lebih efisien dan serbaguna. Yang juga berfokus pada arah ini adalah Commune AI (kolaborasi kode), dll. Namun, bagi perusahaan AI saat ini, algoritme dan model adalah senjata ajaib mereka sendiri dan tidak akan dipinjam sesuka hati.

Oleh karena itu, narasi ekologi kolaboratif AI sangat baru dan menarik. Ekosistem kolaboratif memanfaatkan blockchain untuk mengintegrasikan kelemahan pulau algoritma AI, namun belum diketahui apakah hal tersebut dapat menciptakan nilai yang sesuai. Bagaimanapun, algoritme dan model sumber tertutup dari perusahaan AI terkemuka memiliki kemampuan yang sangat kuat untuk memperbarui, melakukan iterasi, dan mengintegrasikan. Misalnya, dalam waktu kurang dari dua tahun pengembangan, OpenAI telah melakukan iterasi dari model pembuatan teks awal hingga model yang dihasilkan di berbagai bidang . Proyek seperti Bittensor telah membuat kemajuan besar dalam model dan algoritma. Area yang ditargetkan mungkin memerlukan pendekatan baru.

Data besar yang terdesentralisasi

Dari sudut pandang sederhana, menggunakan data pribadi untuk memberi makan AI dan memberi label pada data adalah arahan yang sangat konsisten dengan blockchain. Anda hanya perlu memperhatikan cara mencegah data sampah dan kejahatan, dan penyimpanan data juga bisa menggunakan FIL, AR Tunggu. proyek Depin mendapatkan manfaatnya. Dari perspektif yang kompleks, penggunaan data blockchain untuk pembelajaran mesin (ML) guna mengatasi aksesibilitas data blockchain juga merupakan arah yang menarik (salah satu arah eksplorasi Giza).

Secara teori, data blockchain dapat diakses kapan saja dan mencerminkan status keseluruhan blockchain. Namun bagi mereka yang berada di luar ekosistem blockchain, mengakses data dalam jumlah besar ini tidaklah mudah. Menyimpan blockchain secara keseluruhan memerlukan keahlian yang luas dan sumber daya perangkat keras khusus dalam jumlah besar. Untuk mengatasi tantangan dalam mengakses data blockchain, beberapa solusi telah muncul di industri. Misalnya, penyedia RPC mengakses node melalui API, sementara layanan pengindeksan memungkinkan ekstraksi data melalui SQL dan GraphQL, keduanya memainkan peran penting dalam memecahkan masalah. Namun, metode ini mempunyai keterbatasan. Layanan RPC tidak cocok untuk skenario penggunaan kepadatan tinggi yang memerlukan kueri data dalam jumlah besar, dan seringkali tidak dapat memenuhi permintaan. Pada saat yang sama, meskipun layanan pengindeksan menyediakan cara yang lebih terstruktur untuk mengambil data, kompleksitas protokol Web3 membuatnya sangat sulit untuk membuat kueri yang efisien, terkadang memerlukan ratusan atau bahkan ribuan baris kode kompleks untuk ditulis. Kompleksitas ini merupakan kendala besar bagi praktisi data umum dan mereka yang tidak memahami detail Web3 secara mendalam. Efek kumulatif dari keterbatasan ini menyoroti perlunya cara yang lebih mudah untuk memperoleh dan memanfaatkan data blockchain yang dapat mendorong adopsi dan inovasi yang lebih luas di lapangan.

Kemudian dengan menggabungkan data blockchain berkualitas tinggi dengan ZKML (pembelajaran mesin tanpa pengetahuan, mengurangi beban pembelajaran mesin pada rantai), dimungkinkan untuk membuat kumpulan data yang memecahkan masalah aksesibilitas blockchain, dan AI dapat secara signifikan mengurangi biaya blockchain untuk aksesibilitas data, sehingga seiring waktu, pengembang, peneliti, dan penggemar di bidang ML akan dapat mengakses kumpulan data yang lebih berkualitas dan relevan untuk membangun solusi yang efektif dan inovatif.

AI memberdayakan Dapp

Sejak ChatGPT 3 menjadi populer pada tahun 2023, Dapp yang didukung AI telah menjadi tren yang sangat umum. AI generatif yang sangat serbaguna dapat diakses melalui API, sehingga menyederhanakan dan menganalisis secara cerdas platform data, robot perdagangan, ensiklopedia blockchain, dan aplikasi lainnya. Di sisi lain, Anda juga dapat bertindak sebagai chatbot (seperti Myshell) atau pendamping AI (Sleepless AI), atau bahkan membuat NPC dalam permainan berantai melalui AI generatif. Namun, karena hambatan teknisnya sangat rendah, sebagian besar sudah diperbaiki setelah mengakses API, dan integrasi dengan proyek itu sendiri tidak sempurna, sehingga jarang disebutkan.

Namun setelah kedatangan Sora, saya pribadi berpendapat bahwa arah pemberdayaan AI GameFi (termasuk Metaverse) dan platform kreasi akan menjadi fokus langkah selanjutnya. Karena sifat bidang Web3 yang bersifat bottom-up, pasti akan sulit menghasilkan produk yang bersaing dengan permainan tradisional atau perusahaan kreatif, dan kemunculan Sora kemungkinan besar akan memecahkan dilema ini (mungkin hanya dalam dua hingga tiga tahun). Dilihat dari Demo Sora sudah berpotensi bersaing dengan perusahaan drama pendek mikro. Budaya komunitas aktif Web3 juga dapat melahirkan banyak Ide menarik. Ketika batasannya hanya imajinasi, industri bottom-up dan Hambatan yang bersifat top-down antara industri tradisional akan dihilangkan.

Kesimpulan

Seiring dengan kemajuan alat AI generatif, kita akan mengalami lebih banyak "momen iPhone" yang membawa perubahan zaman di masa depan. Meski banyak orang yang mencemooh kombinasi AI dan Web3, nyatanya menurut saya sebagian besar tidak ada masalah dengan arah saat ini. Sebenarnya hanya ada tiga kendala yang perlu diselesaikan, yaitu kebutuhan, efisiensi, dan kesesuaian. Meski integrasi keduanya masih dalam tahap penjajakan, namun tidak menghalangi jalur ini untuk menjadi arus utama bull market berikutnya.

Selalu menjaga rasa ingin tahu dan penerimaan terhadap hal-hal baru adalah mentalitas yang harus dimiliki bagi kami. Secara historis, pergantian mobil untuk menggantikan kereta kuda sudah menjadi kepastian dalam sekejap, seperti halnya prasasti dan NFT di masa lalu terlalu banyak prasangka. Anda hanya akan kehilangan kesempatan.