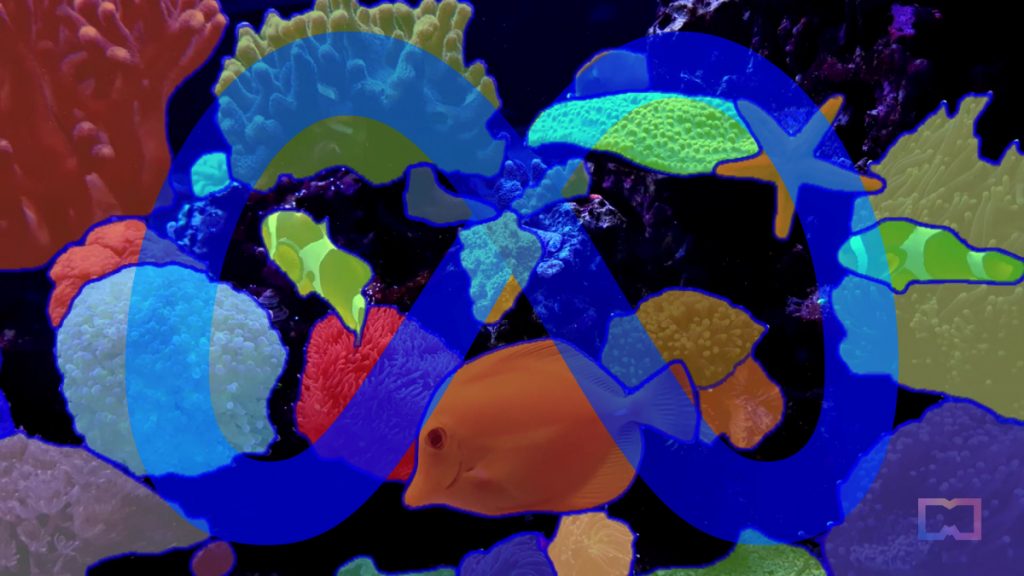

Meta a présenté Segment Anything, son nouveau modèle de base pour la segmentation d'images. Le processus d'identification des pixels d'image appartenant à un objet est une tâche cruciale en vision par ordinateur et est utilisé dans de nombreuses applications, de l'analyse d'images scientifiques à l'édition de photos.

Dans son article de blog d'introduction, l'entreprise a planté le décor en affirmant que la création de modèles de segmentation précis pour des tâches spécifiques en vision par ordinateur nécessitait généralement un travail spécialisé de la part d'experts techniques ayant accès à une infrastructure de formation en IA et à de grands volumes de données dans le domaine soigneusement annotées.

Cependant, cela pourrait bientôt changer avec le projet Segment Anything, car son nouvel ensemble de données et son nouveau modèle devraient rendre les modèles de segmentation précis plus accessibles à un public plus large, éliminant ainsi le besoin d'expertise technique et d'infrastructure spécialisées. Pour y parvenir, les chercheurs ont construit un modèle incitatif qui est formé sur des données diverses et peut s'adapter à des tâches spécifiques, de la même manière que l'incitation est utilisée dans les modèles de traitement du langage naturel ou les chatbots.

Pour démocratiser davantage la segmentation, Meta met à disposition l'énorme ensemble de données SA-1B à des fins de recherche, et le modèle Segment Anything est disponible sous une licence ouverte permissive (Apache 2.0). De plus, la société a développé une démo qui permet aux utilisateurs d'essayer SAM avec leurs propres images.

Meta voit des cas d'utilisation potentiels pour le SAM dans les domaines de l'IA, de la réalité augmentée/réalité virtuelle et des créateurs. Le SAM a le potentiel de devenir un élément essentiel dans les systèmes d'IA plus vastes qui visent à parvenir à une compréhension multimodale plus générale du monde. Par exemple, il peut faciliter la compréhension du contenu visuel et textuel d'une page Web.

De plus, dans le domaine de la réalité augmentée/réalité virtuelle, la technologie SAM pourrait permettre de sélectionner des objets en fonction du regard de l’utilisateur et de « soulever » l’objet en 3D. De plus, les créateurs de contenu peuvent utiliser la technologie SAM pour améliorer les applications créatives telles que l’extraction de régions d’image pour les collages ou le montage vidéo.

Meta a intensifié ses efforts en matière d’IA dans un contexte de boom de l’IA générative et de déclin de l’intérêt pour le métavers. Malgré le pari de 70 milliards de dollars de l’entreprise sur le métavers, sa division métavers Reality Labs a enregistré une perte de 13,7 milliards de dollars l’année dernière. Récemment, Meta a également mis fin à ses opérations NFT sur Facebook et Instagram.

Dans une interview accordée mercredi à Nikkei Asia, Chris Bosworth, directeur technique de Meta, a déclaré que les cadres dirigeants de Meta consacraient la majeure partie de leur temps à l’IA. Le PDG de Meta, Mark Zuckerberg, a annoncé en février un nouveau groupe de produits axé sur l’IA générative après avoir publié son nouveau modèle de langage étendu appelé LLaMA (Large Language Model Meta AI).

La société devrait lancer cette année certaines applications d'IA de création de publicités, a déclaré Bosworth à Nikkei.

En savoir plus:

Square Enix prévoit une expansion pour développer sa stratégie Metaverse

Samsung Latam entre dans le métaverse avec « House of Sam » dans Decentraland

Méta : les utilisateurs peuvent désormais publier des NFT sur Instagram et Facebook

La CFTC dévoile de nouvelles accusations contre Sam Bankman-Fried, FTX et Alameda

Le PDG d'OpenAI déclare que le système éducatif devrait s'adapter à ChatGPT, et non l'interdire

L'article Meta présente Segment Anything, son nouveau modèle d'IA pour la segmentation d'images est apparu en premier sur Metaverse Post.