La version open source du modèle Flamingo de DeepMind, OpenFlamingo, vient de sortir. OpenFlamingo est fondamentalement un framework qui permet la formation et l'évaluation de modèles multimodaux (LMM) de grande taille. OpenFlamingo est construit sur le grand modèle de langage LLaMA développé par Meta AI.

Lire la suite : Comment utiliser Midjourney gratuitement pour toujours : 5 étapes simples

Lire la suite : Comment utiliser Midjourney gratuitement pour toujours : 5 étapes simples

Les contributions des développeurs à cette première version sont les suivantes :

Un important ensemble de données multimodales qui combine des séquences textuelles et visuelles.

Une référence pour l'évaluation de l'apprentissage en contexte pour des activités incluant la vision et le langage.

Une version préliminaire de notre modèle OpenFlamingo-9B basé sur LLaMA.

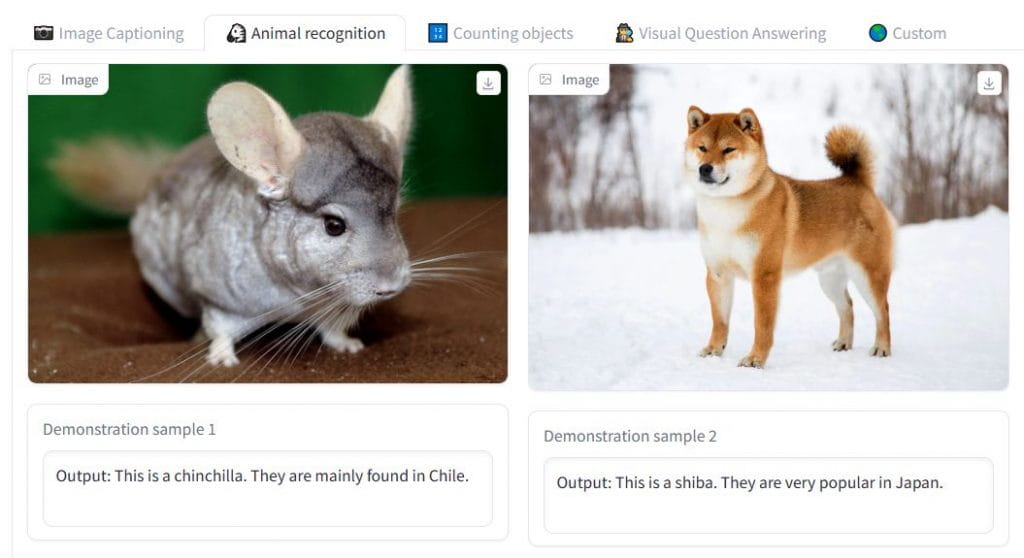

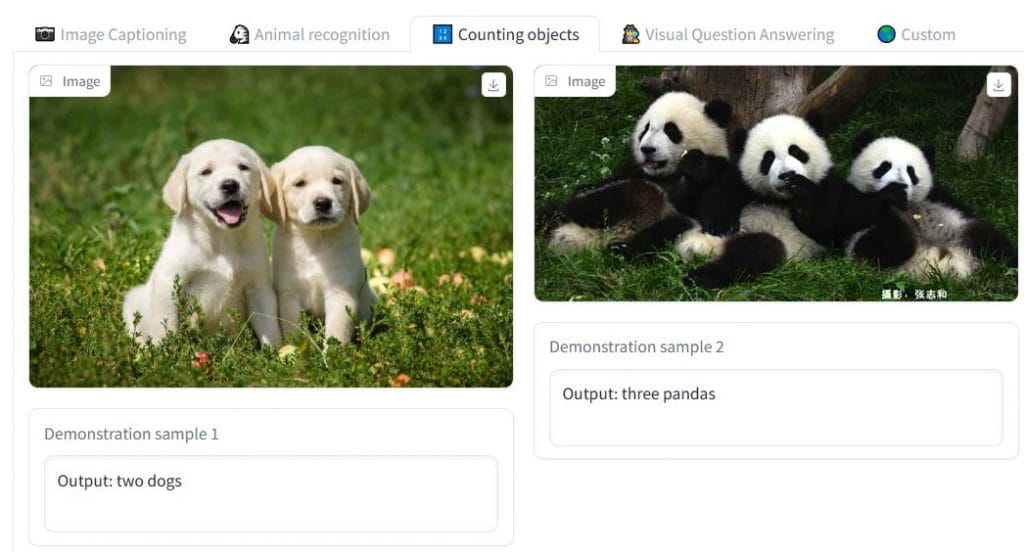

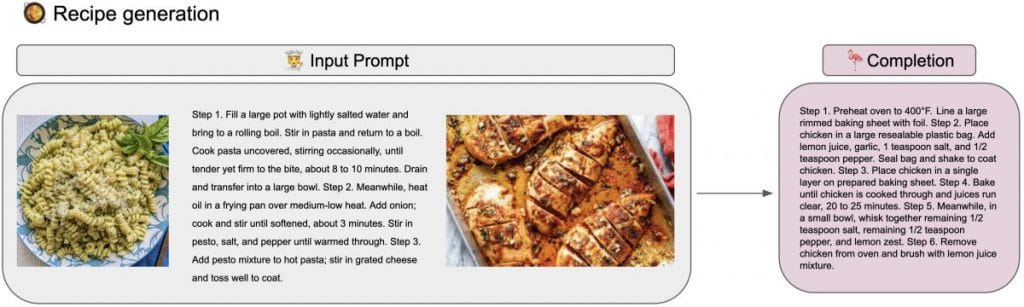

Grâce à OpenFlamingo, les développeurs espèrent créer un système multimodal capable de gérer une variété de défis en matière de langage de vision. L’objectif ultime est d’égaler la force et l’adaptabilité de GPT-4 dans la gestion de la saisie visuelle et textuelle. Les développeurs développent une version open source du modèle Flamingo de DeepMind, un LMM capable de traiter et de raisonner sur des images, des vidéos et du texte, afin d'atteindre cet objectif. Les développeurs se consacrent au développement de modèles entièrement open source car ils pensent que la transparence est cruciale pour promouvoir la coopération, accélérer le développement et démocratiser l'accès aux LMM de pointe.

Ils fournissent le point de contrôle initial de notre modèle OpenFlamingo-9B. Même si le modèle n’est pas encore entièrement optimisé, il montre la promesse du projet. Les développeurs peuvent former de meilleurs LMM en coopérant et en obtenant les commentaires de la communauté. Ils invitent le public à donner leur avis et à enrichir le référentiel afin de participer au processus de développement.

La mise en œuvre ressemble beaucoup à celle de Flamingo. Les modèles Flamingo doivent être formés sur des ensembles de données Web à grande échelle avec du texte et des graphiques entrelacés pour les doter de compétences d'apprentissage en quelques étapes en contexte. La même architecture qui a été suggérée dans l'étude originale de Flamingo (rééchantillonneurs Perceiver, couches d'attention croisée) est implémentée dans OpenFlamingo. Mais comme les données d’entraînement de Flamingo ne sont pas accessibles au grand public, les développeurs utilisent des ensembles de données open source pour entraîner les modèles. Le point de contrôle OpenFlamingo-9B récemment publié a été spécifiquement formé sur 10 millions d’échantillons de LAION-2B et 5 millions d’échantillons du nouvel ensemble de données multimodal C4.

Les développeurs incluent également un point de contrôle de notre LMM OpenFlamingo-9B inachevé, basé sur LLaMA 7B et CLIP ViT/L-14, dans le cadre de la version. Même si ce concept est encore en développement, la communauté pourrait déjà en bénéficier grandement.

Pour commencer, consultez la source et la démo GitHub.

En savoir plus sur l'IA :

Les coûts de formation des modèles d’IA devraient passer de 100 millions de dollars à 500 millions de dollars d’ici 2030

Le nouvel agent d'IA adaptative de DeepMind, Ada, est presque aussi intelligent qu'un humain

DeepMind a publié l'outil d'IA Dramatron, qui génère une ébauche complète du scénario d'un film ou d'une émission de télévision.

L'article OpenFlamingo : un nouveau cadre d'image en texte open source de Meta AI et LAION apparaît en premier sur Metaverse Post.