Autor: Yiping, IOSG Ventures

escribir delante

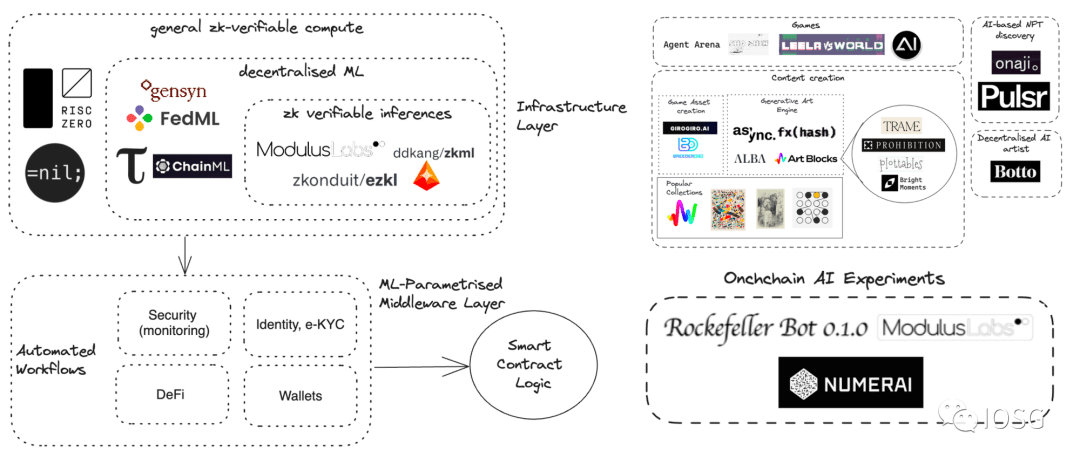

A medida que los modelos de lenguajes grandes (LLM) se vuelven cada vez más populares, vemos muchos proyectos que integran inteligencia artificial (IA) y blockchain. La combinación de LLM y blockchain está aumentando, y también vemos oportunidades para que la inteligencia artificial se reintegre con blockchain. Uno que vale la pena mencionar es el aprendizaje automático sin conocimiento (ZKML).

La inteligencia artificial y la cadena de bloques son dos tecnologías transformadoras con características fundamentalmente diferentes. La inteligencia artificial requiere una potencia informática potente, que normalmente la proporcionan los centros de datos centralizados. Si bien blockchain proporciona informática descentralizada y protección de la privacidad, tiene un rendimiento deficiente en tareas que requieren informática y almacenamiento a gran escala. Todavía estamos explorando y estudiando las mejores prácticas para la integración de inteligencia artificial y blockchain. También le presentaremos algunos casos de proyectos actuales que combinan "AI + blockchain" en el futuro.

Fuente: IOSG Ventures

Este informe de investigación se publica en dos partes: este artículo es la parte superior, nos centraremos en la aplicación de LLM en el campo del cifrado y exploraremos las estrategias de implementación de aplicaciones.

¿Qué es el LLM?

Un LLM (Large Language Model) es un modelo de lenguaje computarizado que consta de una red neuronal artificial con una gran cantidad de parámetros (generalmente miles de millones). Estos modelos se entrenan con grandes cantidades de texto sin etiquetar.

Alrededor de 2018, el nacimiento de LLM cambió por completo la investigación sobre el procesamiento del lenguaje natural. A diferencia de los métodos anteriores que requieren entrenar un modelo supervisado específico para una tarea específica, LLM, como modelo general, funciona bien en una variedad de tareas. Sus capacidades y aplicaciones incluyen:

Comprensión y resumen de texto: LLM puede comprender y resumir grandes cantidades de lenguaje humano y datos textuales. Pueden extraer información clave y generar resúmenes concisos.

Generar contenido nuevo: LLM tiene la capacidad de generar contenido basado en texto. Al proporcionar indicaciones al modelo, este puede responder preguntas, texto recién generado, resúmenes o análisis de sentimientos.

Traducción: LLM se puede utilizar para traducir entre diferentes idiomas. Utilizan algoritmos de aprendizaje profundo y redes neuronales para comprender el contexto y las relaciones entre las palabras.

Predecir y generar texto: LLM puede predecir y generar texto basándose en el contexto contextual, similar al contenido generado por humanos, incluidas canciones, poemas, historias, materiales de marketing y más.

Aplicaciones en diversos campos: los modelos de lenguaje grandes tienen una amplia aplicabilidad en tareas de procesamiento del lenguaje natural. Se utilizan en IA conversacional, chatbots, atención médica, desarrollo de software, motores de búsqueda, tutorías, herramientas de escritura y muchos más.

Las ventajas de LLM incluyen su capacidad para comprender grandes cantidades de datos, su capacidad para realizar múltiples tareas relacionadas con el lenguaje y su potencial para adaptar los resultados a las necesidades del usuario.

Aplicaciones comunes de modelos de lenguaje a gran escala.

Debido a sus excelentes capacidades de comprensión del lenguaje natural, LLM tiene un potencial considerable y los desarrolladores se centran principalmente en los dos aspectos siguientes:

Proporcionar a los usuarios respuestas precisas y actualizadas basadas en amplios datos y contenidos contextuales.

Completar tareas específicas asignadas por los usuarios utilizando diferentes agentes y herramientas.

Son estos dos aspectos los que han llevado a la proliferación de aplicaciones LLM para chatear con XX. Por ejemplo, chatee con archivos PDF, charle con documentos y charle con artículos académicos.

Posteriormente, se intentó fusionar LLM con varias fuentes de datos. Los desarrolladores han integrado con éxito plataformas como Github, Notion y algún software para tomar notas con LLM.

Para superar las limitaciones inherentes del LLM, se incorporan diferentes herramientas al sistema. La primera herramienta de este tipo fue un motor de búsqueda, que proporcionaba a LLM la posibilidad de acceder a los conocimientos más recientes. Un mayor progreso permitirá integrar herramientas como WolframAlpha, Google Suites y Etherscan con grandes modelos de lenguaje.

Arquitectura de aplicaciones LLM

La siguiente figura describe el flujo de una aplicación LLM para responder a las consultas de los usuarios: Primero, las fuentes de datos relevantes se convierten en vectores integrados y se almacenan en una base de datos de vectores. El adaptador LLM utiliza consultas de usuarios y búsquedas de similitudes para encontrar contexto relevante en la base de datos de vectores. El contexto relevante se coloca en un mensaje y se envía a LLM. LLM ejecutará estas indicaciones y utilizará herramientas para generar respuestas. A veces, los LLM se ajustan a conjuntos de datos específicos para mejorar la precisión y reducir los costos.

El flujo de trabajo de una solicitud de LLM se puede dividir en términos generales en tres etapas principales:

Preparación e incorporación de datos: esta fase implica conservar información confidencial (como notas de proyecto) para acceso futuro. Normalmente, los archivos se segmentan, se procesan mediante modelos integrados y se almacenan en un tipo especial de base de datos llamada base de datos vectorial.

Formulación y extracción de mensajes: cuando un usuario envía una solicitud de búsqueda (en este caso, buscando información del proyecto), el software crea una serie de mensajes y los ingresa en el modelo de lenguaje. El mensaje final generalmente contiene una plantilla de mensaje codificada por el desarrollador del software, un ejemplo de salida válido como un ejemplo de algunas tomas y los números requeridos obtenidos de la API externa y los archivos relacionados extraídos de la base de datos vectorial.

Ejecución e inferencia de indicaciones: una vez que se completan las indicaciones, se envían a un modelo de lenguaje preexistente para su inferencia, que puede incluir API de modelo patentado, código abierto o modelos ajustados individualmente. En esta etapa, algunos desarrolladores también pueden integrar sistemas operativos (como registro, almacenamiento en caché y validación) en el sistema.

Llevando LLM a la criptografía

Aunque el campo del cifrado (Web3) tiene algunas aplicaciones similares a las de Web2, desarrollar buenas aplicaciones LLM en el campo del cifrado requiere especial precaución.

El ecosistema criptográfico es único, con su propia cultura, datos y convergencia. Los LLM optimizados en estos conjuntos de datos criptográficamente restringidos pueden proporcionar resultados superiores a un costo relativamente bajo. Si bien hay abundantes datos disponibles, existe una clara falta de conjuntos de datos abiertos en plataformas como HuggingFace. Actualmente, solo existe un conjunto de datos relacionados con contratos inteligentes, que contiene 113.000 contratos inteligentes.

Los desarrolladores también enfrentan el desafío de integrar diferentes herramientas en LLM. Estas herramientas son diferentes de las utilizadas en Web2 y brindan a LLM la capacidad de acceder a datos relacionados con transacciones, interactuar con aplicaciones descentralizadas (Dapps) y ejecutar transacciones. Hasta el momento, no hemos encontrado ninguna integración de Dapps en Langchain.

Aunque el desarrollo de aplicaciones LLM criptográficas de alta calidad puede requerir una inversión adicional, el LLM es una opción natural para el mundo criptográfico. Este dominio proporciona datos ricos, limpios y estructurados. Junto con el hecho de que el código de Solidity es generalmente conciso y claro, esto facilita que LLM genere código funcional.

En (Parte 2), discutiremos 8 direcciones potenciales en las que LLM puede ayudar al campo blockchain, tales como:

Integre capacidades integradas de IA/LLM en la cadena de bloques

Analizar registros de transacciones usando LLM

Identificar bots potenciales utilizando LLM

Escribir código usando LLM

Leer código usando LLM

Ayude a la comunidad con LLM

Seguimiento del mercado con LLM

Analizar proyectos usando LLM