El creciente problema de fiabilidad en la inteligencia artificial

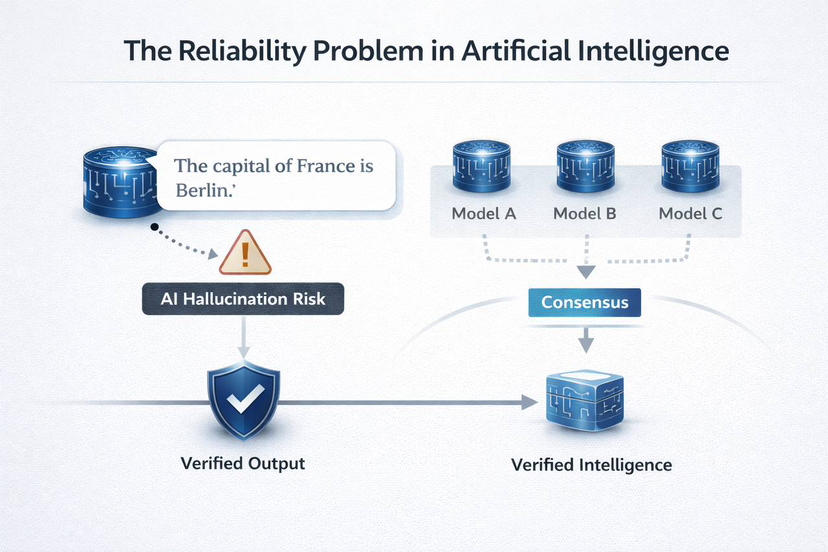

En los últimos años he notado algo interesante sobre la inteligencia artificial. La tecnología se está volviendo increíblemente poderosa, pero al mismo tiempo hay un problema silencioso del que la mayoría de las personas no habla lo suficiente. La IA puede sonar muy segura incluso cuando está equivocada. Cualquiera que haya utilizado herramientas modernas de IA probablemente ha experimentado esto. Haces una pregunta y el sistema da una respuesta clara, a veces incluso con explicaciones y referencias. Pero luego te das cuenta de que alguna parte de la respuesta era incorrecta.

Esto sucede porque la mayoría de los sistemas de IA funcionan prediciendo la próxima palabra más probable en lugar de probar hechos. Son extremadamente buenos produciendo lenguaje que parece correcto, pero eso no significa que la información sea siempre precisa. Este problema a menudo se llama “alucinación de IA.” Incluso los modelos avanzados a veces producen información incorrecta o sesgada, lo que los hace difíciles de confiar en áreas importantes como finanzas, educación, atención médica o derecho.

Por qué la verificación podría importar más que la inteligencia

El concepto de Mira se vuelve más comprensible una vez que consideras la forma en que los humanos confirman la información. En ciencia, difícilmente se puede creer una afirmación hecha por un individuo. La declaración es puesta a prueba por otros investigadores, recreando el experimento y verificando la evidencia. No es hasta que este reclamo se demuestra una y otra vez que se convierte en conocimiento aceptado.

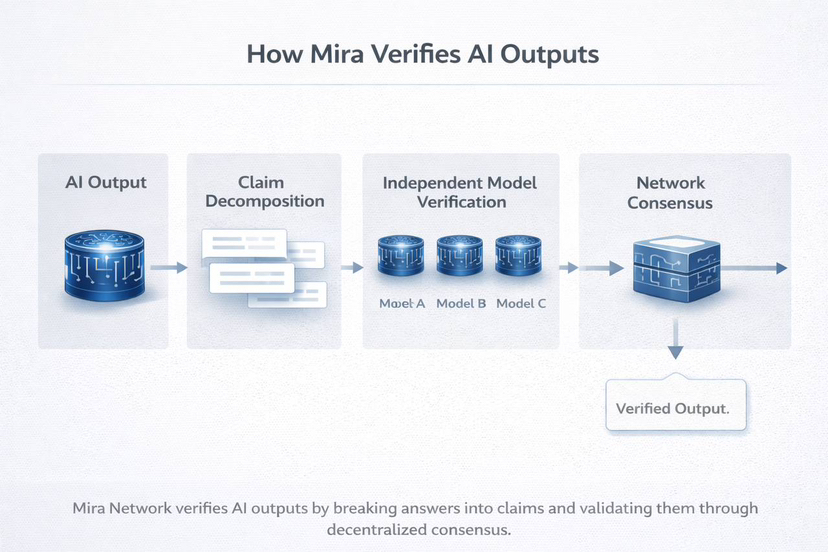

Mira intenta transferir un valor comparable a la inteligencia artificial. La salida de modelo de un solo modelo no se confía automáticamente en la red. En cambio, descompone una respuesta de IA en reclamos más pequeños que pueden ser verificados. Estas afirmaciones se envían a un número de modelos independientes o nodos de verificación que las examinan individualmente.

Lo que es interesante en este diseño es que ve la verdad como algo que surge del consenso entre diversas actitudes en lugar de ser algo que se interpreta centralmente.

El propósito de la descentralización del sistema.

El otro aspecto que hace que Mira se destaque en mi opinión es la manera en que se organiza su verificación. La red no depende de una sola empresa o servidor centralizado para llevar a cabo la verificación, sino de un gran número de participantes independientes. Estos participantes ejecutan varios modelos de IA y reclamos presentados a la red.

Esta organización descentralizada es importante ya que elimina las posibilidades de favoritismo o manipulación. Cuando la verificación es realizada por una sola organización, existe la posibilidad de que esté sesgada sobre qué respuestas deben considerarse aceptables. Sin embargo, una vez que el número de validadores independientes es grande, el resultado será más equilibrado.

En términos simples, Mira está intentando establecer una capa de confianza con inteligencia artificial.

Motivos que hacen que el sistema sea honesto.

Los incentivos son una de las cosas que nunca descuido al estudiar proyectos de criptomonedas. La tecnología por sí sola es insuficiente. Estos sistemas tienden a funcionar, ya que los individuos son castigados si no actúan correctamente.

Mira propone un sistema de incentivos con tokens que motiva a los validadores a enviar la verificación correcta. Los interesados pueden hacer apuestas para unirse a la red y obtener una recompensa cuando realizan la verificación correctamente. En caso de que ofrezcan una verificación negligente o falsa, parte de su participación puede perderse.

Otro enfoque de pensar en la infraestructura de IA.

Cuanto menos considero a Mira, más parece ser un proyecto de infraestructura y no otro token de criptomonedas. No busca hacer un chatbot más excelente o un modelo más inteligente. Más bien, se preocupa por algo más profundo: asegurar que las salidas de IA sean creíbles.

Mira está buscando el concepto de que no es solo la inteligencia lo que es suficiente. Lo que necesitamos es la inteligencia en la que podemos confiar.