Es gibt einen Punkt in den meisten Web3-Spielen, an dem die Illusion bricht. Es passiert nicht sofort. Zunächst fühlt sich alles ansprechend an, sogar belohnend. Aber nach einer Weile zeigt sich das Muster. Handlungen fühlen sich nicht mehr wie Entscheidungen an, sondern wie Berechnungen. Du spielst nicht wirklich mehr. Du extrahierst.

Ich erwartete das Gleiche, als ich in @Pixels ging. Zunächst dachte ich, es sei nur eine weitere Farming-Schleife mit besserem Design und reibungsloser Einarbeitung. Aufgaben erledigen, Belohnungen verdienen, Routen optimieren, wiederholen. Es sah vertraut genug aus, um das gleiche Ergebnis anzunehmen. Ein weiteres System, in dem Effizienz leise Genuss ersetzt.

Aber etwas passte nicht ganz. Die Spieler fielen nicht in eine einzige optimale Strategie zusammen. Einige Ineffizienzen blieben. Einige Aktionen maximierten nicht die Ergebnisse. Und dennoch hielten sie durch. Das passiert normalerweise nicht in einer reinen Belohnungsschleife. Es deutet darauf hin, dass das System nicht nur für Aktivität bezahlt. Es wählt etwas Tieferes aus.

Die meisten GameFi-Ökonomien scheitern auf der Anreizebene. Nicht, weil das Gameplay schwach ist, sondern weil das System das falsche Verhalten belohnt. Feste, vorhersehbare Belohnungen verwandeln alles in eine Berechnung. Und sobald das passiert, wird die dominante Strategie zur Extraktion. Bots und optimierte Spieler nutzen nicht nur das System aus, sie werden zu ihm.

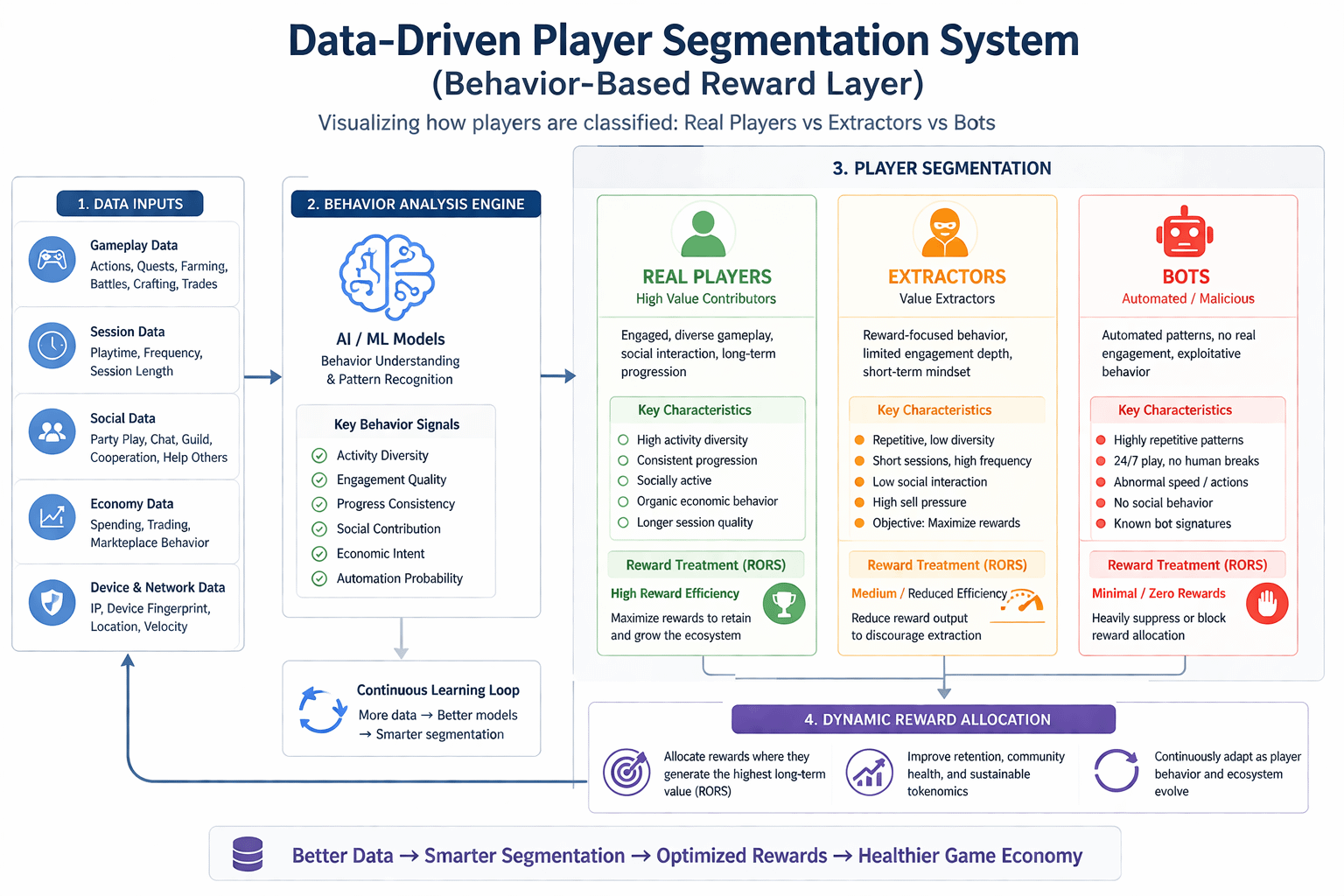

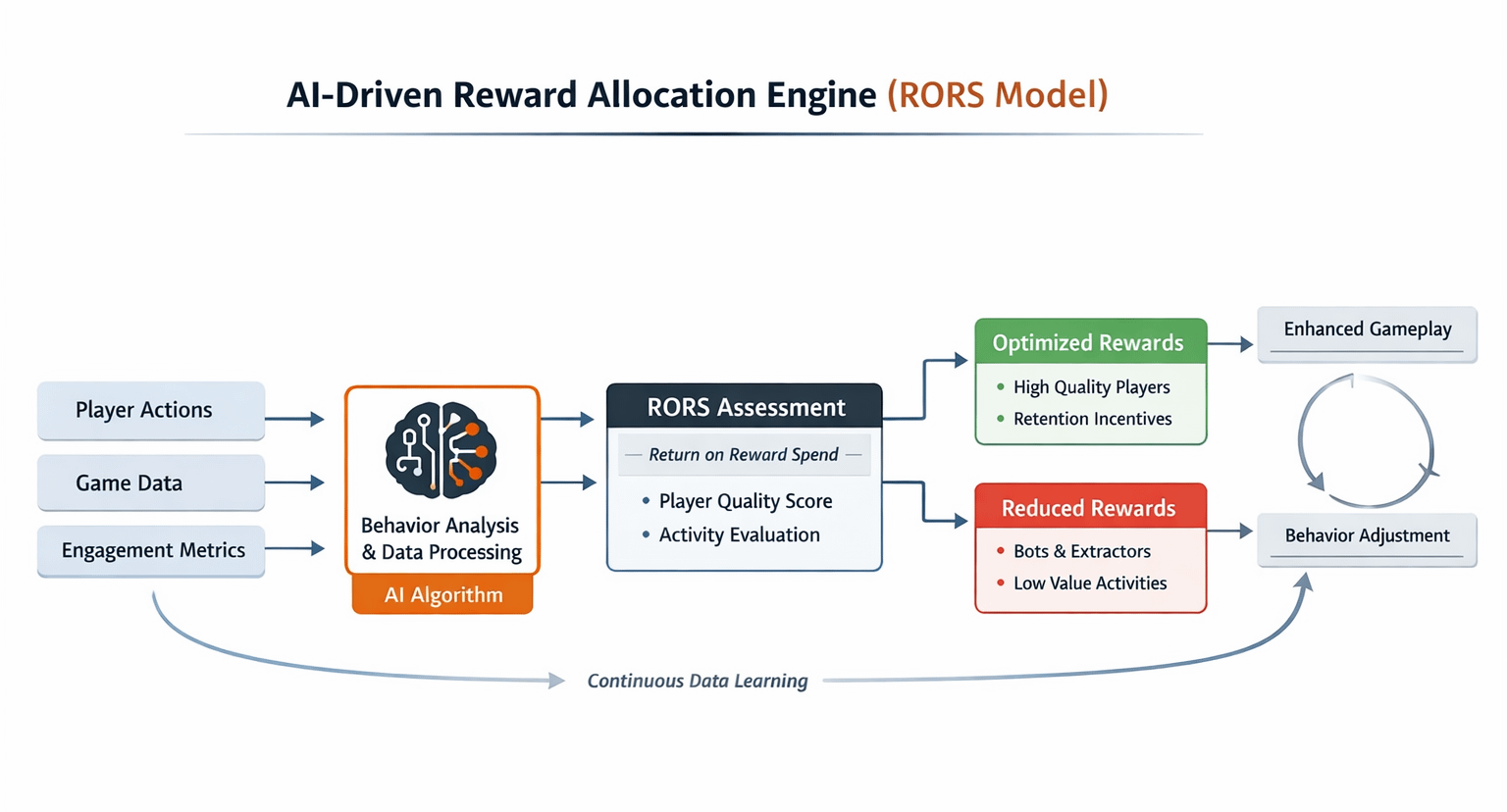

Pixels geht das anders an. Es behandelt Belohnungen weniger wie Emissionen und mehr wie Kapital, das mit Absicht zugeordnet werden muss. Das Team nennt dies RORS, Return on Reward Spend. Nicht wie viel du ausgibst, sondern wie effektiv diese Belohnungen in bedeutungsvolles Engagement übersetzen. Es ist ein Wechsel von Verteilung zu Effizienz.

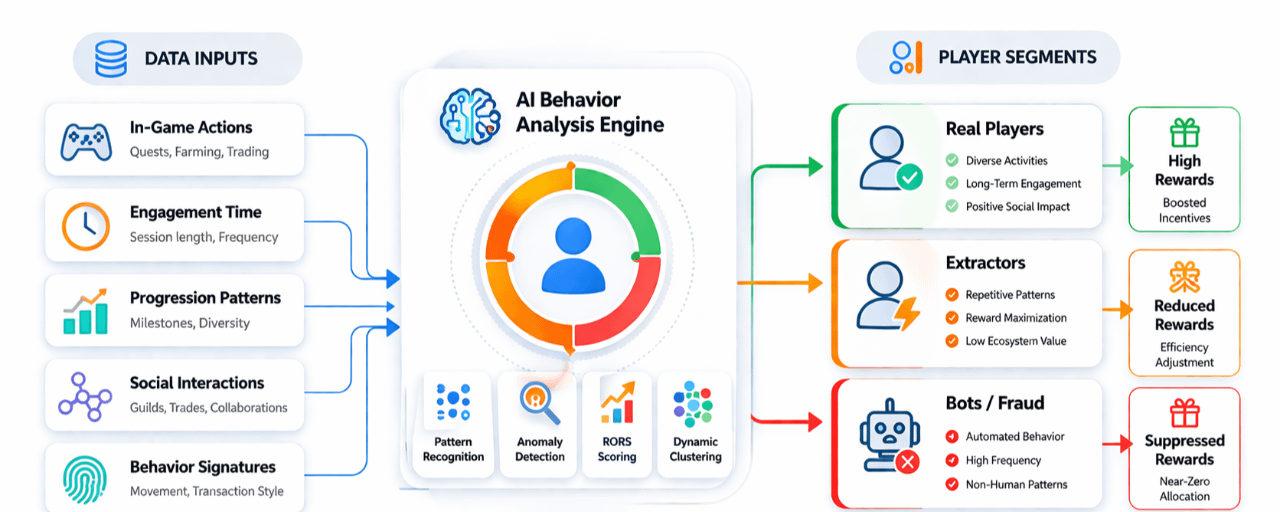

Im Kern ist Pixels ein datengestütztes Belohnungssystem. Nicht alle Spieler werden gleich behandelt - und das ist der Punkt. Das System segmentiert Verhalten implizit. Es lernt, wer zum Ökosystem beiträgt und wer einfach davon profitiert, und passt die Belohnungen entsprechend an. Im Laufe der Zeit verändert sich, welches Verhalten dominant wird.

Das stellt das Anti-Bot-Problem völlig neu dar. Es geht nicht wirklich um Erkennung im traditionellen Sinne. Das System fragt nicht: „Ist das ein Bot?“ Es fragt: „Ist dieses Verhalten es wert, dafür zu bezahlen?“ In einer gegnerischen Umgebung, in der Bots sich ständig weiterentwickeln, ist diese Unterscheidung wichtiger als die Identität. Das System muss schlechte Akteure nicht perfekt erkennen. Es muss sie konsequent unprofitabel machen.

Man kann es sich wie eine Schleife vorstellen. Spieler generieren Daten. Daten speisen die Belohnungsverteilung. Belohnungen verschieben sich in Richtung Verhaltensweisen, die Bindung und Tiefe verbessern. Diese Spieler bleiben länger und engagieren sich mehr. Das schafft bessere Daten, die das System weiter schärfen. Es ist eine Rückkopplungsschleife, die darauf ausgelegt ist, die richtige Art von Teilnahme zu verstärken.

Vergleiche das mit der Standard GameFi-Schleife. Nutzer kommen rein, farmen aggressiv, verkaufen Belohnungen und gehen. Der Preis sinkt, Anreize schwächen sich, und die nächste Welle von Nutzern hat noch weniger Grund zu bleiben. Es ist eine negative Schleife, die sich schnell verstärkt. Das System passt sich nicht an. Es drainiert einfach.

Was Pixels aufbaut, sieht mehr aus wie eine lebende Belohnungsmaschine, die unter ständigem Druck arbeitet. Nicht nur ein Spiel, nicht nur ein Token, sondern ein System, das versucht, Verhalten in Echtzeit richtig zu bewerten. Und wenn sich das über ein einzelnes Spiel hinaus ausdehnt, vervielfacht sich der Vorteil. Mehr Spiele bringen mehr Spieler. Mehr Spieler generieren mehr Daten. Bessere Daten führen zu präziseren Belohnungsverteilungen. Dort beginnt das Verlags-Flywheel wichtig zu werden.

Aber nichts davon funktioniert ohne Skalierung. Zu Beginn sind die Daten dünn. Das Signal ist laut. Es ist schwieriger, zwischen wirklich wertvollem Verhalten und hoch optimierter Extraktion zu unterscheiden. Und wenn das System das auch zu oft falsch macht, riskiert es, die Muster zu verstärken, die es zu unterdrücken versucht. In diesem Sinne ist das System nicht nur anpassungsfähig, es ist auch zerbrechlich in seinen frühen Phasen.

Hier gibt es auch eine tiefere Spannung. Wenn Belohnungen ständig optimiert werden, passen sich die Spieler an. Sie suchen nach neuen Vorteilen, neuen Mustern, neuen Wegen, um Ergebnisse zu maximieren. Das System entwickelt sich weiter, aber das tun auch die Nutzer. Es wird zu einem fortlaufenden Verhandlungsprozess zwischen Anreizen und Verhalten, nicht zu einem festen Design. In einer gegnerischen Umgebung existiert Gleichgewicht nicht wirklich.

Der Token sitzt genau im Zentrum dieser Dynamik. $PIXEL kann nicht einfach als Emission fungieren. Wenn es das tut, dann speist selbst ein gut optimiertes System letztendlich denselben Druck, das Angebot wächst schneller als die Nachfrage. Ohne starke Senken und echten Nutzen im Spiel verzögert die Optimierung nur das Ergebnis. Sie ändert es nicht.

Das bringt alles zurück zur Bindung. Keine kurzfristigen Spitzen, keine Belohnungsexplosionen, sondern tatsächliches Spieler Verhalten über die Zeit. Kommen die Spieler zurück, wenn die Belohnungen schwanken? Engagieren sie sich, wenn es keinen offensichtlichen optimalen Weg gibt? Denn Nutzen funktioniert nur, wenn jemand morgen wieder erscheint.

So #pixel sieht nicht wirklich wie ein Anti-Bot-System aus, wenn man herauszoomt. Es sieht aus wie ein Versuch, Kapital intelligent in einer feindlichen Umgebung zuzuordnen. Um Verhalten zu belohnen, das sich vervielfacht. Um Wert nicht nach Identität, sondern nach Beitrag zu filtern.

Das Konzept macht Sinn.

Die Ausführung ist schwierig.

Die Umgebung ist gegnerisch.

Wenn das Verhalten anhält, folgt alles andere.