Nguồn bài viết được in lại: AGIing

Ba chip Nvidia AI mới này không phải là "phiên bản cải tiến" mà là "phiên bản thu nhỏ". Trong số đó, HGX H20 có những hạn chế về băng thông, tốc độ tính toán,… Dự kiến giá H20 sẽ giảm nhưng vẫn sẽ giảm. thấp hơn chip AI trong nước. Chip 910B cao hơn.

Nguồn gốc: TMTpost Media

Tác giả: Lâm Chí Giai

Nguồn hình ảnh: Được tạo bởi AI không giới hạn

Vào ngày 10 tháng 11, gần đây có thông tin cho rằng gã khổng lồ chip NVIDIA sẽ tung ra ba chip AI dựa trên H100 cho thị trường Trung Quốc để đối phó với các biện pháp kiểm soát xuất khẩu chip mới nhất tại Hoa Kỳ.

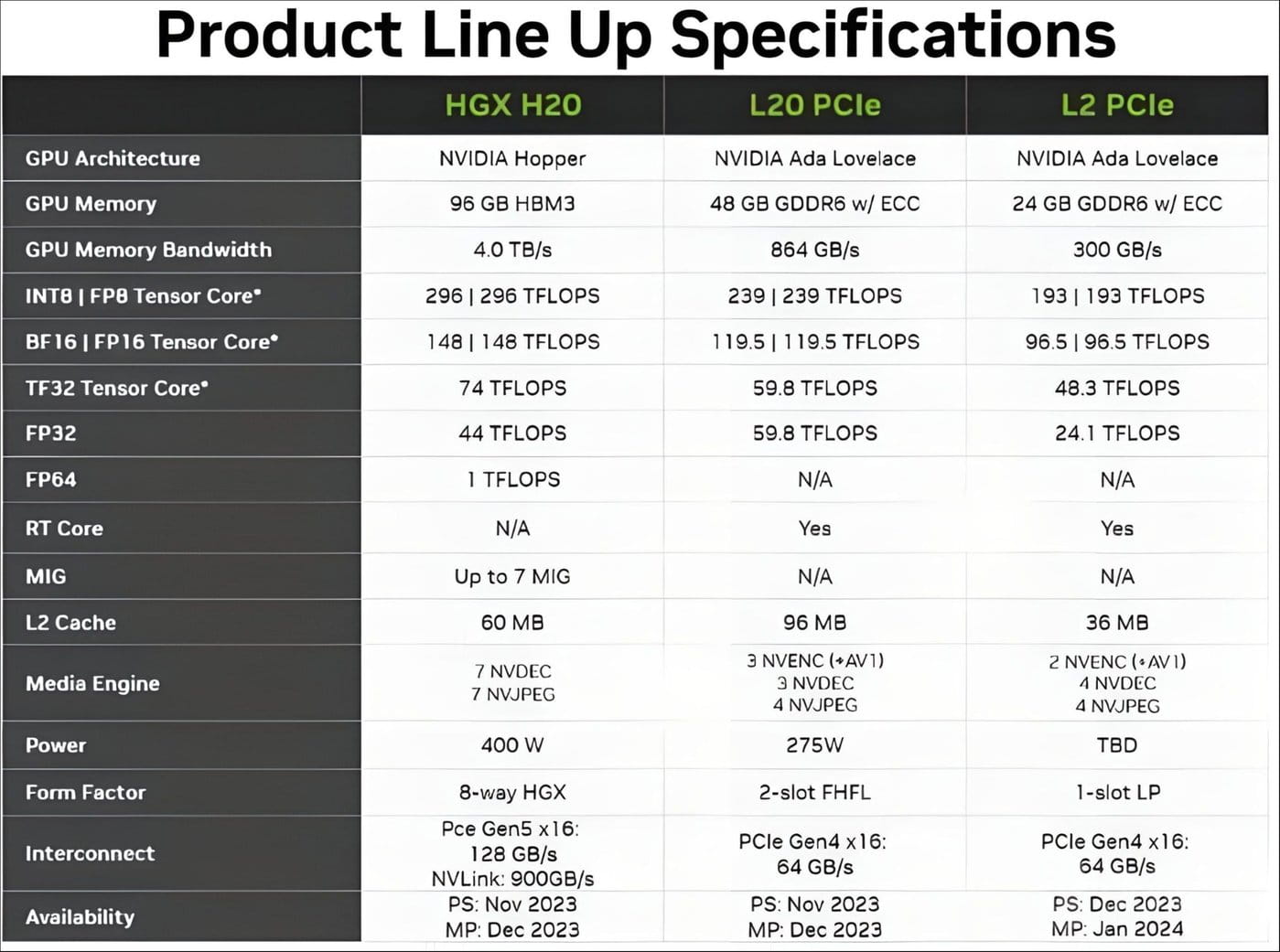

Tài liệu thông số kỹ thuật cho thấy Nvidia sẽ sớm ra mắt các sản phẩm mới có tên HGX H20, L20 PCle và L2 PCle cho khách hàng Trung Quốc, dựa trên kiến trúc Hopper và Ada Lovelace của Nvidia. Đánh giá từ thông số kỹ thuật và cách đặt tên, ba sản phẩm này nhằm mục đích đào tạo, suy luận và các kịch bản biên. Chúng sẽ được công bố ngay sau ngày 16 tháng 11. Thời gian lấy mẫu sản phẩm sẽ từ tháng 11 đến tháng 12 năm nay và thời gian sản xuất hàng loạt sẽ là. từ tháng 12 đến tháng 1 năm sau.

Ứng dụng TMTpost đã được biết từ nhiều công ty thuộc chuỗi công nghiệp NVIDIA rằng tin tức trên là đúng.

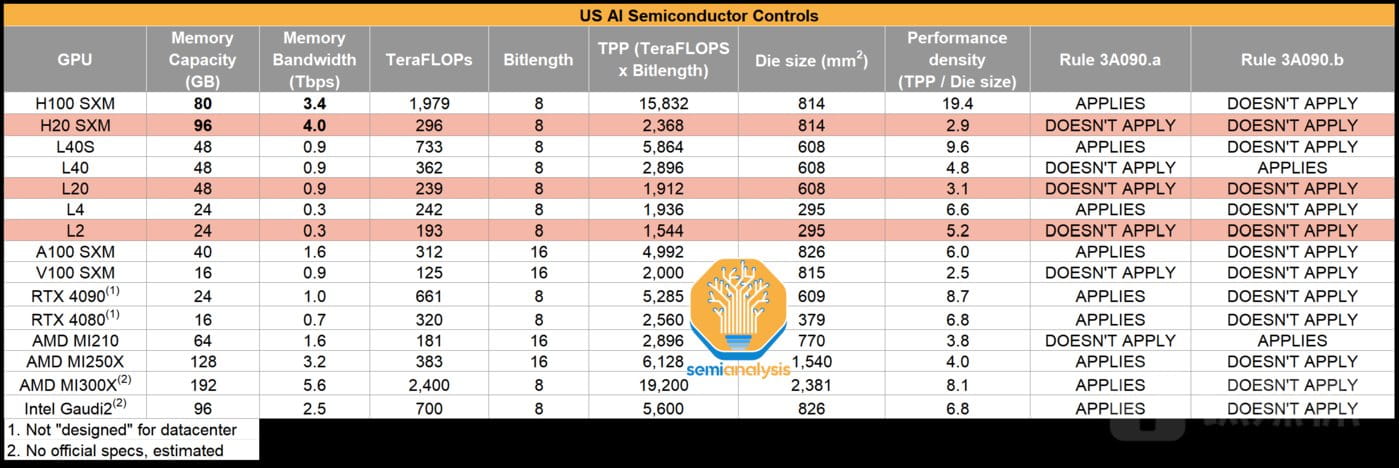

TMTpost Media App cũng độc quyền biết rằng ba chip AI của Nvidia không phải là “phiên bản cải tiến” mà là “phiên bản thu nhỏ”. Trong số đó, HGX H20 dùng để huấn luyện mô hình AI có những hạn chế về băng thông, tốc độ tính toán,… Về lý thuyết, sức mạnh tính toán tổng thể thấp hơn khoảng 80% so với chip GPU NVIDIA H100, tức là H20 chỉ bằng 20% hiệu suất năng lượng tính toán toàn diện của H100, đồng thời bổ sung bộ nhớ HBM và các mô-đun kết nối NVLink để tăng chi phí năng lượng tính toán. Vì vậy, dù giá HGX H20 sẽ giảm so với H100 nhưng dự kiến giá của sản phẩm này vẫn sẽ cao hơn so với chip AI nội địa 910B.

“Việc này tương đương với việc mở rộng làn đường cao tốc nhưng lối vào trạm thu phí không được mở rộng, hạn chế lưu lượng. Cũng về mặt kỹ thuật, thông qua khóa phần cứng và phần mềm, hiệu suất của chip có thể được kiểm soát chính xác, không cần thay thế dây chuyền sản xuất quy mô lớn. Ngay cả khi phần cứng được nâng cấp, hiệu suất vẫn có thể được điều chỉnh khi cần thiết. Hiện tại, hiệu suất của H20 mới đã bị 'kẹt' từ nguồn. H100 ban đầu được sử dụng để chạy một nhiệm vụ, phải mất 20 ngày và bây giờ có thể phải mất 100 ngày để H20 chạy lại.

Mặc dù Hoa Kỳ đã ban hành một đợt hạn chế chip mới nhưng Nvidia dường như không từ bỏ thị trường sức mạnh tính toán AI khổng lồ của Trung Quốc.

Vậy chip nội địa có thay thế được không? TMTpost Media App được biết sau khi thử nghiệm, chip AI nội địa 910B hiện nay chỉ có thể đạt khoảng 60%-70% A100 về khả năng suy luận mô hình lớn, khiến việc đào tạo mô hình cụm không bền vững, đồng thời, 910B gặp vấn đề về sức mạnh tính toán; mức tiêu thụ, sinh nhiệt, v.v. Nó cao hơn nhiều so với các sản phẩm dòng NVIDIA A100/H100 ở các khía cạnh khác và không tương thích với CUDA, gây khó khăn cho việc đáp ứng đầy đủ nhu cầu đào tạo mô hình của các trung tâm điện toán thông minh lâu dài.

Hiện tại, các quan chức của Nvidia vẫn chưa đưa ra bất kỳ bình luận nào về việc này.

Được biết, vào ngày 17 tháng 10 năm nay, Cục Công nghiệp và An ninh (BIS) của Bộ Thương mại Hoa Kỳ đã ban hành các quy định kiểm soát xuất khẩu mới đối với chip, áp đặt các biện pháp kiểm soát xuất khẩu mới đối với các sản phẩm bán dẫn bao gồm chip AI hiệu suất cao của Nvidia mà các điều khoản hạn chế đã có; Có hiệu lực từ ngày 23 tháng 10 Hồ sơ của NVIDIA gửi lên SEC Hoa Kỳ cho thấy các sản phẩm bị cấm có hiệu lực ngay lập tức bao gồm các chip AI mạnh nhất là A800, H800 và L40S.

Ngoài ra, bộ xử lý chip L40 và RTX 4090 vẫn giữ nguyên khoảng thời gian 30 ngày ban đầu.

Vào ngày 31 tháng 10, có thông tin Nvidia có thể buộc phải hủy các đơn đặt hàng chip cao cấp trị giá 5 tỷ USD. Bị ảnh hưởng bởi thông tin này, giá cổ phiếu của Nvidia giảm mạnh. Trước đây, A800 và H800 của NVIDIA được cung cấp độc quyền cho Trung Quốc không thể bán được ở thị trường Trung Quốc do quy định mới của Mỹ. Hai con chip này được gọi là "phiên bản thiến" của A100 và H100. với các quy định trước đây của Hoa Kỳ để cải thiện hiệu suất chip.

Vào ngày 31 tháng 10, Zhang Xin, người phát ngôn của Hội đồng Xúc tiến Thương mại Quốc tế Trung Quốc, tuyên bố rằng các quy định kiểm soát xuất khẩu chất bán dẫn mới được Hoa Kỳ ban hành sang Trung Quốc đã thắt chặt hơn nữa các hạn chế đối với việc xuất khẩu chip liên quan đến trí tuệ nhân tạo và sản xuất chất bán dẫn. thiết bị sang Trung Quốc, đồng thời liệt kê một số thực thể Trung Quốc vào danh sách "thực thể" kiểm soát xuất nhập khẩu. Các biện pháp này của Mỹ vi phạm nghiêm trọng các nguyên tắc kinh tế thị trường cũng như các quy tắc kinh tế và thương mại quốc tế, làm trầm trọng thêm nguy cơ xé nát và phân mảnh chuỗi cung ứng bán dẫn toàn cầu. Lệnh cấm xuất khẩu chip sang Trung Quốc do Mỹ thực hiện bắt đầu từ nửa cuối năm 2022 đang làm thay đổi sâu sắc cung cầu toàn cầu, gây mất cân bằng nguồn cung chip vào năm 2023, ảnh hưởng đến mô hình ngành công nghiệp chip thế giới và gây tổn hại đến lợi ích của các công ty từ nhiều quốc gia khác nhau, bao gồm cả các công ty Trung Quốc.

So sánh thông số hiệu năng giữa NVIDIA HGX H20, L20, L2 và các sản phẩm khác

Ứng dụng TMTpost Media được biết rằng các sản phẩm chip AI HGX H20, L20 và L2 mới lần lượt dựa trên kiến trúc Hopper và Ada của NVIDIA và phù hợp cho việc đào tạo trên đám mây, lý luận đám mây và lý luận biên.

Trong số đó, các sản phẩm suy luận AI của hai L20 và L2 sau có giải pháp "thay thế trong nước" và tương thích CUDA tương tự, trong khi HGX H20 là sản phẩm chip đào tạo AI dựa trên H100 và thông qua việc thiến chương trình cơ sở. Nó chủ yếu thay thế A100/. Ở Trung Quốc, ngoài NVIDIA, có rất ít giải pháp nội địa tương tự về đào tạo người mẫu.

Tài liệu cho thấy H20 mới có công nghệ đóng gói tiên tiến CoWoS và bổ sung HBM3 (bộ nhớ hiệu suất cao) lên 96GB, nhưng chi phí cũng tăng thêm 240 USD; sức mạnh tính toán dày đặc FP16 của H20 đạt 148TFLOPS (hàng nghìn tỷ phép tính nổi mỗi giây) .. point operator), chiếm khoảng 15% sức mạnh tính toán của H100 nên cần thêm các thuật toán và chi phí nhân sự; NVLink được nâng cấp từ 400GB/s lên 900GB/s nên tốc độ kết nối sẽ được nâng cấp rất nhiều.

Theo đánh giá, H100/H800 là giải pháp thực tiễn chủ đạo hiện nay cho các cụm năng lượng điện toán. Trong số đó, giới hạn lý thuyết của H100 là cụm 50.000 thẻ, với công suất tính toán tối đa là 100.000P; cụm thực tế tối đa của H800 là 20.000-30.000 thẻ, với tổng công suất tính toán là 40.000P; A100 là 16.000 thẻ, Công suất tính toán tối đa là 9600P.

Tuy nhiên, hiện nay chip H20 mới có giới hạn lý thuyết là 50.000 thẻ trong một cụm, nhưng mỗi thẻ có công suất tính toán là 0,148P, tổng công suất tính toán gần 7400P, thấp hơn H100/H800 và A100. Do đó, quy mô cụm H20 nhỏ hơn nhiều so với quy mô lý thuyết của H100. Dựa trên ước tính về sức mạnh tính toán và sự cân bằng truyền thông, sức mạnh tính toán trung bình tổng thể hợp lý là khoảng 3000P. Cần thêm nhiều chi phí và nhiều sức mạnh tính toán hơn để hoàn thành. hàng nghìn thao tác. Huấn luyện mô hình với hàng tỷ tham số.

Hai chuyên gia ngành bán dẫn nói với TMTpost App rằng dựa trên ước tính thông số hiệu năng hiện tại, rất có thể sản phẩm GPU NVIDIA B100 sẽ không còn được bán sang thị trường Trung Quốc vào năm tới.

Nhìn chung, nếu một công ty mô hình lớn muốn tiến hành đào tạo mô hình lớn với các thông số như GPT-4 thì quy mô của cụm máy tính là cốt lõi. Hiện tại, chỉ có H800 và H100 là có khả năng đào tạo mô hình lớn, còn hiệu suất của trong nước. 910B nằm giữa A100 và H100 Ở giữa, đây chỉ là "lựa chọn cuối cùng".

Ngày nay, H20 mới do NVIDIA ra mắt phù hợp hơn cho việc đào tạo và lý luận mô hình dọc. Nó không thể đáp ứng nhu cầu đào tạo của các mô hình lớn cấp nghìn tỷ. Tuy nhiên, hiệu suất tổng thể cao hơn một chút so với 910B. Cùng với hệ sinh thái CUDA của NVIDIA, nó chặn. hạn chế về chip ở Hoa Kỳ Theo lệnh, thẻ nội địa sẽ có sự lựa chọn duy nhất trên thị trường chip AI của Trung Quốc trong tương lai.

Báo cáo tài chính mới nhất cho thấy trong quý kết thúc vào ngày 30 tháng 7, hơn 85% doanh thu trị giá 13,5 tỷ USD của Nvidia đến từ Hoa Kỳ và Trung Quốc, và chỉ khoảng 14% doanh thu đến từ các quốc gia và khu vực khác.

Bị ảnh hưởng bởi tin tức H20, tính đến thời điểm thị trường chứng khoán Mỹ đóng cửa vào ngày 9/11, giá cổ phiếu của NVIDIA đã tăng nhẹ 0,81%, đóng cửa ở mức 469,5 USD/cổ phiếu. Trong 5 ngày giao dịch vừa qua, Nvidia đã tăng hơn 10%, với giá trị thị trường mới nhất đạt 1,16 nghìn tỷ USD.