Tiêu đề gốc: "Từ GPT-1 đến GPT-4, hãy nhìn sự trỗi dậy của ChatGPT"

Tác giả gốc: Ghi chú nghiên cứu về thỏ Alpha

ChatGPT là gì?

ChatGPT là gì?

Mới đây, OpenAI đã cho ra mắt ChatGPT, một mô hình có thể tương tác theo kiểu đàm thoại, được nhiều người dùng đón nhận vì tính thông minh của nó. ChatGPT cũng là họ hàng của InstructGPT do OpenAI phát hành trước đó, mô hình ChatGPT được huấn luyện bằng RLHF (Reinforcement learning with human phản hồi) Có lẽ sự xuất hiện của ChatGPT cũng là khúc dạo đầu trước khi GPT-4 của OpenAI chính thức ra mắt.

GPT là gì? Từ GPT-1 đến GPT-3

Generative Pre-training Transformer (GPT) là mô hình học sâu tạo văn bản được đào tạo trên dữ liệu có sẵn trên Internet. Nó được sử dụng để trả lời câu hỏi, tóm tắt văn bản, dịch máy, phân loại, tạo mã và AI đàm thoại.

Năm 2018, GPT-1 ra đời cũng là năm đầu tiên đào tạo các mô hình đào tạo trước về NLP (xử lý ngôn ngữ tự nhiên). Về hiệu suất, GPT-1 có khả năng khái quát hóa nhất định và có thể được sử dụng trong các nhiệm vụ NLP không liên quan gì đến nhiệm vụ giám sát. Các nhiệm vụ phổ biến bao gồm:

Lập luận ngôn ngữ tự nhiên: xác định mối quan hệ giữa hai câu (ngăn chặn, mâu thuẫn, trung lập)

Câu hỏi và câu trả lời và lý luận thông thường: nhập một bài viết và một số câu trả lời và đưa ra độ chính xác của câu trả lời

Nhận dạng sự giống nhau về mặt ngữ nghĩa: Xác định xem hai câu có liên quan về mặt ngữ nghĩa hay không

Danh mục: Xác định văn bản đầu vào thuộc danh mục nào

Mặc dù GPT-1 có một số tác dụng đối với các tác vụ chưa được điều chỉnh nhưng khả năng khái quát hóa của nó thấp hơn nhiều so với các tác vụ được giám sát đã được tinh chỉnh. Do đó, GPT-1 chỉ có thể được coi là một công cụ hiểu ngôn ngữ khá tốt hơn là một AI đàm thoại.

GPT-2 cũng xuất hiện như dự kiến vào năm 2019. Tuy nhiên, GPT-2 không thực hiện quá nhiều đổi mới về cấu trúc và thiết kế trên mạng ban đầu. Nó chỉ sử dụng nhiều tham số mạng hơn và bộ dữ liệu lớn hơn: tổng mô hình tối đa có 48 lớp. và 1,5 tỷ tham số. Mục tiêu học tập sử dụng mô hình đào tạo trước không giám sát để thực hiện các nhiệm vụ được giám sát. Về hiệu năng, ngoài khả năng hiểu biết, GPT-2 lần đầu tiên thể hiện tài năng mạnh mẽ: đọc tóm tắt, trò chuyện, viết tiếp, bịa chuyện và thậm chí tạo tin giả, email lừa đảo hay nhập vai. trực tuyến Không thành vấn đề. Sau khi "trở nên lớn hơn", GPT-2 đã chứng tỏ được khả năng phổ quát và mạnh mẽ của mình, đồng thời đạt được hiệu suất tốt nhất vào thời điểm đó trên nhiều tác vụ mô hình hóa ngôn ngữ cụ thể.

Sau đó, GPT-3 xuất hiện với tư cách là một mô hình không giám sát (ngày nay thường được gọi là mô hình tự giám sát), nó gần như có thể hoàn thành hầu hết các nhiệm vụ xử lý ngôn ngữ tự nhiên như tìm kiếm theo hướng vấn đề, đọc hiểu, suy luận ngữ nghĩa và dịch máy. , tạo bài viết và hỏi đáp tự động, v.v. Hơn nữa, mô hình thực hiện tốt nhiều nhiệm vụ, chẳng hạn như đạt đến trình độ tiên tiến hiện nay về các nhiệm vụ dịch máy Pháp-Anh và Đức-Anh. Các bài viết được tạo tự động gần như không thể phân biệt được giữa con người và máy móc (chỉ có điều). Độ chính xác 52%), có thể so sánh với đoán ngẫu nhiên), và điều đáng ngạc nhiên hơn nữa là nó đạt được độ chính xác gần như 100% đối với các tác vụ cộng và trừ hai chữ số và thậm chí có thể tự động tạo mã dựa trên mô tả tác vụ. Một mô hình không giám sát có nhiều chức năng và tác dụng tốt, và có vẻ như mọi người nhìn thấy niềm hy vọng vào trí tuệ nhân tạo nói chung. Đây có thể là lý do chính khiến GPT-3 có tác động lớn như vậy.

Chính xác thì mẫu GPT-3 là gì?

Trên thực tế, GPT-3 là một mô hình ngôn ngữ thống kê đơn giản. Từ góc độ học máy, các mô hình ngôn ngữ mô hình hóa phân bố xác suất của các chuỗi từ, nghĩa là sử dụng các đoạn đã được nói làm điều kiện để dự đoán phân bố xác suất của các từ khác nhau xuất hiện ở thời điểm tiếp theo. Một mặt, mô hình ngôn ngữ có thể đo lường mức độ phù hợp của câu với ngữ pháp ngôn ngữ (ví dụ: đo xem câu trả lời do hệ thống đối thoại giữa con người và máy tính tự động tạo ra có tự nhiên và trôi chảy hay không) và nó cũng có thể được sử dụng để dự đoán và tạo ra câu mới. Ví dụ: đối với clip “Đã 12 giờ trưa, chúng ta cùng nhau đi ăn nhà hàng”, mô hình ngôn ngữ có thể dự đoán các từ có thể xuất hiện sau “nhà hàng”. Một mô hình ngôn ngữ chung sẽ dự đoán từ tiếp theo là "ăn". Một mô hình ngôn ngữ mạnh mẽ có thể nắm bắt thông tin về thời gian và dự đoán từ "ăn trưa" phù hợp với ngữ cảnh.

Thông thường, một mô hình ngôn ngữ có mạnh mẽ hay không chủ yếu phụ thuộc vào hai điểm: thứ nhất, liệu mô hình có thể sử dụng tất cả thông tin bối cảnh lịch sử hay không. Trong ví dụ trên, nếu nó không thể nắm bắt được thông tin ngữ nghĩa tầm xa của "12 giờ trưa" hay không. mô hình ngôn ngữ sẽ gần như không thể dự đoán được thời gian tiếp theo. Thứ hai, nó còn phụ thuộc vào việc có bối cảnh lịch sử đủ phong phú để mô hình học hay không, tức là tập dữ liệu huấn luyện có đủ phong phú hay không. Vì mô hình ngôn ngữ là học tự giám sát nên mục tiêu tối ưu hóa là tối đa hóa xác suất mô hình ngôn ngữ của văn bản được nhìn thấy, do đó, bất kỳ văn bản nào cũng có thể được sử dụng làm dữ liệu huấn luyện mà không cần gắn nhãn.

Do hiệu suất mạnh hơn của GPT-3 và nhiều tham số hơn đáng kể nên nó chứa nhiều văn bản chủ đề hơn, rõ ràng là tốt hơn GPT-2 thế hệ trước. Là mạng thần kinh dày đặc lớn nhất hiện có, GPT-3 có thể chuyển đổi các mô tả trang web thành các mã tương ứng, bắt chước các câu chuyện của con người, tạo các bài thơ tùy chỉnh, tạo kịch bản trò chơi và thậm chí bắt chước các triết gia đã qua đời - dự đoán ý nghĩa thực sự của cuộc sống. Và GPT-3 không yêu cầu tinh chỉnh, nó chỉ yêu cầu một vài mẫu đầu ra (một lượng học tập nhỏ) để giải quyết các vấn đề ngữ pháp khó. Có thể nói, GPT-3 dường như đã thỏa mãn mọi trí tưởng tượng của chúng ta dành cho các chuyên gia ngôn ngữ.

Lưu ý: Trên đây chủ yếu đề cập đến các bài viết sau:

1. GPT 4 sắp ra mắt được sánh ngang với bộ não con người. Nhiều ông lớn trong ngành không thể ngồi yên! -Xu Jiechen, Yun Zhao -Tài khoản công cộng 51 CTO Technology Stack- 24-11-2022 18: 08

2. Giải đáp sự tò mò của bạn về GPT-3 trong một bài viết! GPT-3 là gì? Tại sao nó lại tuyệt vời như vậy? -Viện Tự động hóa Zhang Jiajun, Viện Hàn lâm Khoa học Trung Quốc Xuất bản tại Bắc Kinh vào ngày 11-11-2020 17:25

3.The Batch: 329 | InstructGPT, một tài khoản công khai mô hình ngôn ngữ thân thiện và nhẹ nhàng hơn DeeplearningAI-2022-02-07 12: 30

Các vấn đề với GPT-3 là gì?

Nhưng GTP-3 không hoàn hảo. Một trong những vấn đề chính mà mọi người lo lắng nhất về trí tuệ nhân tạo là chatbot và các công cụ tạo văn bản có khả năng học tất cả các văn bản trên Internet một cách bừa bãi và chất lượng. hoặc thậm chí sản sinh ra những ngôn từ phản cảm, điều này sẽ ảnh hưởng hoàn toàn đến ứng dụng tiếp theo của họ.

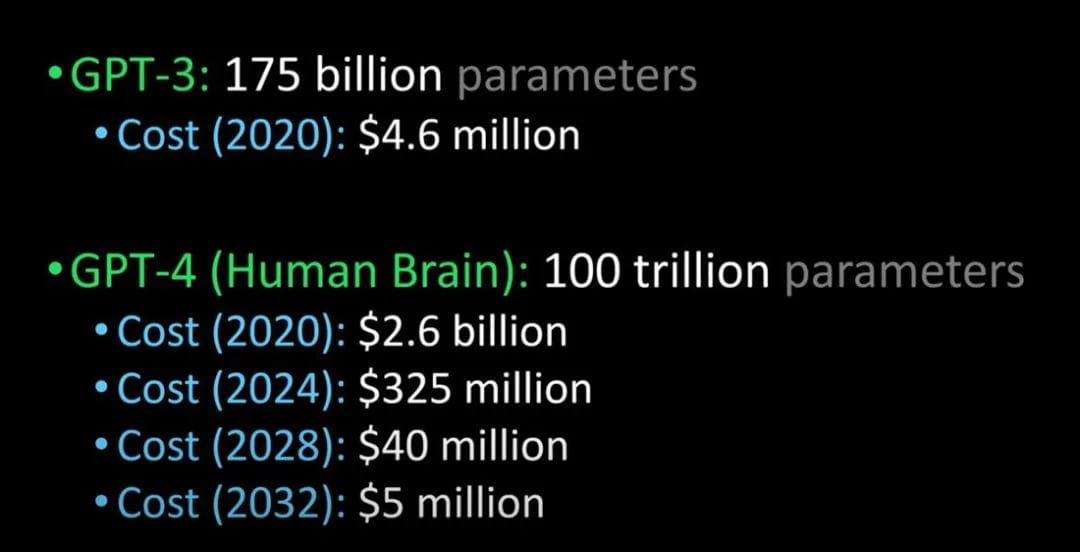

OpenAI cũng đã đề xuất rằng GPT-4 mạnh hơn sẽ được phát hành trong tương lai gần:

So sánh GPT-3 với GPT-4 và bộ não con người (Tín dụng hình ảnh: Lex Fridman @youtube)

Người ta nói rằng GPT-4 sẽ được phát hành vào năm tới. Nó có thể vượt qua bài kiểm tra Turing và tiên tiến đến mức không thể phân biệt được với con người. Ngoài ra, chi phí để các doanh nghiệp giới thiệu GPT-4 cũng sẽ giảm đi rất nhiều.

ChatGP và Hướng dẫnGPT

ChatGPT và InstructGPT

Khi nói đến Chatgpt thì phải nói đến “người tiền nhiệm” InstructGPT của nó.

Đầu năm 2022, OpenAI phát hành InstructGPT; trong nghiên cứu này, so với GPT-3, OpenAI đã sử dụng nghiên cứu căn chỉnh để đào tạo một mô hình ngôn ngữ thực tế hơn, vô hại hơn và tuân thủ tốt hơn ý định của người dùng. InstructGPT InstructGPT là một mô hình mới, được tinh chỉnh. phiên bản GPT-3 giúp giảm thiểu đầu ra có hại, không thực tế và sai lệch.

InstructGPT hoạt động như thế nào?

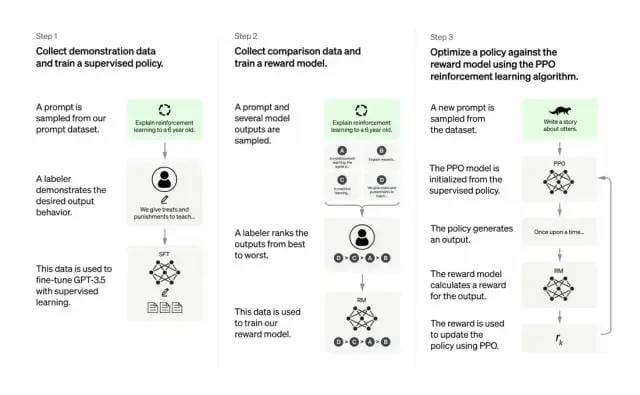

Các nhà phát triển thực hiện điều này bằng cách kết hợp học tập có giám sát + học tập tăng cường từ phản hồi của con người. Để cải thiện chất lượng đầu ra của GPT-3. Trong kiểu học này, con người xếp hạng các kết quả đầu ra tiềm năng của một mô hình; các thuật toán học tăng cường khen thưởng những mô hình tạo ra tài liệu tương tự với kết quả đầu ra cấp cao.

Tập dữ liệu huấn luyện bắt đầu bằng cách tạo lời nhắc, một số lời nhắc dựa trên thông tin đầu vào từ người dùng GPT-3, chẳng hạn như “Kể cho tôi câu chuyện về một con ếch” hoặc “Giải thích việc hạ cánh lên mặt trăng cho một đứa trẻ 6 tuổi bằng một vài câu. ”

Các nhà phát triển đã chia lời nhắc thành ba phần và tạo phản hồi cho từng phần một cách khác nhau:

Người viết phản ứng với những gợi ý đầu tiên. Các nhà phát triển đã tinh chỉnh GPT-3 đã được đào tạo và biến nó thành InstructGPT để tạo các phản hồi hiện có cho từng lời nhắc.

Bước tiếp theo là đào tạo một mô hình để khen thưởng những phản hồi tốt hơn với phần thưởng cao hơn. Đối với nhóm lời nhắc thứ hai, mô hình được tối ưu hóa sẽ tạo ra nhiều phản hồi. Người đánh giá con người xếp hạng từng phản hồi. Đưa ra lời nhắc và hai phản hồi, một mô hình phần thưởng (một GPT-3 được đào tạo trước khác) đã học cách tính phần thưởng cao hơn cho phản hồi được xếp hạng cao và phần thưởng thấp hơn cho phản hồi được xếp hạng thấp.

Các nhà phát triển đã tinh chỉnh thêm mô hình ngôn ngữ bằng cách sử dụng bộ gợi ý thứ ba và phương pháp học tăng cường Tối ưu hóa chính sách gần nhất (PPO). Khi một lời nhắc được đưa ra, mô hình ngôn ngữ sẽ tạo ra phản hồi và mô hình phần thưởng sẽ thưởng cho nó tương ứng. PPO sử dụng phần thưởng để cập nhật mô hình ngôn ngữ.

Tài liệu tham khảo cho đoạn này: The Batch: 329 | InstructGPT, một mô hình ngôn ngữ-tài khoản công khai thân thiện và nhẹ nhàng hơn DeeplearningAI- 2022-02-07 12: 30

Điều gì quan trọng? Cốt lõi là trí tuệ nhân tạo cần có trách nhiệm trí tuệ nhân tạo

Mô hình ngôn ngữ của OpenAI có thể trợ giúp trong các lĩnh vực giáo dục, nhà trị liệu ảo, hỗ trợ viết, trò chơi nhập vai, v.v. Trong các lĩnh vực này, sự tồn tại của thành kiến xã hội, thông tin sai lệch và thông tin độc hại sẽ rắc rối hơn và các hệ thống có thể tránh được những sai sót này có thể có khả năng hữu ích hơn.

Sự khác biệt giữa quy trình đào tạo của Chatgpt và InstructGPT là gì?

Nhìn chung, Chatgpt, giống như InstructGPT ở trên, được đào tạo bằng cách sử dụng RLHF (Học tăng cường từ phản hồi của con người). Sự khác biệt là cách dữ liệu được thiết lập để đào tạo (và được thu thập). (Giải thích ở đây: Mô hình InstructGPT trước đây cung cấp đầu ra cho một đầu vào, sau đó so sánh nó với dữ liệu đào tạo. Đúng, có phần thưởng chứ không phải hình phạt; Chatgpt hiện tại là đầu vào và mô hình cung cấp nhiều đầu ra, sau đó là con người đưa ra Việc sắp xếp kết quả đầu ra này cho phép mô hình xếp hạng các kết quả này từ "giống con người hơn" đến "vô nghĩa", cho phép mô hình học theo cách con người sắp xếp. Chiến lược này được gọi là học có giám sát. Cảm ơn Tiến sĩ Zhang Zijie vì. Đoạn văn này)

Những hạn chế của ChatGPT là gì?

như sau:

a) Trong giai đoạn đào tạo học tăng cường (RL), không có nguồn sự thật cụ thể và câu trả lời tiêu chuẩn nào cho câu hỏi của bạn.

b) Mô hình được huấn luyện để thận trọng hơn và có thể từ chối các câu trả lời (để tránh đưa ra kết quả dương tính giả khi được nhắc).

c) Quá trình đào tạo được giám sát có thể đánh lừa/làm sai lệch mô hình trong việc biết câu trả lời lý tưởng, thay vì mô hình tạo ra một tập hợp các câu trả lời ngẫu nhiên và chỉ những người đánh giá mới chọn những câu trả lời tốt/được xếp hạng cao nhất

Lưu ý: ChatGPT rất nhạy cảm với cách diễn đạt. , đôi khi mô hình không phản hồi một cụm từ, nhưng với một chút điều chỉnh đối với câu hỏi/cụm từ, mô hình sẽ trả lời chính xác. Giảng viên có xu hướng thích các câu trả lời dài hơn vì chúng có vẻ toàn diện hơn, dẫn đến xu hướng trả lời dài hơn và lạm dụng quá nhiều cụm từ nhất định trong mô hình. Nếu gợi ý hoặc câu hỏi ban đầu không rõ ràng, mô hình sẽ không yêu cầu làm rõ một cách thích hợp.

Các giới hạn tự xác định của ChatGPT như sau.

Những câu trả lời nghe có vẻ hợp lý nhưng lại sai:

a) Không có nguồn thông tin thực sự nào để khắc phục vấn đề này trong giai đoạn đào tạo Học tăng cường (RL).

b) Mô hình đào tạo để thận trọng hơn có thể từ chối trả lời do nhầm lẫn (dương tính giả với những lời nhắc rắc rối).

c) Quá trình đào tạo được giám sát có thể đánh lừa/làm sai lệch mô hình có xu hướng biết câu trả lời lý tưởng thay vì mô hình tạo ra một tập hợp câu trả lời ngẫu nhiên và chỉ những người đánh giá chọn câu trả lời tốt/được xếp hạng caoChatGPT mới nhạy cảm với cách diễn đạt. Đôi khi, mô hình không có phản hồi cho một cụm từ, nhưng với một chút điều chỉnh đối với câu hỏi/cụm từ, mô hình sẽ trả lời chính xác.

Giảng viên thích những câu trả lời dài hơn có thể trông toàn diện hơn, dẫn đến xu hướng trả lời dài dòng và lạm dụng một số cụm từ nhất định. Mô hình sẽ không yêu cầu làm rõ một cách thích hợp nếu lời nhắc hoặc câu hỏi ban đầu không rõ ràng. Lớp an toàn để từ chối các yêu cầu không phù hợp thông qua Moderation API đã được thực hiện. Tuy nhiên, chúng ta vẫn có thể mong đợi những phản hồi tích cực và tiêu cực giả.

người giới thiệu:

1.https://medium.com/inkwater-atlas/chatgpt-the-new-frontier-of-artificial-intelligence-9 aee 81287677

2.https://pub.towardsai.net/openai-debuts-chatgpt-50 dd 611278 a 4

3.https://openai.com/blog/chatgpt/

4. GPT 4 sắp ra mắt được sánh ngang với bộ não con người. Nhiều ông lớn trong ngành không thể ngồi yên! -Xu Jiechen, Yun Zhao -Tài khoản công khai 51 CTO Technology Stack- 24-11-2022 18: 08

5. Giải đáp sự tò mò của bạn về GPT-3 trong một bài viết! GPT-3 là gì? Tại sao nó lại tuyệt vời như vậy? -Viện Tự động hóa Zhang Jiajun, Viện Hàn lâm Khoa học Trung Quốc Xuất bản tại Bắc Kinh vào ngày 11-11-2020 17:25

6.The Batch: 329 | InstructGPT, một tài khoản công khai mô hình ngôn ngữ thân thiện và nhẹ nhàng hơn DeeplearningAI-2022-02-07 12: 30