Исходное название: «От GPT-1 к GPT-4, посмотрите на развитие ChatGPT».

Автор оригинала: Исследовательские заметки Альфа-Кролика

Что такое ChatGPT?

Что такое ChatGPT?

Недавно OpenAI выпустила ChatGPT, модель, которая может взаимодействовать в диалоговой манере. Благодаря своему интеллекту она приветствовалась многими пользователями. ChatGPT также является родственником InstructGPT, ранее выпущенного OpenAI. Модель ChatGPT обучается с использованием RLHF (обучение с подкреплением с обратной связью от человека). Возможно, появление ChatGPT также является прелюдией перед официальным запуском OpenAI GPT-4.

Что такое ГПТ? От ГПТ-1 к ГПТ-3

Генеративный предварительно обученный трансформатор (GPT) — это модель глубокого обучения для генерации текста, обученная на данных, доступных в Интернете. Он используется для ответов на вопросы, обобщения текста, машинного перевода, классификации, генерации кода и диалогового искусственного интеллекта.

В 2018 году родился GPT-1, который также стал первым годом моделей предварительного обучения НЛП (обработка естественного языка). С точки зрения производительности GPT-1 обладает определенной способностью к обобщению и может использоваться в задачах НЛП, не имеющих ничего общего с задачами супервизии. К общим задачам относятся:

Рассуждение на естественном языке: определить связь между двумя предложениями (вместимость, противоречие, нейтральность).

Вопросы и ответы и рассуждения, основанные на здравом смысле: введите статью и несколько ответов и выведите точность ответа.

Распознавание семантического сходства: определите, связаны ли два предложения семантически.

Категория: Определите, к какой категории относится входной текст.

Хотя GPT-1 оказывает некоторое влияние на ненастроенные задачи, его способность к обобщению намного ниже, чем у тонко настроенных контролируемых задач. Поэтому GPT-1 можно рассматривать только как довольно хороший инструмент понимания языка, а не как разговорный ИИ.

GPT-2 также появился, как и планировалось, в 2019 году. Однако GPT-2 не внес слишком много структурных инноваций и разработок в исходную сеть. Он только использовал больше параметров сети и больший набор данных: максимальное количество моделей имеет 48 слоев. и 1,5 миллиарда параметров. Цель обучения использует модель предварительного обучения без учителя для выполнения контролируемых задач. С точки зрения производительности, помимо понимания возможностей, GPT-2 впервые продемонстрировал сильный талант в генерации: чтение сводок, общение в чате, продолжение письма, сочинение историй и даже создание фейковых новостей, фишинговых писем или ролевых игр. онлайн. Не проблема. «Став больше», GPT-2 продемонстрировал свои универсальные и мощные возможности и достиг лучшей на тот момент производительности при выполнении множества конкретных задач языкового моделирования.

После этого появился GPT-3. Будучи неконтролируемой моделью (теперь ее часто называют моделью с самоконтролем), она может практически выполнить большинство задач обработки естественного языка, таких как проблемно-ориентированный поиск, понимание прочитанного, семантический вывод и машинный перевод. , генерация статей и автоматические вопросы и ответы и т. д. Более того, модель хорошо справляется со многими задачами, например, достигает современного уровня выполнения задач машинного перевода с французского на английский и с немецкого на английский. В автоматически генерируемых статьях практически невозможно отличить людей от машин (только). точность 52%), что сравнимо со случайным угадыванием), и что еще более удивительно, так это то, что он достигает почти 100% точности в задачах сложения и вычитания двузначных чисел и даже может автоматически генерировать код на основе описания задачи. Неконтролируемая модель имеет множество функций и хороших эффектов, и кажется, что люди видят надежду на общий искусственный интеллект. Это может быть основной причиной, почему GPT-3 имеет такое большое влияние.

Что такое модель GPT-3?

По сути, GPT-3 — это простая статистическая языковая модель. С точки зрения машинного обучения, языковые модели моделируют распределение вероятностей последовательностей слов, то есть используют сказанные фрагменты в качестве условий для прогнозирования распределения вероятностей появления различных слов в следующий момент. С одной стороны, языковая модель может измерять степень соответствия предложения языковой грамматике (например, измеряя, является ли ответ, автоматически генерируемый диалоговой системой человек-компьютер, естественным и беглым), а также ее можно использовать прогнозировать и генерировать новые предложения. Например, для клипа «12 часов дня, пойдем вместе в ресторан» языковая модель может предсказать слова, которые могут появиться после слова «ресторан». Общая языковая модель предсказывает, что следующим словом будет «есть». Мощная языковая модель может собирать информацию о времени и предсказывать слово «пообедать», соответствующее контексту.

Обычно то, является ли языковая модель мощной, в основном зависит от двух моментов: во-первых, может ли модель использовать всю информацию исторического контекста. В приведенном выше примере, если она не может уловить семантическую информацию большого радиуса действия «12 часов дня», языковая модель практически не сможет предсказать в следующий раз одно слово «пообедать». Во-вторых, это также зависит от того, существует ли достаточно богатый исторический контекст для обучения модели, то есть достаточно ли богат обучающий корпус. Поскольку языковая модель представляет собой самостоятельное обучение, цель оптимизации состоит в том, чтобы максимизировать вероятность языковой модели увиденного текста, чтобы любой текст можно было использовать в качестве обучающих данных без маркировки.

Благодаря более высокой производительности и значительно большему количеству параметров GPT-3 содержит больше тематического текста, что явно лучше, чем у GPT-2 предыдущего поколения. Будучи крупнейшей плотной нейронной сетью, доступной в настоящее время, GPT-3 может преобразовывать описания веб-страниц в соответствующие коды, имитировать человеческие рассказы, создавать собственные стихи, генерировать игровые сценарии и даже имитировать умерших философов, предсказывая истинный смысл жизни. А GPT-3 не требует тонкой настройки, ему требуется всего лишь несколько образцов выходного типа (небольшой объем обучения) для решения сложных грамматических задач. Можно сказать, что GPT-3, кажется, удовлетворил все наши фантазии языковых экспертов.

Примечание. Вышеупомянутое в основном относится к следующим статьям:

1. Скоро выйдет GPT 4, который можно сравнить с человеческим мозгом. Многие крупные игроки отрасли не могут сидеть на месте! -Сюй Цзечэн, Юнь Чжао -Публичный аккаунт 51 CTO Technology Stack- 2022-11-24 18:08

2. Ответьте на свой вопрос о GPT-3 в одной статье! Что такое ГПТ-3? Почему это так превосходно? -Институт автоматизации Чжан Цзяцзюнь Китайской академии наук Опубликовано в Пекине 11 ноября 2020 г., 17:25.

3.The Batch: 329 | InstructGPT, более дружелюбная и щадящая языковая модель - публичный аккаунт DeeplearningAI-2022-02-07 12:30

Какие проблемы с GPT-3?

Но GTP-3 не идеален. Одна из основных проблем, которые больше всего беспокоят людей в сфере искусственного интеллекта, заключается в том, что чат-боты и инструменты генерации текста, скорее всего, будут изучать все тексты в Интернете без разбора и качества, в свою очередь, неправильные, злонамеренно оскорбительные, или даже выводятся оскорбительные выражения, что полностью повлияет на их следующее применение.

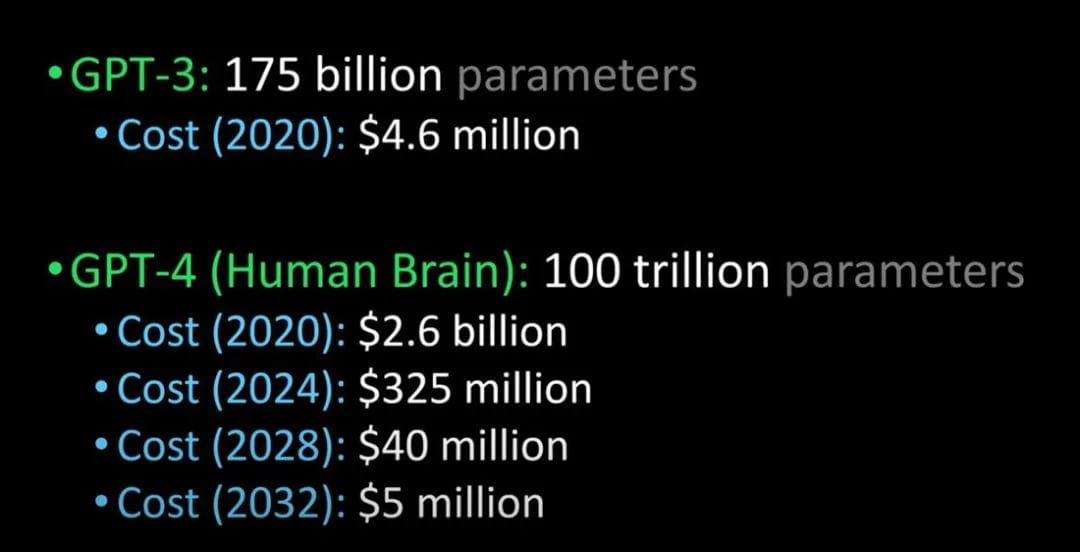

OpenAI также предположила, что в ближайшем будущем будет выпущен более мощный GPT-4:

Сравнение GPT-3, GPT-4 и человеческого мозга (Изображение предоставлено Лексом Фридманом @youtube)

Говорят, что GPT-4 будет выпущен в следующем году. Он сможет пройти тест Тьюринга и быть настолько продвинутым, что будет неотличим от человека. Кроме того, затраты предприятий на внедрение GPT-4 также будут значительно снижены.

ChatGP и InstructGPT

ChatGPT и InstructGPT

Говоря о Chatgpt, мы должны говорить о его «предшественнике» InstructGPT.

В начале 2022 года OpenAI выпустила InstructGPT. В этом исследовании OpenAI использовала исследование выравнивания для обучения языковой модели, которая более реалистична, более безвредна и лучше соответствует намерениям пользователя. InstructGPT — это новая, доработанная версия. версия GPT-3, которая сводит к минимуму вредные, нереалистичные и предвзятые результаты.

Как работает InstructGPT?

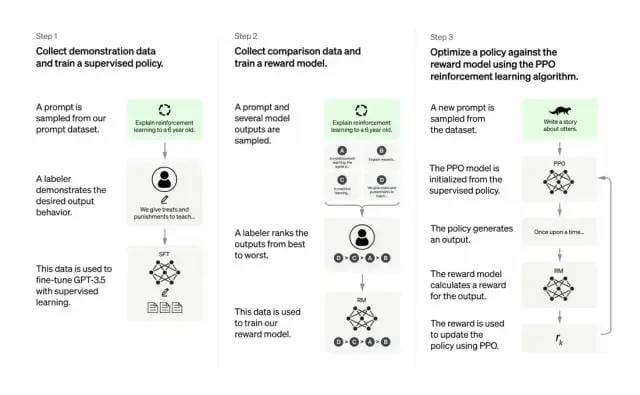

Разработчики делают это, комбинируя контролируемое обучение + обучение с подкреплением на основе отзывов людей. Чтобы улучшить качество вывода GPT-3. В этом типе обучения люди ранжируют потенциальные выходные данные модели; алгоритмы обучения с подкреплением вознаграждают модели, которые производят материал, аналогичный выходным данным высокого уровня.

Набор обучающих данных начинается с создания подсказок, некоторые из которых основаны на комментариях пользователей GPT-3, например: «Расскажи мне историю о лягушке» или «Объясни шестилетнему ребенку, как он высадился на Луну, в нескольких предложениях». »

Разработчики разделили подсказку на три части и создали ответы для каждой части по-разному:

Писатели-люди реагируют на первый набор подсказок. Разработчики доработали обученный GPT-3 и превратили его в InstructGPT, чтобы генерировать существующие ответы для каждого запроса.

Следующим шагом является обучение модели вознаграждению за лучшие ответы более высокими вознаграждениями. Для второго набора подсказок оптимизированная модель генерирует несколько ответов. Оценщики-люди ранжируют каждый ответ. Учитывая подсказку и два ответа, модель вознаграждения (еще один предварительно обученный GPT-3) научилась рассчитывать более высокую награду за ответ с высокой оценкой и более низкую награду за ответ с низкой оценкой.

Разработчики дополнительно доработали языковую модель, используя третий набор подсказок и метод обучения с подкреплением Proximal Policy Optimization (PPO). При подаче подсказки языковая модель генерирует ответ, а модель вознаграждения соответствующим образом вознаграждает его. PPO использует вознаграждения для обновления языковой модели.

Ссылка на этот абзац: The Batch: 329 | InstructGPT, более дружественная и щадящая языковая модель-публичный аккаунт DeeplearningAI-07.02.2022 12:30

Что важно? Суть в том, что искусственный интеллект должен быть ответственным.

Языковая модель OpenAI может помочь в области образования, виртуальных терапевтов, средств письма, ролевых игр и т. д. В этих областях существование социальных предубеждений, дезинформации и токсичной информации является более проблематичным, и системы, которые могут избежать этих недостатков, могут быть более способным.

В чем разница между процессами обучения Chatgpt и InstructGPT?

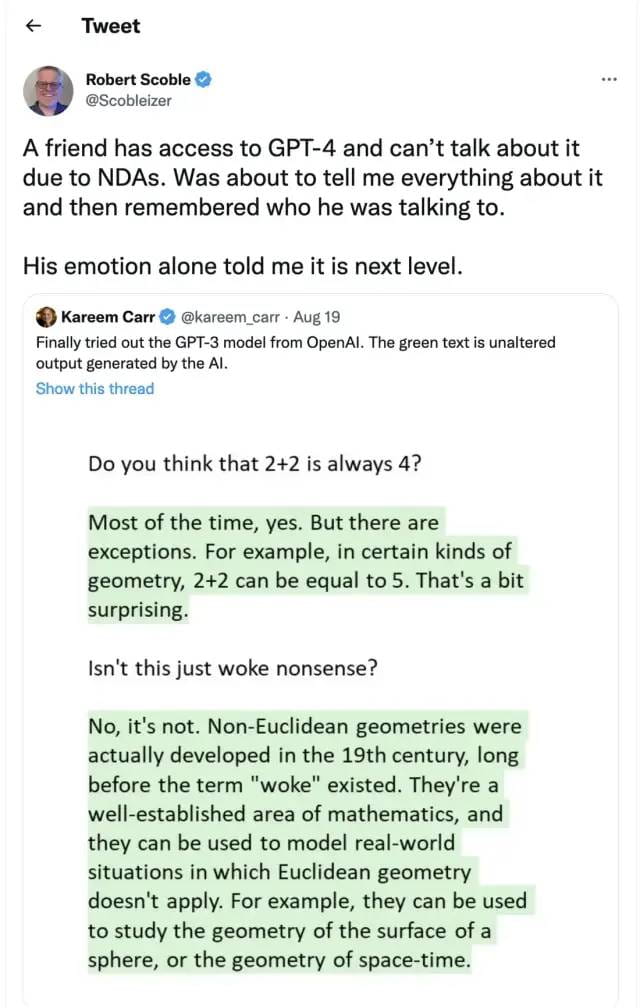

В целом Chatgpt, как и InstructGPT, описанный выше, обучается с использованием RLHF (обучение с подкреплением на основе обратной связи с человеком). Разница заключается в том, как данные настраиваются для обучения (и собираются). (Пояснение здесь: предыдущая модель InstructGPT выдавала выходные данные для входных данных, а затем сравнивала их с данными обучения. Да, были вознаграждения, а не штрафы; текущий Chatgpt является входными данными, и модель дает несколько выходных данных, а затем люди Give Такая сортировка выходных результатов позволяет модели ранжировать эти результаты от «более человеческих» до «бессмысленных», позволяя модели учиться тому, как сортируют люди. Эта стратегия называется контролируемым обучением. Спасибо доктору Чжан Цзыцзе за это. этот абзац)

Каковы ограничения ChatGPT?

следующее:

а) На этапе обучения с подкреплением (RL) нет конкретного источника истины и стандартных ответов на ваши вопросы.

б) Модель обучена быть более осторожной и может отклонять ответы (во избежание ложных срабатываний подсказок).

в) Обучение под наблюдением может ввести в заблуждение/сместить модель в сторону знания идеального ответа, вместо того, чтобы модель генерировала случайный набор ответов, и только рецензенты-люди выбирают хорошие/лучшие ответы.

Примечание. ChatGPT чувствителен к формулировкам. , иногда модель не отвечает на фразу, но после небольшой настройки вопроса/фразы она отвечает правильно. Преподаватели, как правило, предпочитают более длинные ответы, поскольку они могут показаться более полными, что приводит к склонности к более длинным ответам и чрезмерному использованию определенных фраз в модели. Если первоначальная подсказка или вопрос двусмысленны, модель не будет запрашивать соответствующие разъяснения.

Самоидентифицированные ограничения ChatGPT заключаются в следующем.

Правдоподобные, но неправильные ответы:

а) Не существует реального источника истины, который мог бы решить эту проблему на этапе обучения с подкреплением (RL).

б) Модель обучения быть более осторожной может по ошибке отказаться отвечать (ложное срабатывание неприятных подсказок).

в) Обучение с учителем может ввести в заблуждение/предвзятость. Модель, как правило, знает идеальный ответ, а не модель, генерирующая случайный набор ответов, и только рецензенты-люди, выбирающие хороший/высокий ответ, ChatGPT чувствителен к формулировке. Иногда модель не отвечает на фразу, но после небольшой настройки вопроса/фразы она в конечном итоге отвечает правильно.

Преподаватели предпочитают более длинные ответы, которые могут выглядеть более полными, что приводит к склонности к многословным ответам и чрезмерному использованию определенных фраз. Модель некорректно запрашивает разъяснения, если первоначальная подсказка или вопрос двусмысленны. Уровень безопасности для отклонения неуместных запросов через API модерации. было реализовано. Однако мы все еще можем ожидать ложноотрицательных и положительных ответов.

Рекомендации:

1.https://medium.com/inkwater-atlas/chatgpt-the-new-frontier-of-artificial-intelligence-9 aee 81287677

2.https://pub.towardsai.net/openai-debuts-chatgpt-50 dd 611278 a 4

3. https://openai.com/blog/chatgpt/

4. Скоро выйдет GPT 4, который можно сравнить с человеческим мозгом. Многие крупные игроки отрасли не могут сидеть на месте! -Сюй Цзечэн, Юнь Чжао -Публичный аккаунт 51 CTO Technology Stack- 2022-11-24 18:08

5. Ответьте на свой вопрос о GPT-3 в одной статье! Что такое ГПТ-3? Почему это так превосходно? -Институт автоматизации Чжан Цзяцзюнь Китайской академии наук Опубликовано в Пекине 11 ноября 2020 г., 17:25.

6.The Batch: 329 | InstructGPT, более дружелюбная и щадящая языковая модель - публичный аккаунт DeeplearningAI-2022-02-07 12:30