Versiunea open-source a modelului DeepMind Flamingo, OpenFlamingo, tocmai a fost lansată. OpenFlamingo este în mod fundamental un cadru care permite formarea și evaluarea modelelor multimodale (LMM) considerabile. OpenFlamingo este construit pe baza modelului de limbaj mare LLaMA dezvoltat de Meta AI.

Citiți mai multe: Cum să utilizați Midjourney gratuit pentru totdeauna: 5 pași simpli

Citiți mai multe: Cum să utilizați Midjourney gratuit pentru totdeauna: 5 pași simpli

Contribuțiile dezvoltatorilor la această primă versiune sunt următoarele:

Un set de date multimodal considerabil care combină text și secvențe vizuale.

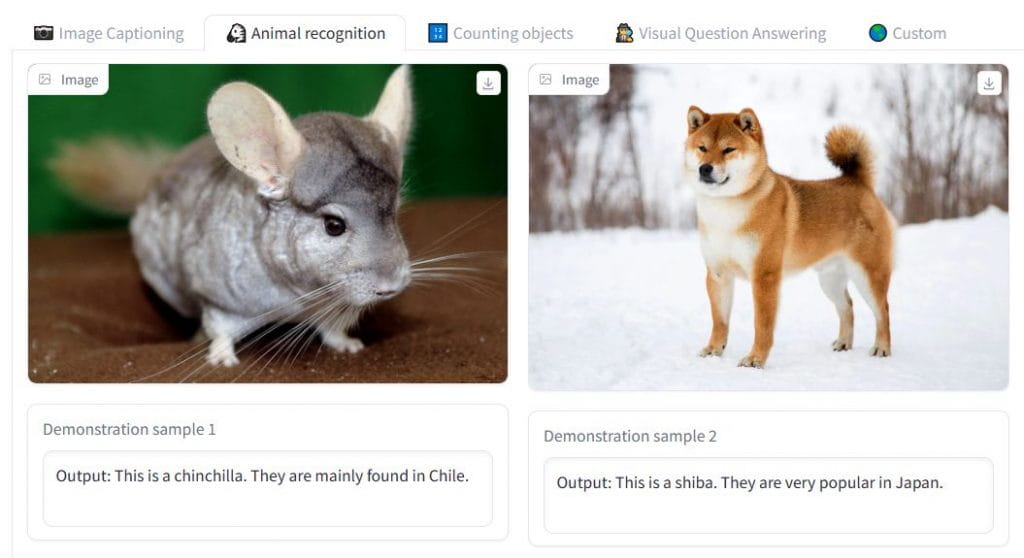

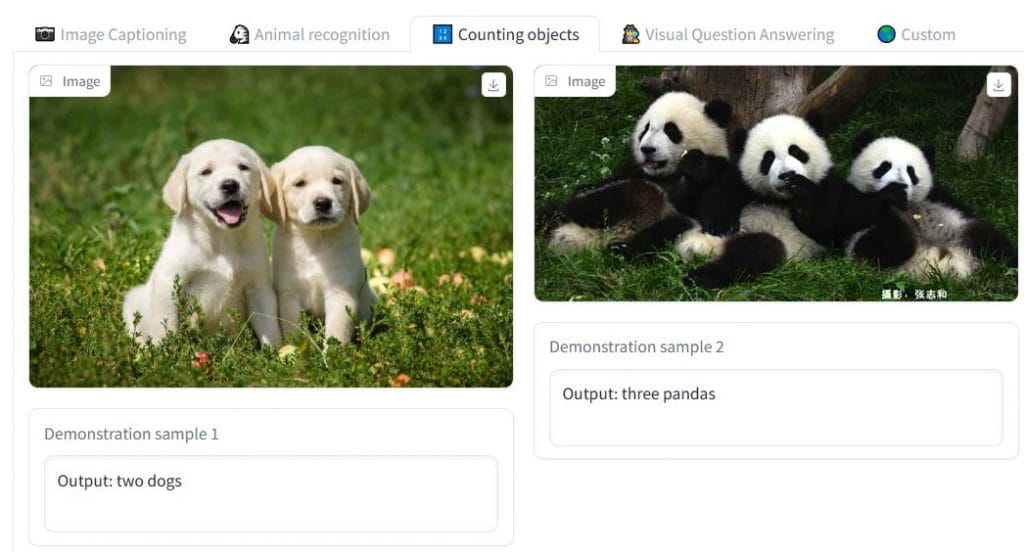

Un punct de referință pentru evaluarea învățării în context pentru activități, inclusiv viziune și limbaj.

O versiune preliminară a modelului nostru OpenFlamingo-9B bazat pe LLaMA.

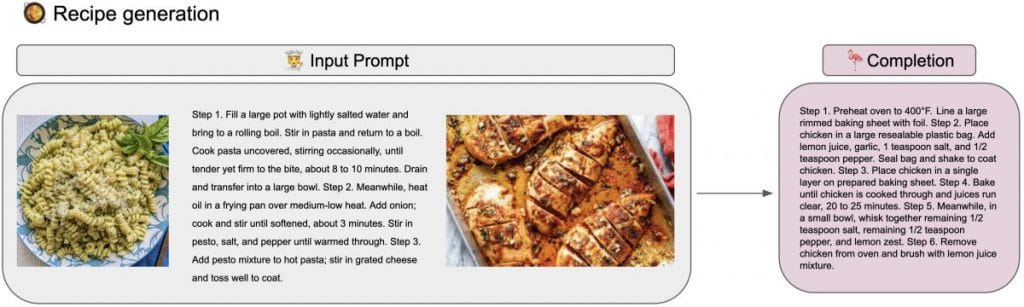

Prin OpenFlamingo, dezvoltatorii speră să creeze un sistem multimodal care să poată face față unei varietăți de provocări ale limbajului vizual. Scopul final este de a egala puterea și adaptabilitatea lui GPT-4 în gestionarea introducerii vizuale și a textului. Dezvoltatorii dezvoltă o versiune open-source a modelului Flamingo de la DeepMind, un LMM capabil să proceseze și să raționeze despre imagini, videoclipuri și text, pentru a atinge acest obiectiv. Dezvoltatorii sunt dedicați dezvoltării de modele complet open-source, deoarece cred că transparența este esențială pentru promovarea cooperării, accelerarea dezvoltării și democratizarea accesului la LMM-uri de ultimă oră.

Ei oferă punctul de control inițial al modelului nostru OpenFlamingo-9B. Deși modelul nu este încă complet optimizat, arată promisiunea proiectului. Dezvoltatorii pot antrena LMM-uri mai bune cooperând și obținând feedback-ul comunității. Ei invită publicul să contribuie și să adauge la depozit pentru a lua parte la procesul de dezvoltare.

Implementarea seamănă foarte mult cu cea a lui Flamingo. Modelele Flamingo trebuie să fie antrenate pe seturi de date web la scară largă, cu text și grafică intercalate, pentru a le dota cu abilități de învățare în context cu câteva fotografii. Aceeași arhitectură care a fost sugerată în studiul original Flamingo (Resamplere Perceiver, straturi de atenție încrucișată) este implementată în OpenFlamingo. Dar, deoarece datele de antrenament ale lui Flamingo nu sunt accesibile publicului larg, dezvoltatorii folosesc seturi de date open-source pentru a antrena modele. Punctul de control OpenFlamingo-9B recent publicat a fost instruit în mod special pe 10M mostre din LAION-2B și 5M mostre din noul set de date Multimodal C4.

Dezvoltatorii includ, de asemenea, un punct de control de la LMM OpenFlamingo-9B neterminat, care se bazează pe LLaMA 7B și CLIP ViT/L-14, ca parte a lansării. Chiar dacă acest concept este încă în curs de dezvoltare, comunitatea poate beneficia deja foarte mult de pe urma acestuia.

Pentru a începe, priviți sursa GitHub și demonstrația.

Citiți mai multe despre AI:

Se preconizează că costurile de formare pentru modelele AI vor crește de la 100 de milioane de dolari la 500 de milioane de dolari până în 2030

Noul agent AI adaptiv de la DeepMind, Ada, este aproape la fel de inteligent ca un om

DeepMind a lansat instrumentul AI Dramatron, care generează o schiță completă a unui scenariu de film sau emisiune TV

Postarea OpenFlamingo: un nou cadru imagine-în-text cu sursă deschisă de la Meta AI și LAION a apărut prima dată pe Metaverse Post.