După ce am petrecut timp citind cum este structurat Mira Network, am început să-l văd mai puțin ca un alt proiect blockchain și mai mult ca o încercare de a aborda ceva mai profund: gap-ul de fiabilitate în sistemele AI.

Cele mai multe modele AI de astăzi, indiferent cât de avansate, încă produc halucinații. Ele generează răspunsuri care sună corect, dar nu sunt. În sistemele centralizate, responsabilitatea pentru corectarea acestora revine companiei care rulează modelul. Audituri interne, ajustări fine și straturi de siguranță se desfășoară toate în spatele ușilor închise. Utilizatorii trebuie să aibă încredere în furnizor.

Mira Network urmează o rută diferită.

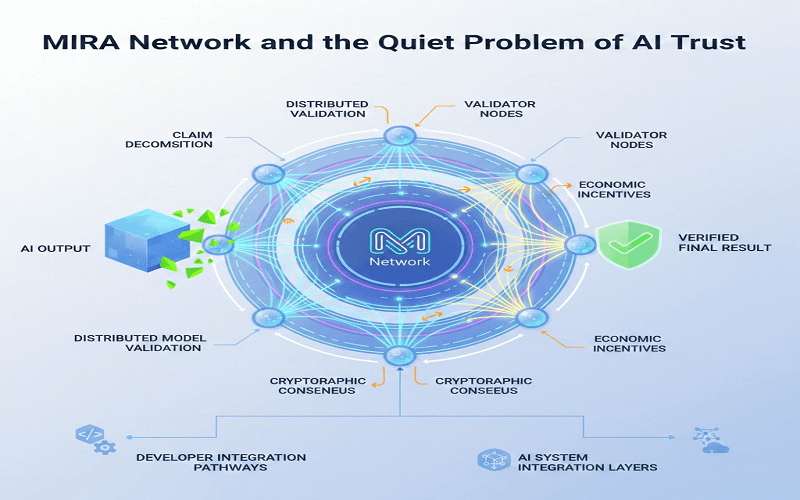

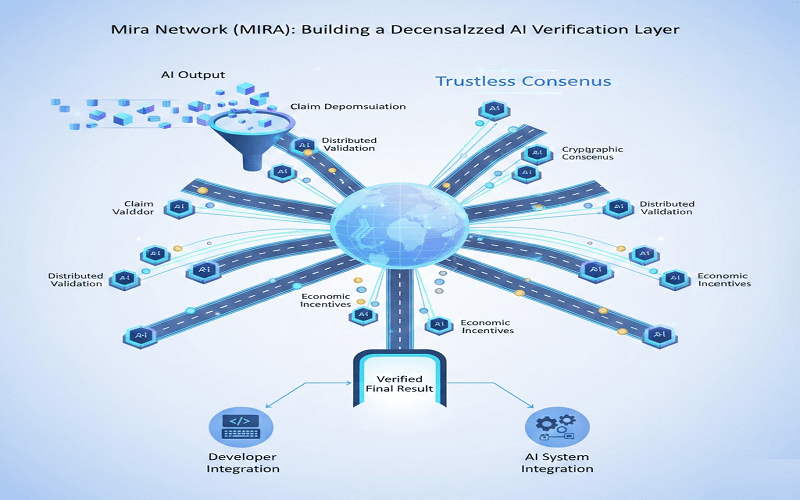

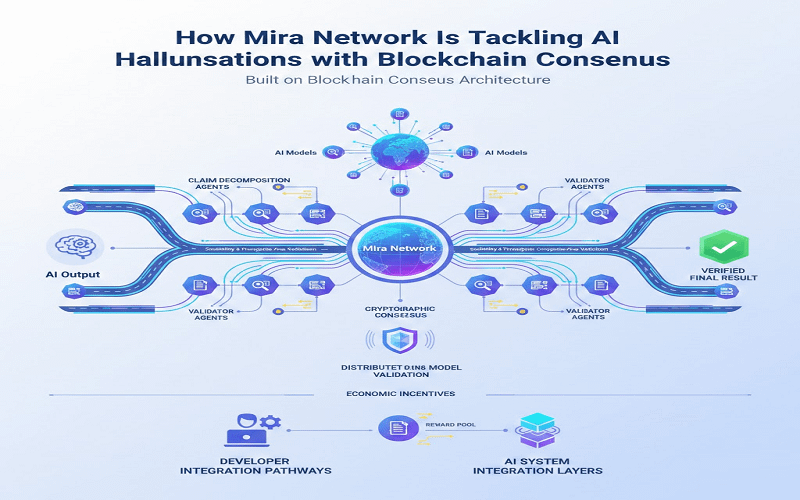

În loc să presupună că un model poate fi făcut perfect de încredere, tratează rezultatele AI ca afirmații care necesită verificare. Când un AI generează un răspuns, protocolul Mira descompune acel rezultat în afirmații factuale mai mici. Aceste afirmații sunt apoi distribuite între modelele independente din rețea pentru validare încrucișată. Dacă suficient dintre ele sunt de acord, afirmația câștigă încredere. Dacă ele diverge, este semnalizată.

Îmi amintește de modul în care funcționează verificarea faptelor în jurnalism. Un singur reporter ar putea scrie o poveste, dar editorii și sursele independente o revizuiesc înainte de publicare. Mira încearcă să formalizeze acel proces într-un strat de protocol.

Diferența importantă este că această validare nu se bazează pe o autoritate centrală. Folosește consens bazat pe blockchain și dovezi criptografice pentru a înregistra procesul de validare. Rezultatul nu este „aveți încredere în noi.” Este o dovadă verificabilă că multiple sisteme independente au ajuns la concluzii similare.

Acolo devine practic elementul blockchain, mai degrabă decât simbolic.

În loc să stocheze rezultatele mari ale AI direct pe lanț, Mira înregistrează rezultatele de verificare și dovezile. Validatorii sunt stimulați economic prin tokenul $MIRA . Dacă oferă validări precise, sunt recompensați. Dacă se comportă necinstit, sistemul îi poate penaliza. Scopul nu este perfecțiunea; este alinierea stimulentelor către verificarea onestă.

Când m-am uitat la actualizările și documentația @Mira - Trust Layer of AI , ceea ce a ieșit în evidență nu erau promisiunile grandioase. A fost accentul pe validarea structurată. Protocolul nu încearcă să înlocuiască modelele mari de AI. Se află sub ele, ca un strat de verificare.

În implementarea tradițională a AI, o companie lansează un model și poate adaugă un instrument de monitorizare. În #MiraNetwork , validarea devine o infrastructură descentralizată. Orice aplicație care se bazează pe AI—analize financiare, instrumente de cercetare, generare de conținut teoretic ar putea să se conecteze la acest nivel pentru a verifica rezultatele înainte de a acționa asupra lor.

Această separare este subtilă, dar importantă.

În loc să întrebe, “Este acest AI deștept?” Mira întreabă, “Putem verifica ce a spus tocmai?”

Desigur, sistemul nu este lipsit de provocări. Descompunerea rezultatelor AI în afirmații structurate adaugă o suprasarcină computațională. Rularea mai multor modele pentru validare încrucișată crește costul. Coordonarea între validatori introduce complexitate. Iar spațiul mai larg al AI descentralizat devine competitiv, cu alte protocoale explorând modele similare de verificare sau partajare a procesării.

Există, de asemenea, realitatea că ecosistemul este încă la început. Instrumentele, adoptarea de către dezvoltatori și standardizarea vor lua timp. Un strat de verificare devine semnificativ doar atunci când aplicațiile îl integrează constant.

Cu toate acestea, găsesc cadrul convingător.

Mai degrabă decât să urmărească modele mai mari, #Mira se concentrează pe responsabilitate între modele. Acceptă că halucinațiile nu vor dispărea peste noapte. În schimb, construiește un sistem distribuit care reduce încrederea oarbă și o înlocuiește cu consens înregistrat.

Această schimbare de la asigurarea centralizată la validarea fără încredere se simte ca experimentul real aici.

Și indiferent dacă se scalează sau nu, reflectă o recunoaștere crescândă că inteligența de una singură nu este suficientă; verificarea contează la fel de mult. #GrowWithSAC