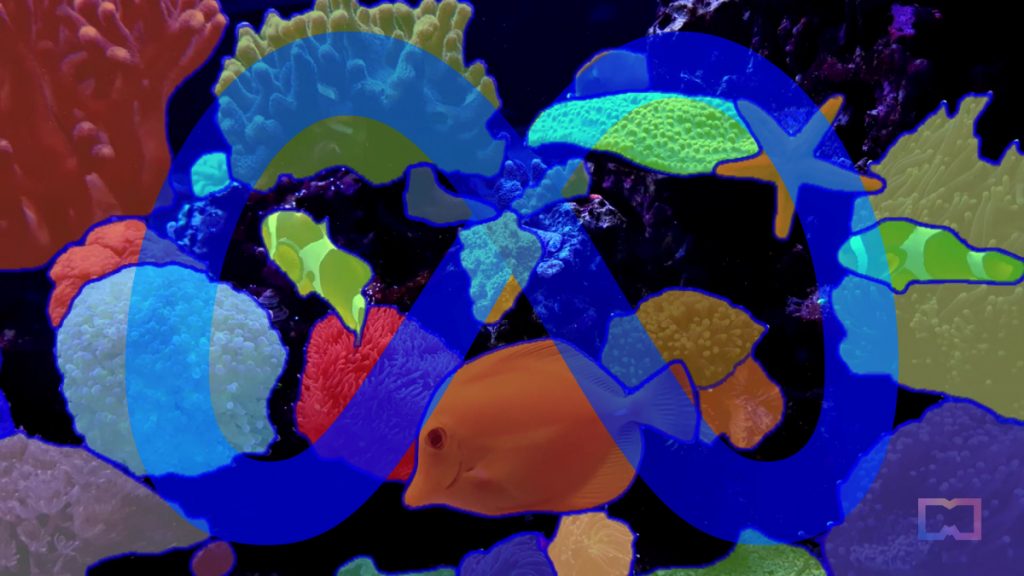

Meta lançou Segment Anything, seu novo modelo básico para segmentação de imagens. O processo de identificação de quais pixels de imagem pertencem a um objeto é uma tarefa crucial na visão computacional e é usado em diversas aplicações, desde a análise de imagens científicas até a edição de fotos.

Em sua postagem introdutória no blog, a empresa definiu o cenário dizendo que a criação de modelos de segmentação precisos para tarefas específicas em visão computacional normalmente exige trabalho especializado de especialistas técnicos com acesso à infraestrutura de treinamento de IA e grandes volumes de dados no domínio cuidadosamente anotados.

No entanto, isso pode mudar em breve com o projeto Segment Anything, pois seu novo conjunto de dados e modelo devem tornar modelos de segmentação precisos mais acessíveis a um público mais amplo, eliminando a necessidade de conhecimento técnico especializado e infraestrutura. Para conseguir isso, os pesquisadores construíram um modelo promptable que é treinado em dados diversos e pode se adaptar a tarefas específicas, semelhante a como o prompting é usado em modelos de processamento de linguagem natural ou chatbots.

Para democratizar ainda mais a segmentação, a Meta está disponibilizando o enorme conjunto de dados SA-1B para fins de pesquisa, e o Segment Anything Model está disponível sob uma licença aberta permissiva (Apache 2.0). Além disso, a empresa desenvolveu uma demonstração que permite que os usuários experimentem o SAM com suas próprias imagens.

A Meta vê casos de uso potenciais para o SAM nos domínios de IA, RA/RV e criador. O SAM tem o potencial de se tornar um elemento crítico em sistemas de IA maiores que visam atingir uma compreensão multimodal mais geral do mundo. Por exemplo, ele pode facilitar a compreensão de conteúdo visual e textual em uma página da web.

Além disso, no domínio AR/VR, o SAM pode habilitar a seleção de objetos com base no olhar do usuário e permitir que o objeto seja “elevado” para 3D. Além disso, os criadores de conteúdo podem usar o SAM para aprimorar aplicativos criativos, como extrair regiões de imagem para colagens ou edição de vídeo.

A Meta vem intensificando seus esforços de IA em meio ao boom da IA generativa e ao interesse decrescente no metaverso. Apesar da aposta de US$ 70 bilhões da empresa no metaverso, sua divisão de metaverso Reality Labs viu uma perda de US$ 13,7 bilhões no ano passado. Recentemente, a Meta também encerrou suas operações de NFT no Facebook e Instagram.

Em uma entrevista com a Nikkei Asia na quarta-feira, o CTO da Meta, Chris Bosworth, disse que os principais executivos da Meta têm passado a maior parte do tempo em IA. O CEO da Meta, Mark Zuckerberg, anunciou em fevereiro um novo grupo de produtos focado em IA generativa após lançar seu novo modelo de linguagem grande chamado LLaMA (Large Language Model Meta AI).

A empresa deve lançar alguns aplicativos de IA para criação de anúncios este ano, disse Bosworth ao Nikkei.

Consulte Mais informação:

Square Enix planeja expansão para desenvolver estratégia do Metaverso

Samsung Latam entra no metaverso com “House of Sam” na Decentraland

Meta: os usuários agora podem fazer cross-post de NFTs no Instagram e no Facebook

CFTC revela novas acusações contra Sam Bankman-Fried, FTX e Alameda

O CEO da OpenAI afirma que o sistema educacional deve se adaptar ao ChatGPT, não proibi-lo

A postagem Meta apresenta Segment Anything, seu novo modelo de IA para segmentação de imagens apareceu primeiro em Metaverse Post.