A versão de código aberto do modelo Flamingo da DeepMind, OpenFlamingo, acaba de ser lançada. OpenFlamingo é fundamentalmente uma estrutura que permite o treinamento e avaliação de modelos multimodais (LMMs) de tamanho considerável. OpenFlamingo é construído sobre o modelo de linguagem grande LLaMA desenvolvido pela Meta AI.

Leia mais: Como usar o Midjourney gratuitamente para sempre: 5 etapas simples

Leia mais: Como usar o Midjourney gratuitamente para sempre: 5 etapas simples

As contribuições dos desenvolvedores para este primeiro lançamento são as seguintes:

Um conjunto de dados multimodal considerável que combina sequências de texto e visuais.

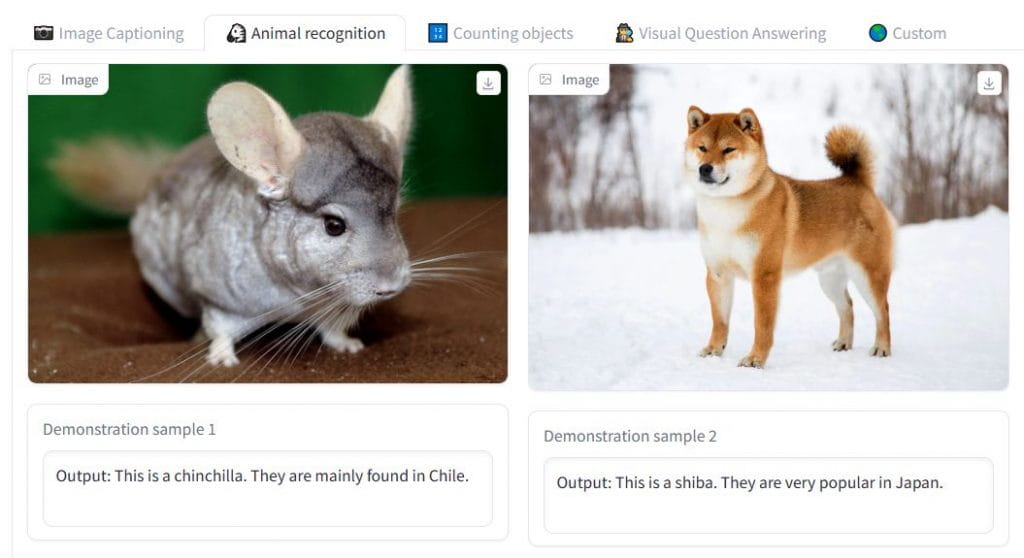

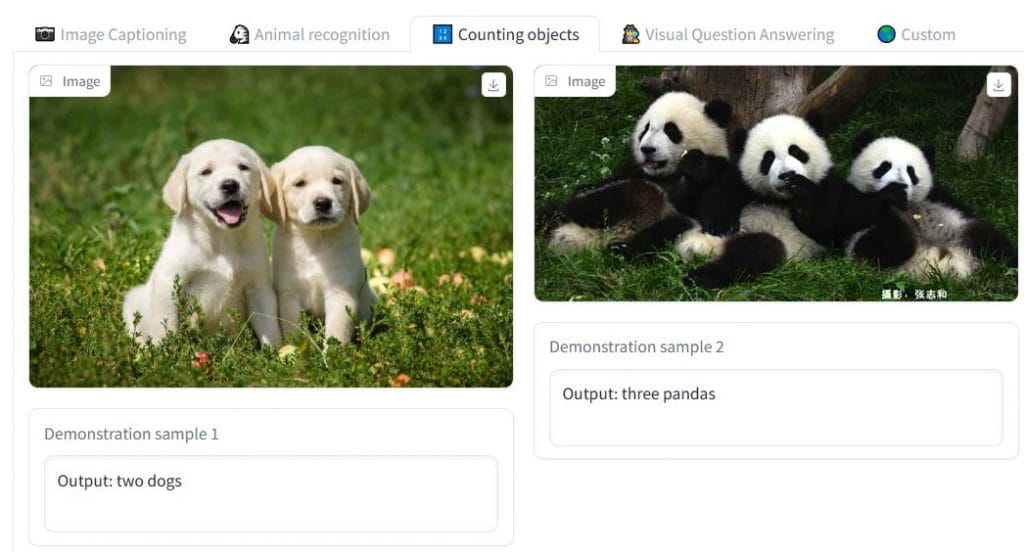

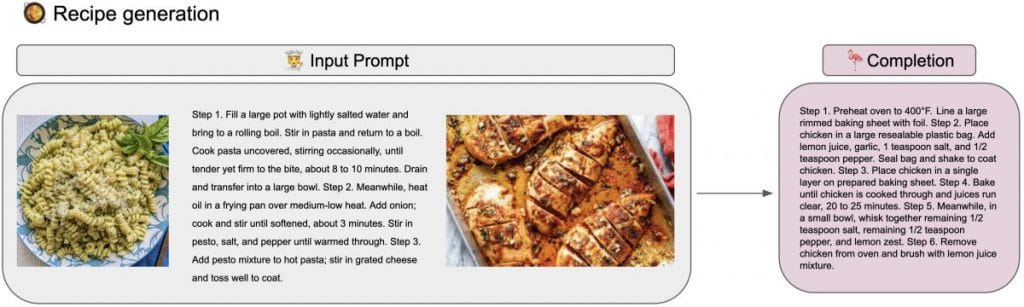

Uma referência para avaliação de aprendizagem em contexto para atividades que incluem visão e linguagem.

Uma versão preliminar do nosso modelo OpenFlamingo-9B baseado em LLaMA.

Através do OpenFlamingo, os desenvolvedores esperam criar um sistema multimodal que possa lidar com uma variedade de desafios de linguagem visual. O objetivo final é igualar a força e adaptabilidade do GPT-4 no tratamento de entradas visuais e de texto. Os desenvolvedores estão desenvolvendo uma versão de código aberto do modelo Flamingo da DeepMind, um LMM capaz de processar e raciocinar sobre imagens, vídeos e texto, para atingir esse objetivo. Os desenvolvedores dedicam-se ao desenvolvimento de modelos inteiramente de código aberto porque pensam que a transparência é crucial para promover a cooperação, acelerar o desenvolvimento e democratizar o acesso a LMMs de ponta.

Eles estão fornecendo o ponto de verificação inicial do nosso modelo OpenFlamingo-9B. Embora o modelo ainda não esteja totalmente otimizado, ele mostra a promessa do projeto. Os desenvolvedores podem treinar LMMs melhores cooperando e obtendo feedback da comunidade. Eles convidam o público a contribuir e adicionar informações ao repositório para participar do processo de desenvolvimento.

A implementação se assemelha muito à do Flamingo. Os modelos Flamingo devem ser treinados em conjuntos de dados da web em grande escala com texto e gráficos intercalados para equipá-los com habilidades de aprendizagem contextualizadas em poucos minutos. A mesma arquitetura sugerida no estudo original do Flamingo (reamostradores de percepção, camadas de atenção cruzada) é implementada no OpenFlamingo. Mas, como os dados de treinamento do Flamingo não são acessíveis ao público em geral, os desenvolvedores usam conjuntos de dados de código aberto para treinar modelos. O ponto de verificação OpenFlamingo-9B recém-publicado foi treinado especificamente em 10 milhões de amostras do LAION-2B e 5 milhões de amostras do novo conjunto de dados Multimodal C4.

Os desenvolvedores também estão incluindo um ponto de verificação do nosso LMM OpenFlamingo-9B inacabado, que é baseado no LLaMA 7B e no CLIP ViT/L-14, como parte do lançamento. Embora este conceito ainda esteja em desenvolvimento, a comunidade já pode beneficiar muito com ele.

Para começar, consulte a fonte e a demonstração do GitHub.

Leia mais sobre IA:

Espera-se que os custos de treinamento do modelo de IA aumentem de US$ 100 milhões para US$ 500 milhões até 2030

Ada, o novo agente de IA adaptativo da DeepMind, é quase tão inteligente quanto um ser humano

DeepMind lançou a ferramenta de IA Dramatron, que gera um rascunho completo de um roteiro de filme ou programa de TV

A postagem OpenFlamingo: uma nova estrutura de imagem para texto de código aberto da Meta AI e LAION apareceu pela primeira vez no Metaverse Post.