Título original: "Do GPT-1 ao GPT-4, veja a ascensão do ChatGPT"

Autor original: Alpha Rabbit Research Notes

O que é ChatGPT?

O que é ChatGPT?

Recentemente, a OpenAI lançou o ChatGPT, um modelo que pode interagir de forma conversacional e foi bem recebido por muitos usuários. ChatGPT também é parente do InstructGPT lançado anteriormente pela OpenAI. O modelo ChatGPT é treinado usando RLHF (aprendizado por reforço com feedback humano). Talvez a chegada do ChatGPT seja também o prelúdio antes do lançamento oficial do GPT-4 da OpenAI.

O que é GPT? De GPT-1 a GPT-3

Generative Pre-trained Transformer (GPT) é um modelo de aprendizagem profunda de geração de texto treinado em dados disponíveis na Internet. Ele é usado para resposta a perguntas, resumo de texto, tradução automática, classificação, geração de código e IA de conversação.

Em 2018 nasceu o GPT-1, que também foi o primeiro ano de modelos de pré-treinamento para PNL (processamento de linguagem natural). Em termos de desempenho, o GPT-1 possui certa capacidade de generalização e pode ser utilizado em tarefas de PNL que nada têm a ver com tarefas de supervisão. As tarefas comuns incluem:

Raciocínio em linguagem natural: determine a relação entre duas sentenças (contenção, contradição, neutralidade)

Perguntas e respostas e raciocínio de bom senso: insira um artigo e várias respostas e produza a precisão da resposta

Reconhecimento de similaridade semântica: determine se duas sentenças estão semanticamente relacionadas

Categoria: determine a qual categoria o texto de entrada pertence

Embora o GPT-1 tenha alguns efeitos em tarefas não ajustadas, sua capacidade de generalização é muito menor do que a de tarefas supervisionadas ajustadas. Portanto, o GPT-1 só pode ser considerado uma ferramenta de compreensão de linguagem bastante boa, em vez de uma IA de conversação.

O GPT-2 também chegou conforme programado em 2019. No entanto, o GPT-2 não realizou muitas inovações estruturais e projetos na rede original. Ele usou apenas mais parâmetros de rede e um conjunto de dados maior: o modelo máximo total possui 48 camadas. e 1,5 bilhão de parâmetros. A meta de aprendizagem usa um modelo de pré-treinamento não supervisionado para realizar tarefas supervisionadas. Em termos de desempenho, além das capacidades de compreensão, o GPT-2 mostrou pela primeira vez um forte talento em geração: leitura de resumos, bate-papo, continuação da escrita, invenção de histórias e até geração de notícias falsas, e-mails de phishing ou role-playing on-line. Não é um problema. Depois de "tornar-se maior", o GPT-2 demonstrou suas capacidades universais e poderosas e alcançou o melhor desempenho da época em múltiplas tarefas específicas de modelagem de linguagem.

Depois disso, o GPT-3 apareceu como um modelo não supervisionado (agora frequentemente chamado de modelo autossupervisionado), que pode quase completar a maioria das tarefas de processamento de linguagem natural, como pesquisa orientada a problemas, compreensão de leitura, inferência semântica e tradução automática. , geração de artigos e perguntas e respostas automáticas, etc. Além disso, o modelo tem um bom desempenho em muitas tarefas, como atingir o nível de ponta atual em tarefas de tradução automática francês-inglês e alemão-inglês. Os artigos gerados automaticamente são quase impossíveis de distinguir entre humanos e máquinas (apenas). 52% de precisão), comparável à adivinhação aleatória), e o que é ainda mais surpreendente é que atinge quase 100% de precisão em tarefas de adição e subtração de dois dígitos e pode até gerar código automaticamente com base na descrição da tarefa. Um modelo não supervisionado tem muitas funções e bons efeitos, e parece que as pessoas veem a esperança da inteligência artificial geral. Esta pode ser a principal razão pela qual o GPT-3 tem um impacto tão grande.

O que exatamente é o modelo GPT-3?

Na verdade, o GPT-3 é um modelo de linguagem estatística simples. Do ponto de vista do aprendizado de máquina, os modelos de linguagem modelam a distribuição de probabilidade de sequências de palavras, ou seja, usam os fragmentos que foram ditos como condições para prever a distribuição de probabilidade de palavras diferentes que aparecem no momento seguinte. Por um lado, o modelo de linguagem pode medir o grau em que uma frase está em conformidade com a gramática da língua (por exemplo, medir se a resposta gerada automaticamente pelo sistema de diálogo humano-computador é natural e fluente), e também pode ser usado para prever e gerar novas sentenças. Por exemplo, para um clipe “São 12 horas, vamos juntos a um restaurante”, o modelo de linguagem pode prever as palavras que podem aparecer depois de “restaurante”. Um modelo de linguagem geral irá prever que a próxima palavra será “comer”. Um modelo de linguagem poderoso pode capturar as informações de tempo e prever a palavra “almoçar” que se ajusta ao contexto.

Normalmente, se um modelo de linguagem é poderoso depende principalmente de dois pontos: primeiro, se o modelo pode fazer uso de todas as informações de contexto histórico. No exemplo acima, se não puder capturar as informações semânticas de longo alcance de "12 horas", o. o modelo de linguagem será quase incapaz de prever a próxima vez. Em segundo lugar, depende também se existe um contexto histórico suficientemente rico para o modelo aprender, ou seja, se o corpus de formação é suficientemente rico. Como o modelo de linguagem é um aprendizado auto-supervisionado, o objetivo da otimização é maximizar a probabilidade do modelo de linguagem do texto visto, de modo que qualquer texto possa ser usado como dados de treinamento sem rotulagem.

Devido ao desempenho mais forte do GPT-3 e significativamente mais parâmetros, ele contém mais texto de tópico, o que é obviamente melhor do que o GPT-2 da geração anterior. Como a maior rede neural densa disponível atualmente, o GPT-3 pode converter descrições de páginas da web em códigos correspondentes, imitar narrativas humanas, criar poemas personalizados, gerar scripts de jogos e até mesmo imitar filósofos falecidos – prevendo o verdadeiro significado da vida. E o GPT-3 não requer ajuste fino, apenas algumas amostras do tipo de saída (uma pequena quantidade de aprendizado) para lidar com problemas gramaticais difíceis. Pode-se dizer que o GPT-3 parece ter satisfeito toda a imaginação dos especialistas em idiomas.

Nota: O texto acima refere-se principalmente aos seguintes artigos:

1. O GPT 4 está prestes a ser lançado e é comparável ao cérebro humano. Muitos grandes players do setor não conseguem ficar parados! -Xu Jiecheng, Yun Zhao -Conta pública 51 CTO Technology Stack- 24/11/2022 18:08

2. Responda sua curiosidade sobre o GPT-3 em um artigo! O que é GPT-3? Por que é tão excelente? -Instituto de Automação Zhang Jiajun, Academia Chinesa de Ciências Publicado em Pequim em 11/11/2020 17:25

3.O lote: 329 | InstructGPT, um modelo de linguagem mais amigável e gentil - conta pública DeeplearningAI-2022-02-07 12:30

Quais são os problemas do GPT-3?

Mas o GTP-3 não é perfeito. Um dos principais problemas que mais preocupam as pessoas na inteligência artificial é que os chatbots e as ferramentas de geração de texto tendem a aprender todos os textos da Internet de forma indiscriminada e de qualidade. ou mesmo uma linguagem ofensiva é produzida, o que afetará totalmente sua próxima aplicação.

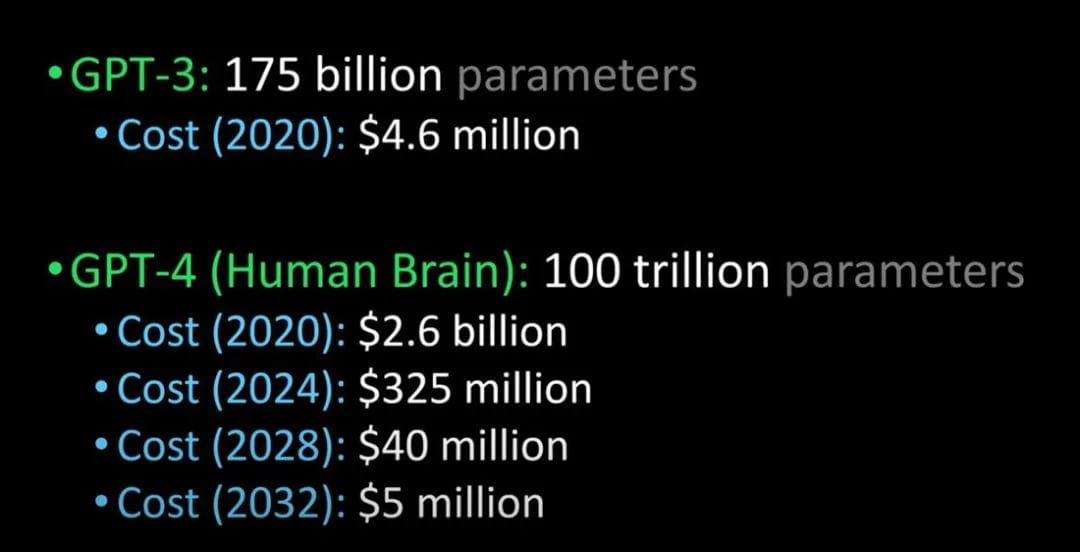

A OpenAI também propôs que um GPT-4 mais poderoso seja lançado em um futuro próximo:

Comparando GPT-3 com GPT-4 e o cérebro humano (Crédito da imagem: Lex Fridman @youtube)

Diz-se que o GPT-4 será lançado no próximo ano. Ele pode passar no teste de Turing e ser tão avançado que será indistinguível dos humanos. Além disso, o custo para as empresas introduzirem o GPT-4 também será bastante reduzido.

ChatGP e InstructGPT

ChatGPT e InstructGPT

Ao falar de Chatgpt, temos que falar de seu “predecessor” InstructGPT.

No início de 2022, a OpenAI lançou o InstructGPT nesta pesquisa, em comparação com o GPT-3, a OpenAI usou a pesquisa de alinhamento para treinar um modelo de linguagem que é mais realista, mais inofensivo e que segue melhor as intenções do usuário. versão do GPT-3 que minimiza resultados prejudiciais, irrealistas e tendenciosos.

Como funciona o InstructGPT?

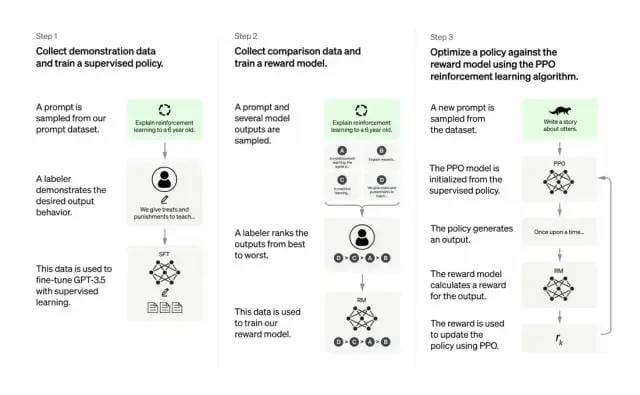

Os desenvolvedores fazem isso combinando aprendizagem supervisionada + aprendizagem por reforço a partir de feedback humano. Para melhorar a qualidade de saída do GPT-3. Nesse tipo de aprendizagem, os humanos classificam os resultados potenciais de um modelo. Os algoritmos de aprendizagem por reforço recompensam os modelos que produzem material semelhante ao resultado de alto nível;

O conjunto de dados de treinamento começa criando prompts, alguns dos quais são baseados em informações de usuários do GPT-3, como “Conte-me uma história sobre um sapo” ou “Explique o pouso na lua para uma criança de 6 anos em poucas frases. ”

Os desenvolvedores dividiram o prompt em três partes e criaram respostas para cada parte de forma diferente:

Os escritores humanos respondem ao primeiro conjunto de solicitações. Os desenvolvedores ajustaram um GPT-3 treinado e o transformaram em InstructGPT para gerar respostas existentes para cada prompt.

A próxima etapa é treinar um modelo para recompensar melhores respostas com recompensas maiores. Para o segundo conjunto de prompts, o modelo otimizado gera múltiplas respostas. Os avaliadores humanos classificam cada resposta. Dado um prompt e duas respostas, um modelo de recompensa (outro GPT-3 pré-treinado) aprendeu a calcular uma recompensa mais alta para a resposta com classificação mais alta e uma recompensa mais baixa para a resposta com classificação mais baixa.

Os desenvolvedores aperfeiçoaram ainda mais o modelo de linguagem usando um terceiro conjunto de dicas e o método de aprendizagem por reforço Proximal Policy Optimization (PPO). Quando uma solicitação é dada, o modelo de linguagem gera uma resposta e o modelo de recompensa a recompensa de acordo. PPO usa recompensas para atualizar o modelo de linguagem.

Referência para este parágrafo: The Batch: 329 | InstructGPT, um modelo de linguagem mais amigável e suave - conta pública DeeplearningAI- 2022-02-07 12: 30

O que é importante? O núcleo é que a inteligência artificial precisa ser uma inteligência artificial responsável

O modelo de linguagem da OpenAI pode ajudar nas áreas de educação, terapeutas virtuais, auxílios à escrita, jogos de RPG, etc. Nessas áreas, a existência de preconceito social, desinformação e informação tóxica é mais problemática, e os sistemas que podem evitar essas falhas podem ser mais capaz.

Quais são as diferenças entre os processos de treinamento do Chatgpt e do InstructGPT?

Em geral, o Chatgpt, como o InstructGPT acima, é treinado usando RLHF (Reinforcement Learning from Human Feedback). A diferença é como os dados são configurados para treinamento (e coletados). (Explicação aqui: o modelo InstructGPT anterior forneceu uma saída para uma entrada e depois comparou-a com os dados de treinamento. Sim, houve recompensas e não penalidades; o Chatgpt atual é uma entrada e o modelo fornece várias saídas, e então as pessoas dar Essa classificação dos resultados de saída permite que o modelo classifique esses resultados de "mais parecidos com os humanos" a "absurdos", permitindo que o modelo aprenda a maneira como os humanos classificam. Essa estratégia é chamada de aprendizado supervisionado. Obrigado ao Dr. Zhang Zijie por. este parágrafo)

Quais são as limitações do ChatGPT?

do seguinte modo:

a) Durante a fase de treinamento de aprendizagem por reforço (RL), não existe uma fonte específica de verdade e respostas padrão para suas perguntas.

b) O modelo é treinado para ser mais cauteloso e pode rejeitar respostas (para evitar falsos positivos de prompts).

c) O treinamento supervisionado pode enganar/influenciar o modelo no sentido de saber a resposta ideal, em vez de o modelo gerar um conjunto aleatório de respostas e apenas revisores humanos escolherem as respostas boas/com melhor classificação

Nota: ChatGPT é sensível ao texto. , às vezes o modelo acaba não respondendo a uma frase, mas com um leve ajuste na pergunta/frase, acaba respondendo corretamente. Os formadores tendem a preferir respostas mais longas porque podem parecer mais abrangentes, levando a uma tendência para respostas mais longas e ao uso excessivo de certas frases no modelo. Se a sugestão ou pergunta inicial for ambígua, o modelo não solicitará esclarecimentos adequados.

As limitações autoidentificadas do ChatGPT são as seguintes.

Respostas que parecem plausíveis, mas incorretas:

a) Não existe uma fonte real de verdade para corrigir esse problema durante a fase de treinamento de Aprendizagem por Reforço (RL).

b) O modelo de treinamento para ser mais cauteloso pode recusar-se erroneamente a responder (falso positivo de instruções problemáticas).

c) O treinamento supervisionado pode enganar/enviesar o modelo tende a saber a resposta ideal em vez de o modelo gerar um conjunto aleatório de respostas e apenas os revisores humanos que selecionam uma resposta boa/altamente classificada. O ChatGPT é sensível ao fraseado. Às vezes o modelo acaba sem resposta para uma frase, mas com um leve ajuste na pergunta/frase, acaba respondendo corretamente.

Os instrutores preferem respostas mais longas que possam parecer mais abrangentes, levando a uma tendência a respostas detalhadas e ao uso excessivo de certas frases. O modelo não pede esclarecimentos adequadamente se o prompt ou pergunta inicial for ambíguo. Uma camada de segurança para recusar solicitações inadequadas por meio da API de moderação foi implementado. No entanto, ainda podemos esperar respostas falsas negativas e positivas.

referências:

1.https://medium.com/inkwater-atlas/chatgpt-the-new-frontier-of-artificial-intelligence-9 aee 81287677

2.https://pub.towardsai.net/openai-debuts-chatgpt-50 dd 611278 a 4

3.https://openai.com/blog/chatgpt/

4. O GPT 4 está prestes a ser lançado e é comparável ao cérebro humano. Muitos grandes players do setor não conseguem ficar parados! -Xu Jiecheng, Yun Zhao -Conta pública 51 CTO Technology Stack- 24/11/2022 18:08

5. Responda sua curiosidade sobre o GPT-3 em um artigo! O que é GPT-3? Por que é tão excelente? -Instituto de Automação Zhang Jiajun, Academia Chinesa de Ciências Publicado em Pequim em 11/11/2020 17:25

6.O lote: 329 | InstructGPT, um modelo de linguagem mais amigável e gentil - conta pública DeeplearningAI-2022-02-07 12:30