Właśnie ukazała się otwarta wersja modelu Flamingo firmy DeepMind, OpenFlamingo. OpenFlamingo to zasadniczo framework umożliwiający szkolenie i ocenę dużych modeli multimodalnych (LMM). OpenFlamingo jest zbudowane na bazie dużego modelu językowego LLaMA opracowanego przez Meta AI.

Przeczytaj więcej: Jak korzystać z Midjourney za darmo na zawsze: 5 prostych kroków

Przeczytaj więcej: Jak korzystać z Midjourney za darmo na zawsze: 5 prostych kroków

Wkład programistów w tę pierwszą wersję jest następujący:

Duży, multimodalny zbiór danych łączący sekwencje tekstowe i wizualne.

Punkt odniesienia dla oceny uczenia się w kontekście dla działań obejmujących wzrok i język.

Wstępna wersja naszego modelu OpenFlamingo-9B opartego na LLaMA.

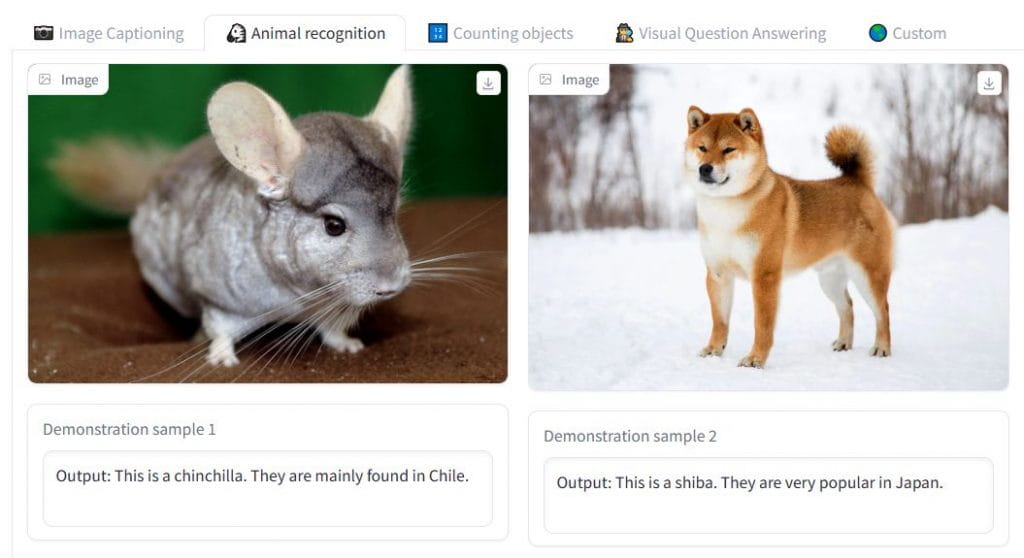

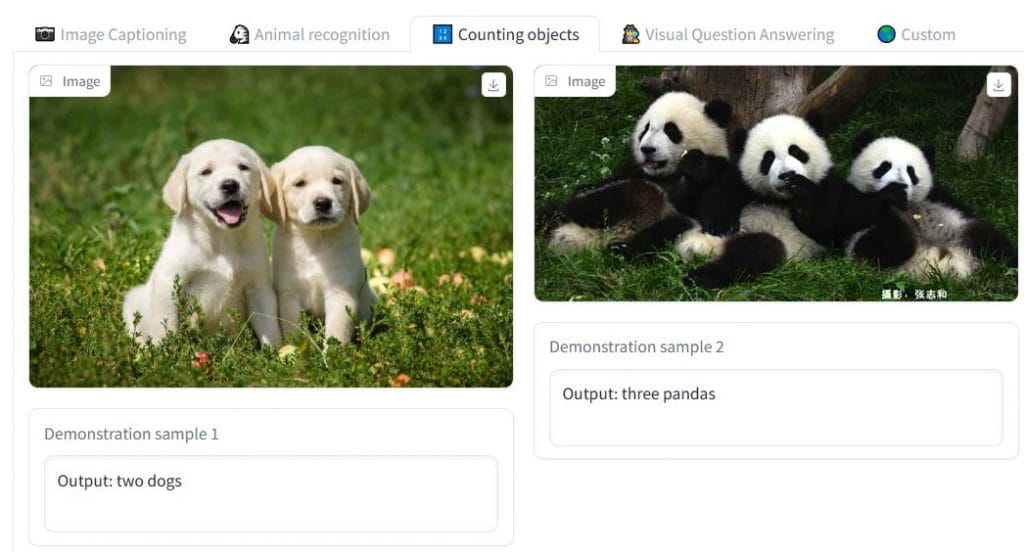

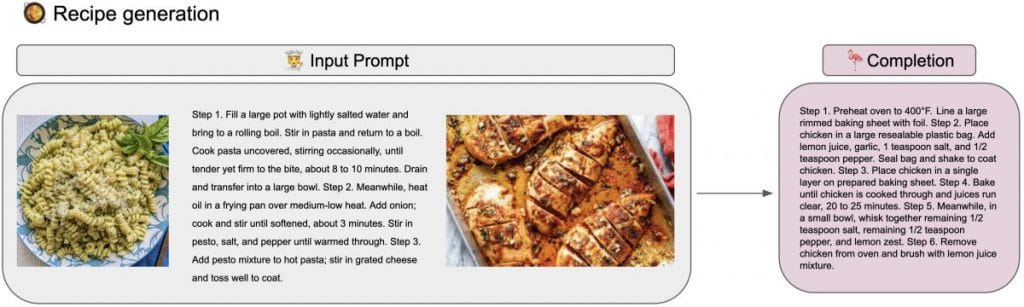

Dzięki OpenFlamingo programiści mają nadzieję stworzyć system multimodalny, który poradzi sobie z różnorodnymi wyzwaniami związanymi z wizją i językiem. Ostatecznym celem jest wyrównanie siły i możliwości adaptacji GPT-4 w obsłudze wprowadzania wizualnego i tekstowego. Aby osiągnąć ten cel, programiści opracowują wersję open source modelu Flamingo firmy DeepMind, LMM zdolnego do przetwarzania i wyciągania wniosków na temat obrazów, filmów i tekstu. Deweloperzy poświęcają się opracowywaniu modeli całkowicie open source, ponieważ uważają, że przejrzystość jest kluczowa dla promowania współpracy, przyspieszania rozwoju i demokratyzacji dostępu do najnowocześniejszych LMM.

Zapewniają początkowy punkt kontrolny naszego modelu OpenFlamingo-9B. Chociaż model nie jest jeszcze w pełni zoptymalizowany, pokazuje, że projekt jest obiecujący. Programiści mogą szkolić lepsze LMM, współpracując i uzyskując opinie społeczności. Zachęcają społeczeństwo do wnoszenia wkładu i uzupełniania repozytorium, aby wziąć udział w procesie rozwoju.

Implementacja bardzo przypomina tę z Flamingo. Modele flamingów należy szkolić na dużych internetowych zbiorach danych z przeplatanym tekstem i grafiką, aby wyposażyć je w umiejętności uczenia się w kontekście w kilku sytuacjach. Ta sama architektura, która została zasugerowana w oryginalnym badaniu Flamingo (resamplery Perceiver, warstwy wzajemnej uwagi) jest zaimplementowana w OpenFlamingo. Ponieważ jednak dane szkoleniowe Flamingo nie są dostępne publicznie, programiści korzystają z zestawów danych typu open source do uczenia modeli. Nowo opublikowany punkt kontrolny OpenFlamingo-9B został specjalnie przeszkolony na 10 milionach próbek z LAION-2B i 5 milionów próbek z nowego wielomodalnego zbioru danych C4.

W ramach tej wersji programiści dołączają także punkt kontrolny z naszego niedokończonego LMM OpenFlamingo-9B, opartego na LLaMA 7B i CLIP ViT/L-14. Choć koncepcja ta jest wciąż w fazie rozwoju, społeczność może już na niej wiele zyskać.

Aby rozpocząć, przejrzyj źródło i wersję demonstracyjną GitHuba.

Przeczytaj więcej o sztucznej inteligencji:

Oczekuje się, że koszty szkolenia w zakresie modeli sztucznej inteligencji wzrosną ze 100 milionów dolarów do 500 milionów dolarów do 2030 roku

Nowa adaptacyjna agentka AI DeepMind, Ada, jest prawie tak inteligentna jak człowiek

DeepMind wypuściło narzędzie AI Dramatron, które generuje pełnoprawną wersję scenariusza filmu lub programu telewizyjnego

Wpis OpenFlamingo: nowa platforma przetwarzania obrazu na tekst o otwartym kodzie źródłowym autorstwa Meta AI i LAION pojawił się jako pierwszy w Metaverse Post.