Kiedy po raz pierwszy użyłem Mira, nie czułem potrzeby korzystania z innego narzędzia AI. Myślałem, że lepsze podpowiedzi są rozwiązaniem. Ale moja perspektywa zmieniła się, gdy uświadomiłem sobie, jak pewne AI może być w swojej zdolności do popełniania błędów. Wtedy zacząłem poważnie badać Mirę.

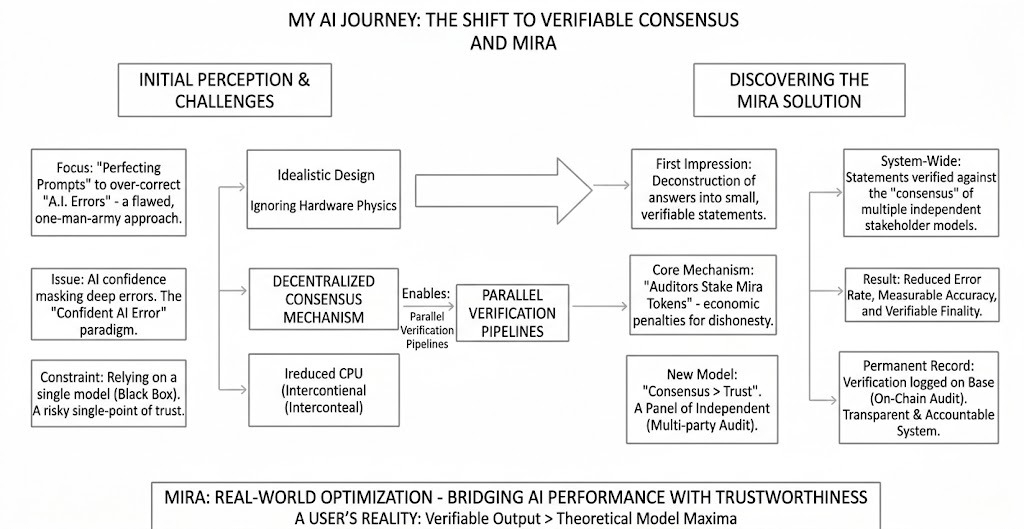

To, co zrobiło na mnie największe wrażenie, to jej odmowa traktowania wyników AI jako absolutnej prawdy. Mira nie akceptuje jednego, wszechogarniającego rozwiązania; zamiast tego dzieli odpowiedzi na mniejsze, bardziej szczegółowe stwierdzenia. Każde stwierdzenie jest weryfikowalne. Ta prosta zmiana zrewolucjonizowała wszystko. Przekształciła niejasne informacje w coś mierzalnego.

Co naprawdę mnie następnie zafascynowało, to zdecentralizowana weryfikacja. W przeciwieństwie do systemu GPT OpenAI, który opiera się na jednym modelu, Mira przesyła te oświadczenia do wielu niezależnych modeli prowadzonych przez różnych interesariuszy. Konsensus jest ważniejszy niż zaufanie. Gdy wiele różnych modeli się zgadza, szansa na błąd jest znacząco zmniejszona. To bardziej przypomina konsultację z panelem ekspertów niż zapytanie jednego eksperta.

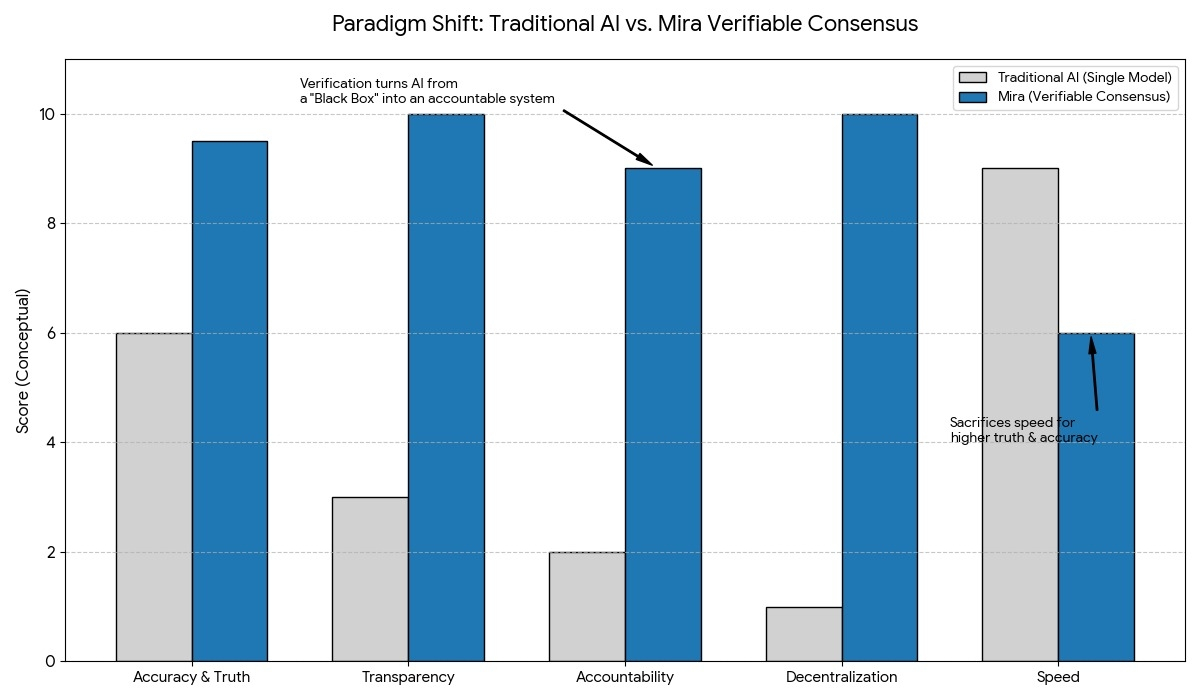

Dalszym wzmocnieniem mojej pewności był fakt, że wyniki weryfikacji są rejestrowane na Base. Ten mechanizm audytu na łańcuchu sprawia, że proces weryfikacji jest przejrzysty i trwale ważny. Ten system przekształca sztuczną inteligencję z czarnej skrzynki w system odpowiedzialny. Jego mechanizm ekonomiczny jest również dość pomysłowy. Audytorzy stawiają swoje tokeny Mira, a wszelkie nieuczciwe zachowanie jest karane. Dokładność, w rzeczywistości, przynosi nagrody. W dziedzinie sztucznej inteligencji szybkość często jest poświęcana na rzecz prawdy, a ten oparty na zachętach projekt jest odświeżający.

Dla mnie Mira reprezentuje zmianę paradygmatu. Przyszłość sztucznej inteligencji nie polega tylko na budowaniu większych modeli, ale także na systemach udowadniających swoją wartość przed zaufaniem. Jeśli sztuczna inteligencja ma być stosowana w opiece zdrowotnej, finansach lub systemach prawnych, weryfikacja nie jest w żadnym wypadku opcjonalna. Mira czyni z niej element niezbędny.

@Mira - Trust Layer of AI $MIRA