Meta ha introdotto Segment Anything, il suo nuovo modello di base per la segmentazione delle immagini. Il processo di identificazione dei pixel dell'immagine appartenenti a un oggetto è un compito cruciale nella visione artificiale e viene utilizzato in una varietà di applicazioni, dall'analisi di immagini scientifiche alla modifica delle foto.

Nel suo post introduttivo sul blog, l’azienda ha spiegato che la creazione di modelli di segmentazione accurati per compiti specifici nella visione artificiale ha in genere richiesto un lavoro specializzato da parte di esperti tecnici con accesso all’infrastruttura di formazione sull’intelligenza artificiale e grandi volumi di dati interni al dominio accuratamente annotati.

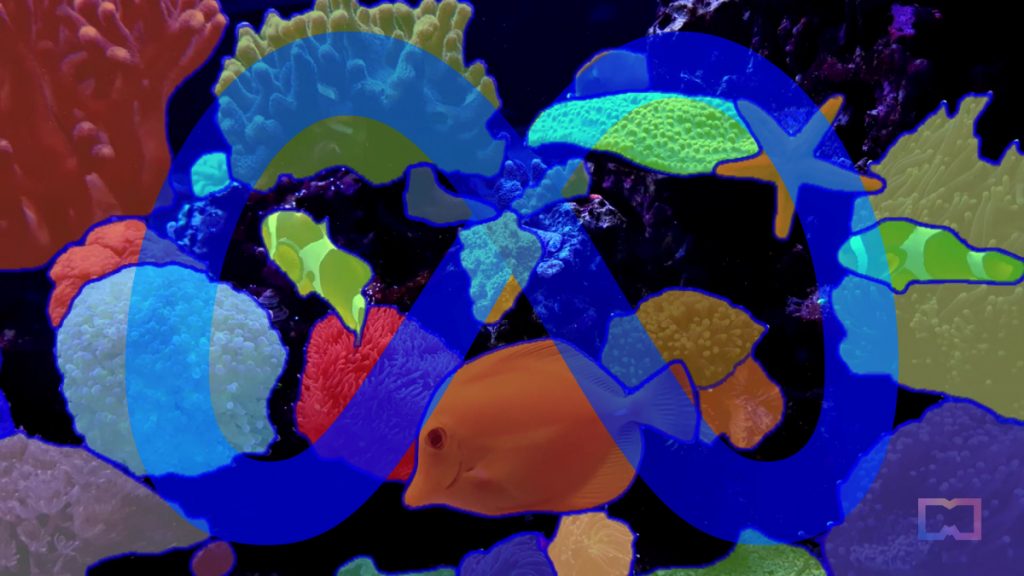

Tuttavia, questo potrebbe presto cambiare con il progetto Segment Anything, poiché si prevede che il suo nuovo set di dati e modello renderanno i modelli di segmentazione accurati più accessibili a un pubblico più ampio, eliminando la necessità di competenze tecniche e infrastrutture specializzate. Per raggiungere questo obiettivo, i ricercatori hanno creato un modello promptabile che viene addestrato su dati diversi e può adattarsi a compiti specifici, in modo simile a come il prompting viene utilizzato nei modelli di elaborazione del linguaggio naturale o nei chatbot.

Per democratizzare ulteriormente la segmentazione, Meta sta rendendo disponibile l'enorme dataset SA-1B per scopi di ricerca, e il Segment Anything Model è disponibile con una licenza aperta permissiva (Apache 2.0). Inoltre, l'azienda ha sviluppato una demo che consente agli utenti di provare SAM con le proprie immagini.

Meta vede potenziali casi d'uso per il SAM nei domini AI, AR/VR e creator. Il SAM ha il potenziale per diventare un elemento critico nei sistemi AI più grandi che mirano a raggiungere una comprensione multimodale più generale del mondo. Ad esempio, può facilitare la comprensione sia del contenuto visivo che testuale su una pagina web.

Inoltre, nel dominio AR/VR, SAM potrebbe abilitare la selezione di oggetti in base allo sguardo dell'utente e consentire all'oggetto di essere "sollevato" in 3D. Inoltre, i creatori di contenuti possono usare SAM per migliorare le applicazioni creative come l'estrazione di regioni di immagini per collage o editing video.

Meta ha intensificato i suoi sforzi di intelligenza artificiale nel mezzo del boom dell'intelligenza artificiale generativa e del calo di interesse nel metaverso. Nonostante la scommessa da 70 miliardi di dollari dell'azienda sul metaverso, la sua divisione metaverso Reality Labs ha registrato una perdita di 13,7 miliardi di dollari l'anno scorso. Di recente, Meta ha anche chiuso le sue operazioni NFT su Facebook e Instagram.

In un'intervista con Nikkei Asia mercoledì, il CTO di Meta Chris Bosworth ha affermato che i massimi dirigenti di Meta hanno trascorso la maggior parte del loro tempo sull'IA. Il CEO di Meta Mark Zuckerberg ha annunciato a febbraio un nuovo gruppo di prodotti focalizzato sull'IA generativa dopo aver rilasciato il suo nuovo modello linguistico di grandi dimensioni chiamato LLaMA (Large Language Model Meta AI).

Bosworth ha detto a Nikkei che quest'anno l'azienda dovrebbe lanciare alcune applicazioni di intelligenza artificiale per la creazione di annunci pubblicitari.

Per saperne di più:

Square Enix pianifica un'espansione per far crescere la strategia Metaverse

Samsung Latam entra nel metaverso con “House of Sam” in Decentraland

Meta: gli utenti ora possono pubblicare NFT su Instagram e Facebook

La CFTC svela nuove accuse contro Sam Bankman-Fried, FTX e Alameda

Il CEO di OpenAI afferma che il sistema educativo dovrebbe adattarsi a ChatGPT, non vietarlo

Il post Meta presenta Segment Anything, il suo nuovo modello di intelligenza artificiale per la segmentazione delle immagini è apparso per la prima volta su Metaverse Post.