La versione open source del modello Flamingo di DeepMind, OpenFlamingo, è appena stata rilasciata. OpenFlamingo è fondamentalmente un framework che consente la formazione e la valutazione di modelli multimodali di considerevoli dimensioni (LMM). OpenFlamingo è basato sul modello linguistico di grandi dimensioni LLaMA sviluppato da Meta AI.

Per saperne di più: Come utilizzare Midjourney gratuitamente per sempre: 5 semplici passaggi

Per saperne di più: Come utilizzare Midjourney gratuitamente per sempre: 5 semplici passaggi

I contributi degli sviluppatori a questa prima versione sono i seguenti:

Un set di dati multimodale di considerevoli dimensioni che combina testo e sequenze visive.

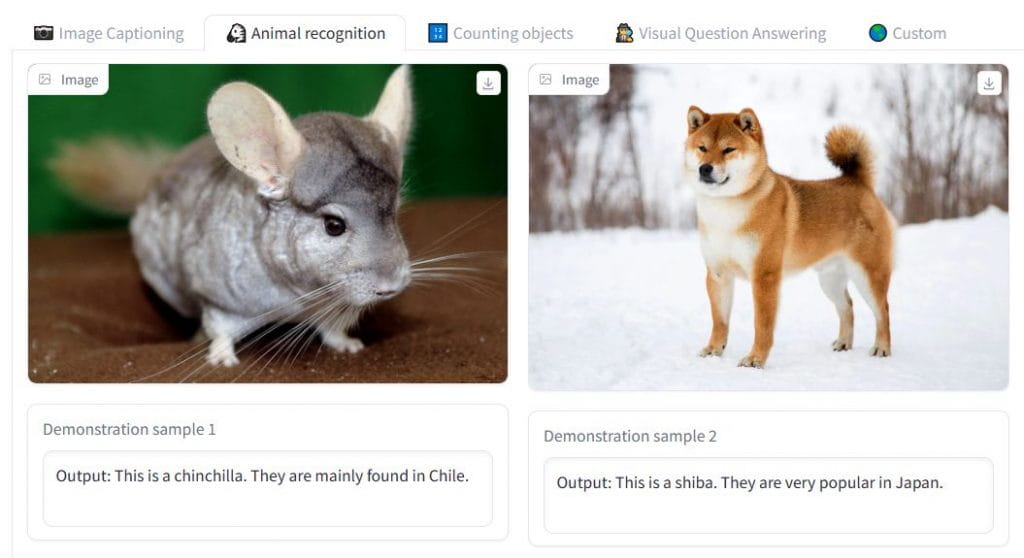

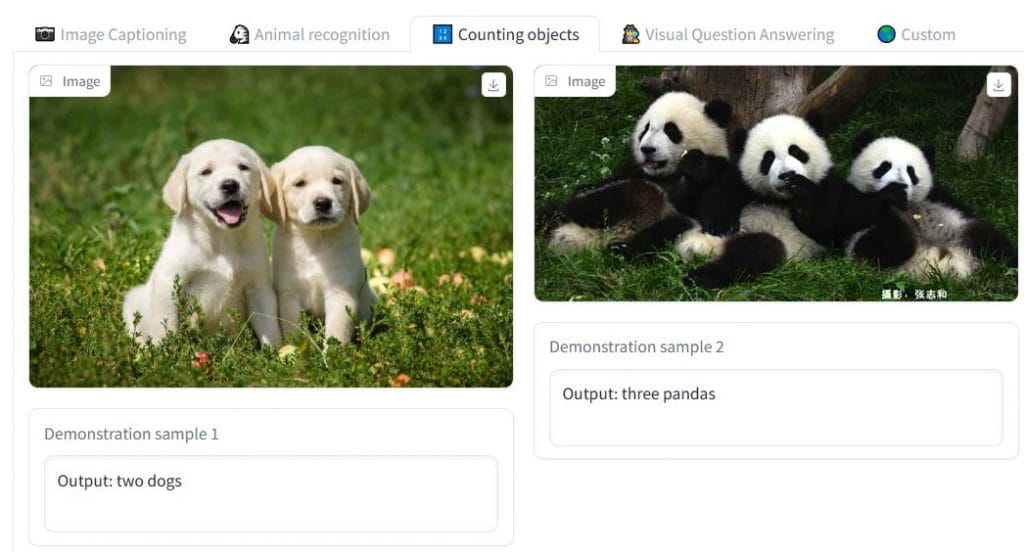

Un punto di riferimento per la valutazione dell'apprendimento in contesto per attività che includono visione e linguaggio.

Una versione preliminare del nostro modello OpenFlamingo-9B basato su LLaMA.

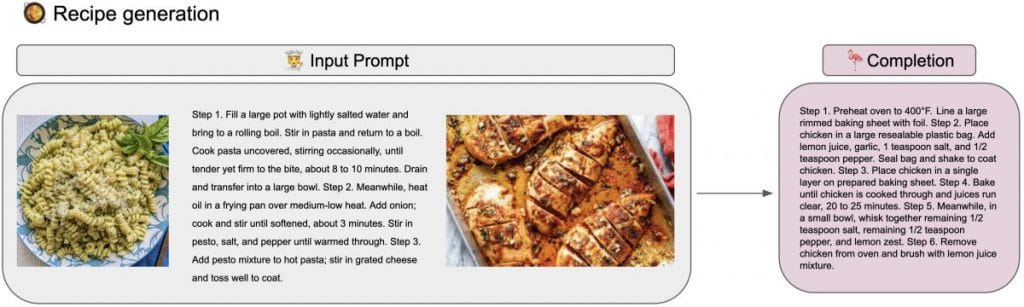

Attraverso OpenFlamingo, gli sviluppatori sperano di creare un sistema multimodale in grado di gestire una serie di sfide legate al linguaggio visivo. L’obiettivo finale è eguagliare la forza e l’adattabilità di GPT-4 nella gestione dell’input visivo e di testo. Gli sviluppatori stanno sviluppando una versione open source del modello Flamingo di DeepMind, un LMM in grado di elaborare e ragionare su immagini, video e testo, per raggiungere questo obiettivo. Gli sviluppatori si dedicano allo sviluppo di modelli interamente open source perché ritengono che la trasparenza sia fondamentale per promuovere la cooperazione, accelerare lo sviluppo e democratizzare l’accesso a LMM all’avanguardia.

Stanno fornendo il checkpoint iniziale del nostro modello OpenFlamingo-9B. Sebbene il modello non sia ancora del tutto ottimizzato, mostra la promessa del progetto. Gli sviluppatori possono formare LMM migliori collaborando e ottenendo feedback dalla comunità. Invitano il pubblico a fornire input e ad arricchire il repository per prendere parte al processo di sviluppo.

L’implementazione ricorda molto quella di Flamingo. I modelli Flamingo devono essere addestrati su set di dati web su larga scala con testo e grafica interlacciati per dotarli di capacità di apprendimento a breve termine nel contesto. La stessa architettura suggerita nello studio originale di Flamingo (ricampionatori di percettori, livelli di attenzione incrociata) è implementata in OpenFlamingo. Tuttavia, poiché i dati di addestramento di Flamingo non sono accessibili al grande pubblico, gli sviluppatori utilizzano set di dati open source per addestrare i modelli. Il checkpoint OpenFlamingo-9B appena pubblicato è stato specificamente addestrato su 10 milioni di campioni da LAION-2B e 5 milioni di campioni dal nuovo set di dati Multimodal C4.

Gli sviluppatori includono anche un checkpoint del nostro LMM OpenFlamingo-9B incompleto, basato su LLaMA 7B e CLIP ViT/L-14, come parte del rilascio. Anche se questo concetto è ancora in fase di sviluppo, la comunità potrebbe già trarne grandi benefici.

Per iniziare, guarda il codice sorgente e la demo di GitHub.

Ulteriori informazioni sull'intelligenza artificiale:

Si prevede che i costi di formazione dei modelli di intelligenza artificiale aumenteranno da 100 milioni di dollari a 500 milioni di dollari entro il 2030

Il nuovo agente AI adattivo di DeepMind, Ada, è intelligente quasi quanto un essere umano

DeepMind ha rilasciato lo strumento AI Dramatron, che genera una bozza completa della sceneggiatura di un film o di un programma televisivo

Il post OpenFlamingo: un nuovo framework immagine-testo open source da Meta AI e LAION è apparso per la prima volta su Metaverse Post.