Ricordo di aver sospeso il cursore sul pulsante “stake”, esitando senza un motivo chiaro.

Tutto sembrava a posto, l'APY era attraente, i termini di blocco erano standard. Eppure, qualcosa sembrava strano.

Non mi stavo impegnando in nulla. Stavo solo posizionando capitale.

E per un sistema che affermava di essere “sicuro”, quella realizzazione sembrava stranamente vuota.

Più osservavo, più notavo quanto fosse stato facilmente astratto il coinvolgimento.

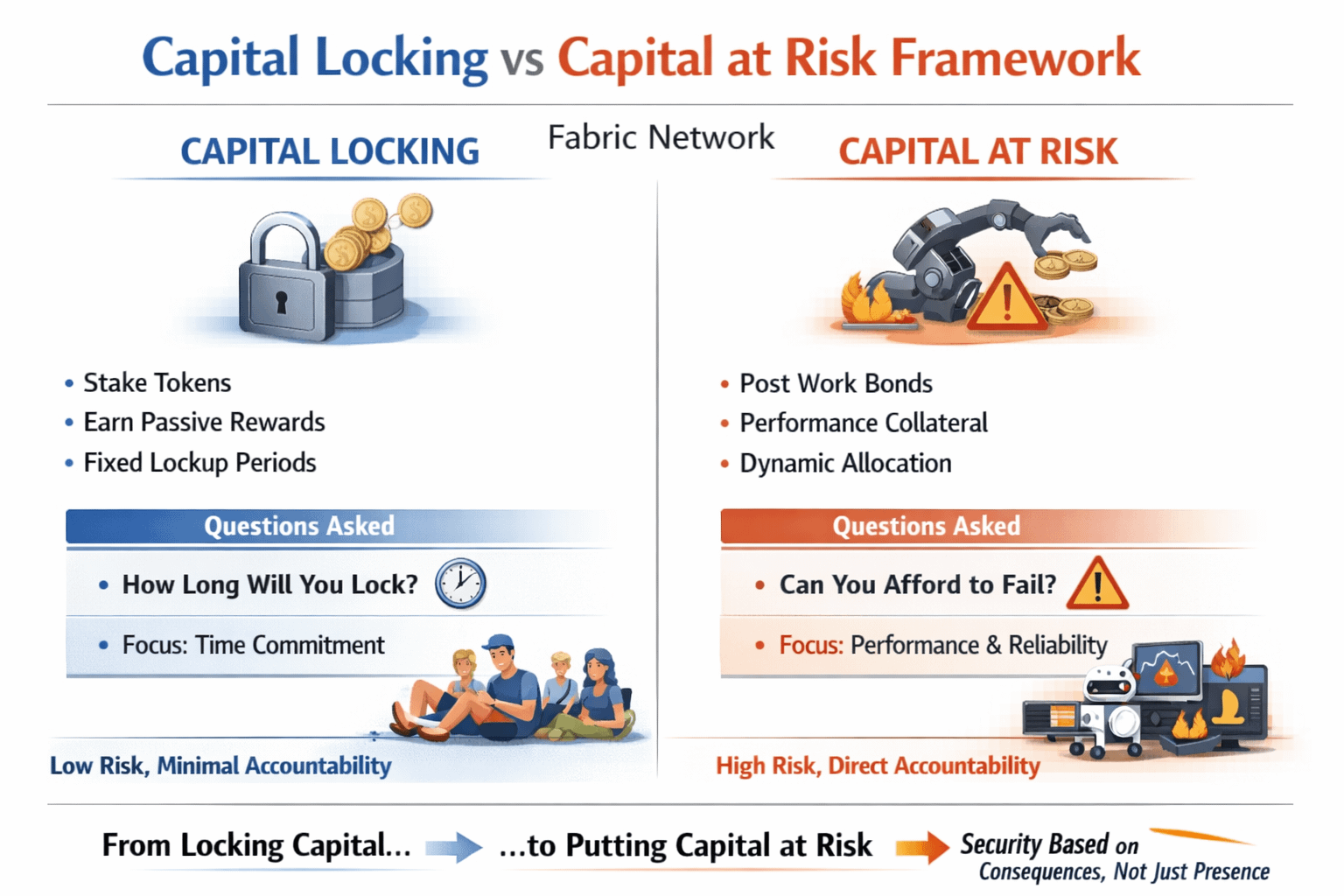

Blocca token, guadagna ricompense, ripeti.

Ma cosa veniva esattamente garantito? Non c'era una relazione diretta tra ciò che qualcuno faceva e ciò che poteva perdere.

Nei sistemi puramente digitali, forse è sufficiente. Ma nelle reti che coordinano il lavoro del mondo reale, macchine, compiti, risultati, sembrava incompleto.

La sicurezza non dovrebbe provenire dalla responsabilità, ma solo dalla presenza del capitale?

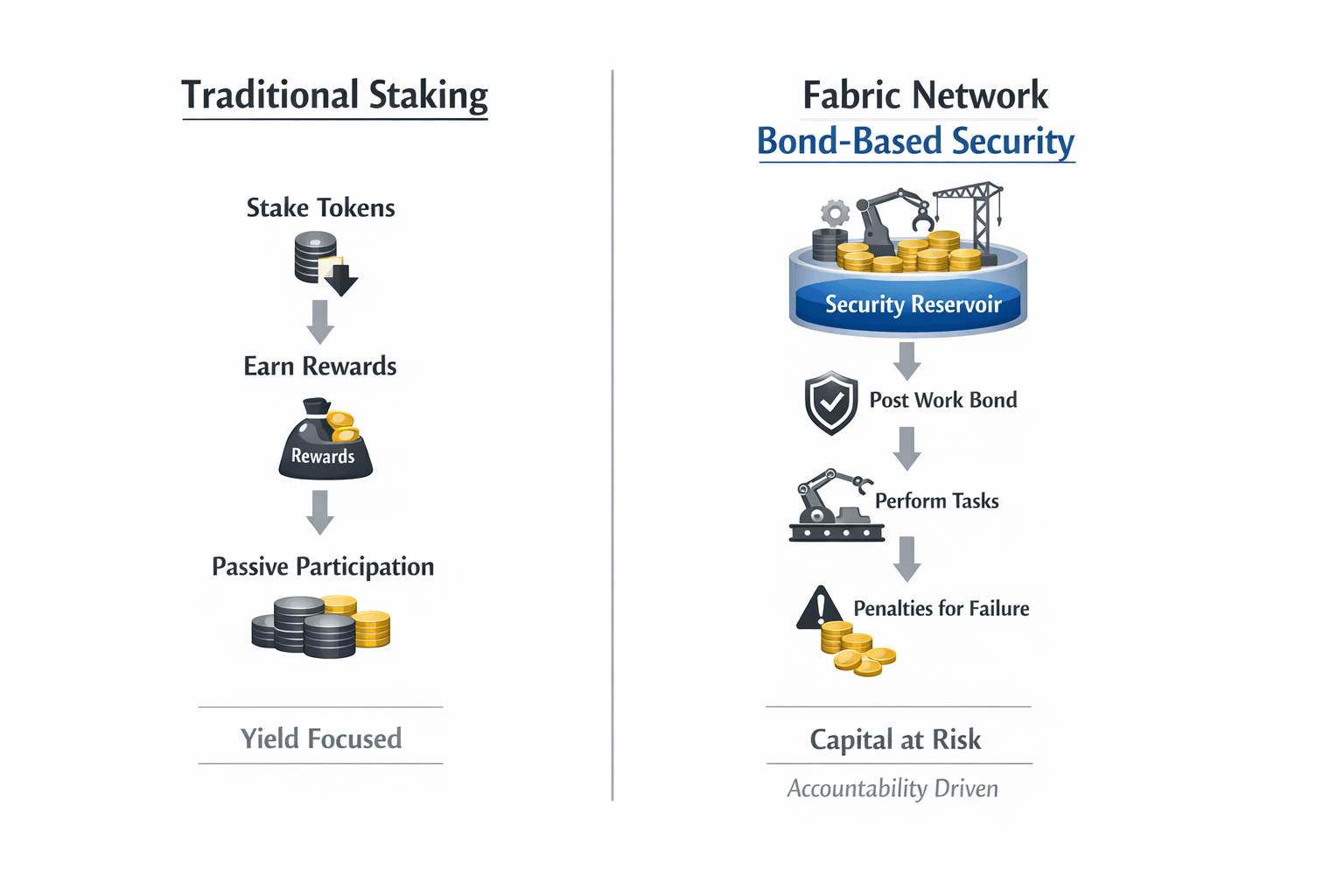

Quando ho incontrato per la prima volta il @Fabric Foundation e il design dietro il #ROBO token, mi aspettavo una variazione dello stesso modello.

Un altro sistema di staking, leggermente riformulato.

All'inizio, il termine “Bacino di Sicurezza” sembrava un'astrazione non necessaria.

Ma riflettendo, non era astrazione, era un cambiamento di definizione.

Non si trattava di bloccare token.

Si trattava di mettere il capitale dietro il comportamento.

Ciò che si è distinto non era il vincolo stesso, ma ciò che significava.

In Fabric, gli operatori postano obbligazioni lavorative, depositi di prestazione richiesti per fornire servizi, non veicoli per guadagnare rendimento.

Più capacità un operatore rivendica, più capitale deve impegnare. Non come segnale ma come garanzia.

All'inizio, questo sembrava restrittivo.

Ma poi ho realizzato: costringe a una semplice domanda che la maggior parte dei sistemi evita.

Puoi davvero fornire ciò che affermi?

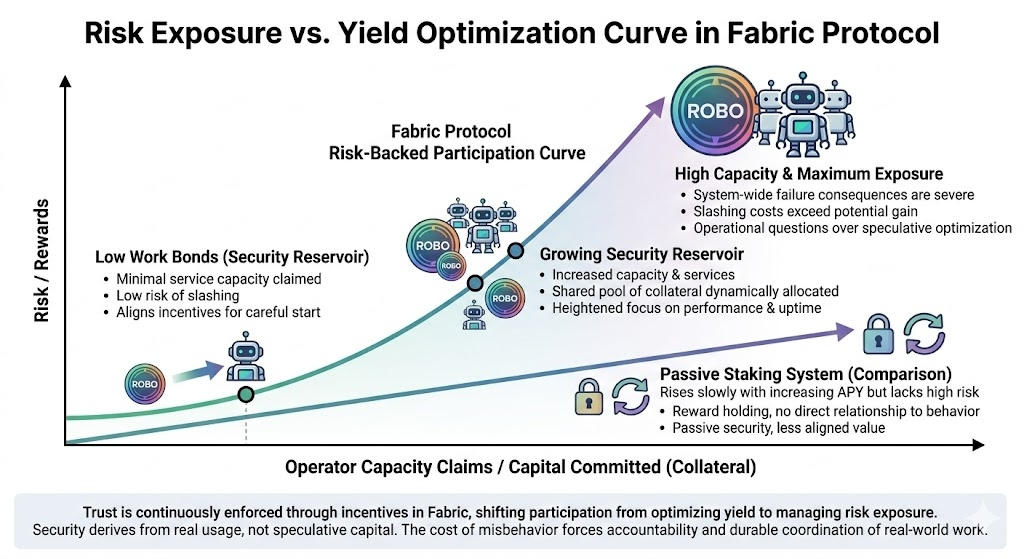

L'idea ha fatto clic per me quando ho capito il “bacino.”

Il vincolo non è bloccato per compito. Agisce come un pool condiviso di garanzie, da cui porzioni sono allocate dinamicamente al lavoro in corso.

Questo significa che lo stesso capitale è continuamente esposto attraverso più compiti.

Non inattivo. Non statico.

Costantemente a rischio.

E questo cambia la natura della partecipazione.

La maggior parte dei sistemi chiede:

Quanto tempo sei disposto a bloccare i tuoi token?

Questo sistema chiede qualcosa di molto diverso:

Puoi permetterti di fallire?

Perché qui, il fallimento ha conseguenze.

Frodi, inattività o qualità degradate possono innescare la riduzione del vincolo, garantendo che il costo del comportamento scorretto superi qualsiasi potenziale guadagno.

Quella singola scelta di design trasforma gli incentivi.

Non stai più ottimizzando il rendimento.

Stai gestendo l'esposizione.

Un dettaglio che inizialmente ho trascurato ma ora penso sia critico è come questo modello scala.

Man mano che più robot si uniscono alla rete e la capacità totale aumenta, il capitale vincolato totale cresce proporzionalmente.

La sicurezza non è fissa.

Si espande con un uso reale.

Questo significa che il sistema non si basa sul capitale speculativo per apparire sicuro. Deriva la sicurezza direttamente dall'attività economica reale.

E silenziosamente, questo crea qualcosa di più forte del valore bloccato.

Crea valore allineato.

Ma ciò che mi è rimasto davvero impresso non era il meccanismo, era la psicologia.

Quando il capitale è bloccato, pensi al tempo.

Quando il capitale è a rischio, pensi alle prestazioni.

Posso mantenere il tempo di attività?

Mi sto impegnando troppo?

Questo compito vale l'esposizione?

Queste sono domande operative.

E filtrano la partecipazione in un modo che gli incentivi da soli non potrebbero mai.

Non escludendo le persone, ma rendendo la partecipazione di bassa qualità economicamente irrazionale.

Più ci pensavo, più il sistema sembrava auto-regolarsi.

Gli operatori si comportano con cautela perché il loro capitale è direttamente esposto.

I validatori sono incentivati a rilevare frodi perché ne traggono beneficio.

Gli utenti interagiscono con servizi sostenuti da garanzie reali, non solo da reputazione.

La fiducia non è assunta.

È continuamente applicato attraverso incentivi.

E soprattutto, questi vincoli non generano ritorni passivi, esistono puramente come meccanismi portatori di rischio per allineare il comportamento.

Quella distinzione conta più di quanto sembri.

Quello che sto iniziando a notare è un cambiamento più ampio.

Ci stiamo allontanando dai sistemi che premiano il mantenimento verso sistemi che richiedono responsabilità.

E forse questo è necessario.

Perché man mano che la crypto si avvicina a coordinare sistemi reali robot, infrastrutture, servizi, il costo del disallineamento aumenta.

La sicurezza passiva non scala in ambienti attivi.

Ma la partecipazione supportata dal rischio potrebbe.

All'inizio, il Bacino di Sicurezza sembrava un design tecnico.

Ora sembra più una dichiarazione.

La partecipazione non riguarda quanto bloccate.

Si tratta di quanto responsabilità sei disposto a portare.

Pensavo che la sicurezza derivasse da quanto valore fosse bloccato in un sistema.

Ora penso che derivi da quanto valore si è disposti a perdere quando qualcosa va storto.

Perché alla fine, i sistemi non sono protetti solo dal capitale.

Sono protetti dalle conseguenze ad esso legate.