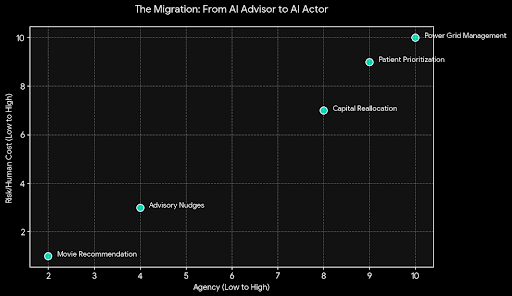

L'IA era usata per stare educatamente sullo sfondo, offrendo suggerimenti e incoraggiamenti. Ora avanza, prende decisioni e in alcuni sistemi, firma il conto. Quella migrazione da consigliere ad attore è urgente, emozionante e silenziosamente terrificante.

Quando un algoritmo raccomanda un film, una scelta sbagliata è solo un fastidio. Quando rialloca capitale, dà priorità a un paziente o reindirizza energia, un singolo errore può espandersi con reali costi umani. Il problema non è l'intelligenza in sé, ma l'azione senza responsabilità verificabile.

Le allucinazioni, la deriva del modello e i trucchi avversari non sono più bug teorici; sono vettori di danno. Un'affermazione che suona sicura da un modello può tradursi direttamente in una transazione, una scarica o un cambiamento di politica se le uscite del sistema vengono date agenzia. Senza un modo per dimostrare cosa è realmente accaduto, "l'IA ha detto così" diventa un pericoloso sostituto per audit e supervisione.

Ecco perché verificare le azioni, non solo i risultati, è importante. Non è sufficiente ispezionare ciò che un sistema ha prodotto su carta. Dobbiamo verificare i cambiamenti di stato: il commercio si è concluso, la prescrizione è stata soddisfatta, la rete si è adattata? Attestazioni verificabili e a prova di manomissione trasformano le affermazioni in prove e la narrazione in verificabilità.

Le reti aperte amplificano il problema della verifica. Quando molti agenti possono presentare richieste, attestazioni a basso costo invitano spam, giochi e falsa fiducia. Uno strato di verifica che è gratuito per tutti sarà sommerso dal rumore e manipolato da coloro che traggono profitto dall'inganno.

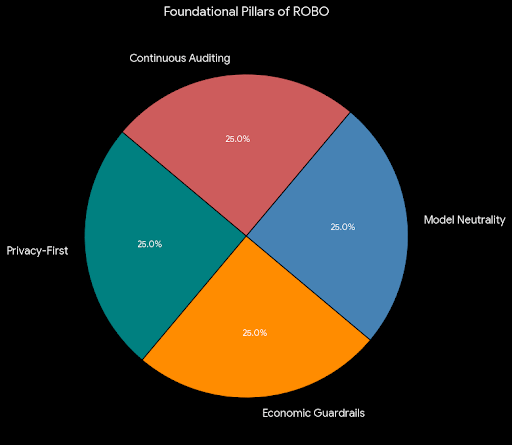

ROBO risponde a questo con garanzie economiche e reputazionali. I validatori impegnano risorse, guadagnano ricompense per attestazioni oneste e affrontano sanzioni per frode. Quando i costi di verifica comportano denaro reale, reputazione o opportunità, il sistema scoraggia le pretese frivole e premia l'accuratezza. Gli incentivi diventano una difesa, non una scappatoia.

La privacy deve essere integrata in qualsiasi schema di responsabilità. La sanità e la finanza sono piene di segreti che non possono essere rivelati per il bene della verifica. Le prove crittografiche che confermano condizioni senza esporre dati sottostanti ci consentono di verificare senza sorvegliare. Puoi dimostrare che una soglia è stata raggiunta senza rivelare l'intero record; puoi confermare la conformità senza pubblicare strategie proprietarie.

La neutralità è un altro fondamento. Uno strato di verifica che favorisce un singolo fornitore o architettura ricrea semplicemente i rischi di concentrazione che speravamo la decentralizzazione evitasse. La verifica delle richieste agnostica al modello rende le attestazioni portabili e componibili. La fiducia viaggia con la prova, non con il fornitore, e i sistemi interoperano piuttosto che bloccarsi a vicenda.

La verifica non è un evento; è una pratica. I sistemi autonomi apprendono, aggiornano e cambiano il loro comportamento. La verifica deve essere continua: attestazioni in streaming, audit rolling e metriche di fiducia dal vivo piuttosto che timbri a punto singolo. Quella visibilità continua rivela le deviazioni, mostra i modelli e rende la fiducia misurabile.

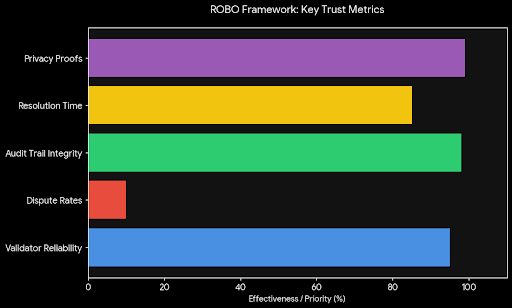

Chiare metriche di fiducia cambiano il modo in cui le organizzazioni si comportano. Invece di affermazioni di marketing su "accuratezza provata", i team mostrano storie: affidabilità dei validatori, tassi di contenzioso, tracce di audit e tempi di risoluzione. Queste metriche rendono la responsabilità verificabile e creano incentivi per migliorare l'affidabilità a lungo termine piuttosto che l'aspetto a breve termine.

La difesa non è mai statica. Poiché gli attori malintenzionati inventano nuovi modi per ingannare, la verifica deve evolversi di conseguenza. Regole adattive, standard guidati dalla comunità e supervisione stratificata da controlli crittografici a revisioni umane quando appropriato rendono più difficile la manipolazione e più veloce la rilevazione.

La verifica decentralizzata alza anche il livello per la disinformazione. In un mondo in cui contenuti sintetici e deepfake sono comuni, le attestazioni crittografiche agiscono come ancore di provenienza. Quando un record è attestato, porta un contesto verificabile; quando non lo è, è giustificato il scetticismo. Quel binario di provabile contro non provato ripristina una misura di igiene epistemica.

Mettere prove verificabili al centro dell'autonomia non significa rinunciare alla velocità o all'innovazione. Significa incorporare la responsabilità nei canali in cui gli agenti effettuano transazioni. Le macchine possono ancora negoziare, ottimizzare e agire; mostrano solo le loro ricevute dopo in un modo che altri agenti e umani possono convalidare.

Questo cambia gli incentivi in tutto l'ecosistema. I fornitori che producono risultati verificabili e auditabili guadagnano fiducia. I regolatori e gli auditor ottengono registri obiettivi. Gli utenti e le istituzioni possono scegliere agenti basandosi su affidabilità dimostrata piuttosto che pubblicità. La responsabilità diventa un segnale di mercato, non solo un campo di conformità.

Il cambiamento più importante è culturale. Passiamo dal trattare l'IA come un oracolo le cui dichiarazioni sono accettate per fede, a trattare l'IA come un attore le cui azioni devono essere provabili. Questo cambiamento riformula le conversazioni sull'autonomia: da "Il modello può farlo?" a "Il modello può dimostrare di averlo fatto?"

L'approccio agnostico al modello, incentrato sulla privacy e allineato economicamente di ROBO, getta le basi per quella transizione culturale. Protegge i dati sensibili, resiste a spam e abusi e rende la fiducia misurabile e portabile. Non garantisce la perfezione, ma crea un sistema in cui i fallimenti sono visibili, responsabili e apprendibili.

Alla fine, la domanda che ci poniamo è semplice e netta. Lasciamo che i sistemi autonomi agiscano per nostro conto senza ricevute, o chiediamo prove e costruiamo un'infrastruttura che lo impone? La scelta determina se l'IA diventa un pericolo non responsabile o una base affidabile.

Dovremmo scegliere una responsabilità provabile. Quando le macchine possono dimostrare in modi crittografici e verificabili cosa hanno fatto e perché, la fiducia smette di essere un salto nel buio e diventa una metrica che possiamo gestire. È così che passiamo da un'affidabilità cieca a un'autonomia responsabile e come assicuriamo che i sistemi potenti servano le persone piuttosto che sorprenderle.