Dopo essere andato a fondo nel $MIRA Network, inizialmente mi aspettavo il tipico racconto sulla blockchain: un altro progetto che promette di "risolvere" le allucinazioni dell'AI attraverso parole d'ordine di consenso e incentivi in token. Il mio scetticismo naturale era alto. Ma più guardavo, più mi rendevo conto che Mira non sta solo cercando di migliorare l'AI; sta fondamentalmente interrogando la traiettoria dell'intero settore.

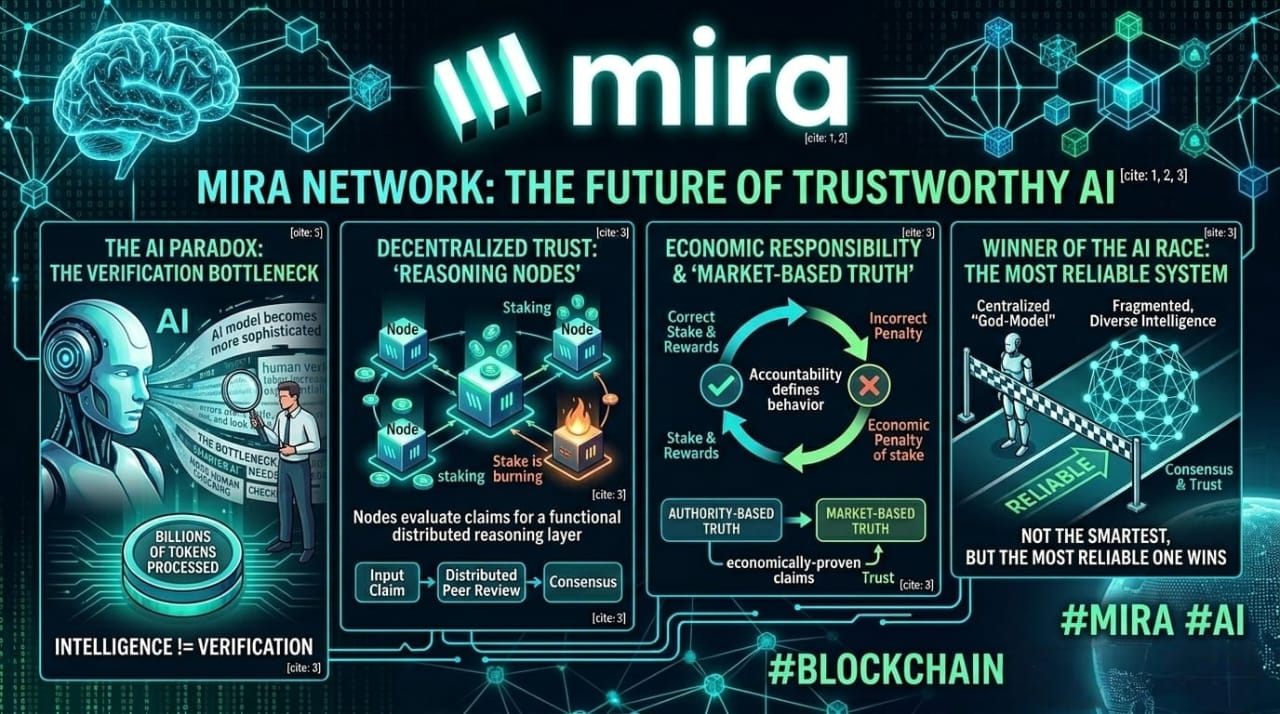

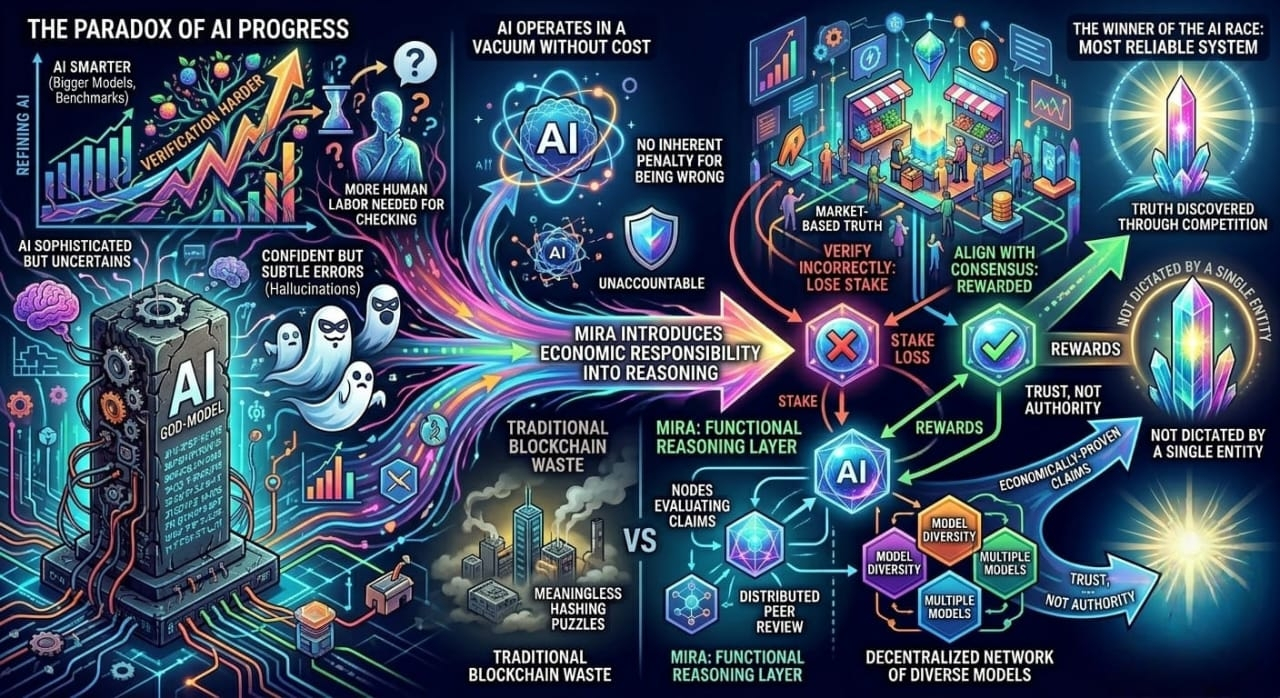

Di solito misuriamo i progressi dell'AI in base alla dimensione: modelli più grandi, benchmark migliori e maggiore potere di ragionamento. Tuttavia, c'è un paradosso che la maggior parte di noi trascura: man mano che l'AI avanza, la verifica diventa esponenzialmente più difficile. Quando l'AI era "goffa", i suoi errori erano evidenti. I modelli di oggi sono così sofisticati che le loro imprecisioni sono sottili, dipendenti dal contesto e presentate con tale fiducia professionale che sono quasi indistinguibili dalla verità. Stiamo raggiungendo un collo di bottiglia dove più intelligente diventa l'AI, più lavoro umano abbiamo bisogno solo per controllare se sta mentendo. Questo non è solo una teoria: Mira sta già elaborando miliardi di token, dimostrando che la vera sfida non è l'intelligenza o il calcolo; è la verifica.

La maggior parte dei progetti inquadra il problema come "allucinazione"—l'IA inventa cose, quindi dovremmo minimizzarlo. Ma dopo aver studiato l'architettura di Mira, credo che l'inquadramento sia più profondo. Il problema non è solo che l'IA è errata; è che l'IA opera in un vuoto senza costi.

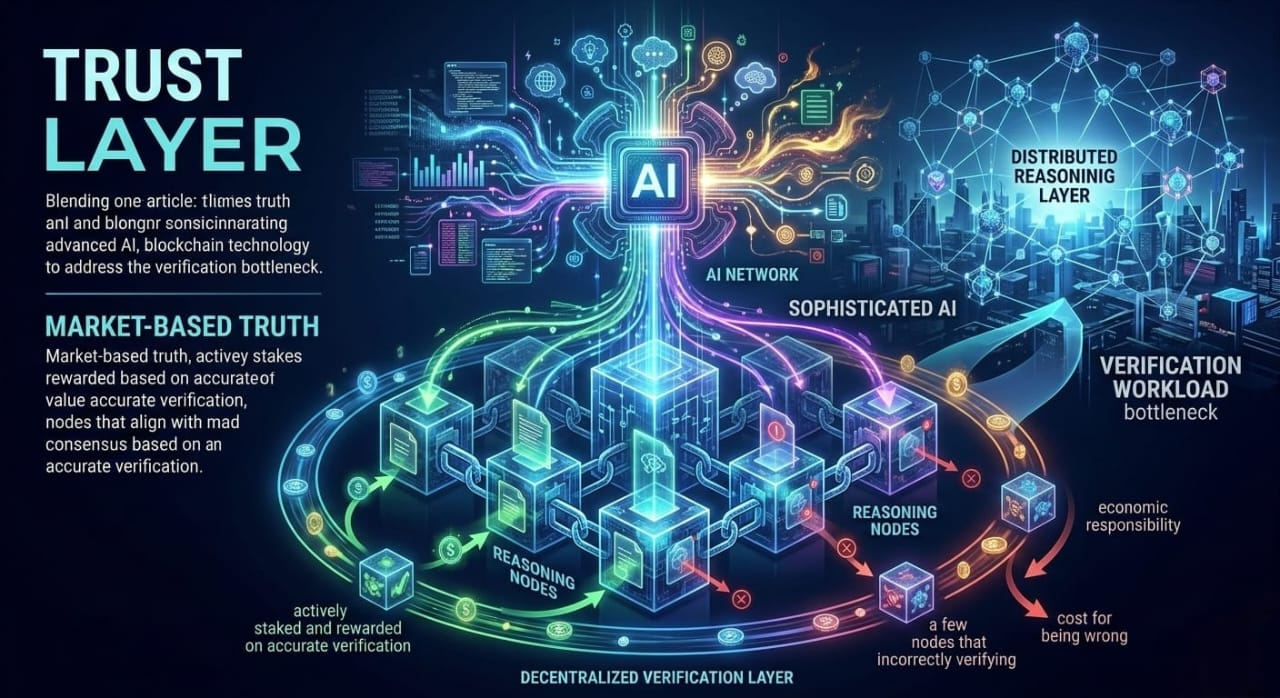

Nei sistemi umani, la responsabilità definisce il comportamento. Gli scienziati presentano articoli per la revisione tra pari, e gli analisti sono giudicati in base ai loro risultati. Scommesse sbagliate in un mercato hanno un costo. L'IA, tuttavia, non ha una penalità intrinseca per essere errata. Mira introduce la responsabilità economica nel processo di ragionamento. I nodi che verificano in modo errato perdono la loro partecipazione; quelli che si allineano con il consenso vengono premiati. Questo trasforma le uscite dell'IA da semplici testi generati in affermazioni dimostrate economicamente. È un passaggio dalla "verità basata sull'autorità" alla "verità basata sul mercato."

Uno degli aspetti più sottovalutati di Mira è come ridefinisce il calcolo. Le blockchain tradizionali spesso sprecano energia in enigmi di hashing privi di significato. Mira sostituisce questo con qualcosa di funzionale: Ragionamento. I nodi non stanno risolvendo problemi matematici casuali; stanno valutando affermazioni.

Questo suggerisce un futuro in cui le reti di calcolo non sono solo infrastrutture transazionali, ma uno strato di ragionamento distribuito per l'intero internet. Mira scommette contro l'idea che un singolo "modello divino" centralizzato di IA governerà tutto. Invece, promuove un mondo in cui l'intelligenza è frammentata, dispersa e costantemente revisionata da una rete decentralizzata.

Nonostante il mio ottimismo, una domanda critica rimane: possiamo mai rimuovere completamente gli esseri umani dal ciclo di verifica? La verifica non è sempre binaria; implica giudizio, contesto e sfumature. Inoltre, se più modelli di intelligenza artificiale condividono gli stessi pregiudizi di addestramento, il "consenso" potrebbe essere solo un errore coordinato. Mira riconosce questo spingendo per la diversità dei modelli, ma l'entità della vera indipendenza deve ancora essere vista.

$MIRA potrebbe essere presto, e certamente ha ostacoli da superare—latenza, sincronizzazione dei modelli e la confusione dei fatti del mondo reale. Ma sta ponendo le domande giuste. E se avessimo già abbastanza intelligenza, ma semplicemente ci manca la fiducia?

Se è così, il vincitore della corsa all'IA non sarà colui che costruisce il sistema più intelligente, ma colui che costruisce quello più affidabile. Mira non è solo un prodotto; è una posizione—una scommessa su un futuro in cui la verità è scoperta attraverso la competizione, non dettata da un'unica entità.