Titolo originale: "Da GPT-1 a GPT-4, guarda l'ascesa di ChatGPT"

Autore originale: Alpha Rabbit Research Notes

Cos'è ChatGPT?

Cos'è ChatGPT?

Recentemente OpenAI ha rilasciato ChatGPT, un modello in grado di interagire in modo conversazionale che, grazie alla sua intelligenza, è stato accolto favorevolmente da molti utenti. ChatGPT è anche un parente di InstructGPT precedentemente rilasciato da OpenAI. Il modello ChatGPT viene addestrato utilizzando RLHF (Reinforcement learning with human feedback). Forse l'arrivo di ChatGPT è anche il preludio prima del lancio ufficiale di GPT-4 di OpenAI.

Cos'è GPT? Da GPT-1 a GPT-3

Generative Pre-trained Transformer (GPT) è un modello di deep learning per la generazione di testo addestrato sui dati disponibili su Internet. Viene utilizzato per la risposta alle domande, il riepilogo del testo, la traduzione automatica, la classificazione, la generazione di codice e l'intelligenza artificiale conversazionale.

Nel 2018 è nato GPT-1, che è stato anche il primo anno di modelli di pre-formazione per la PNL (elaborazione del linguaggio naturale). In termini di prestazioni, GPT-1 ha una certa capacità di generalizzazione e può essere utilizzato in compiti di PNL che non hanno nulla a che fare con compiti di supervisione. Le attività comuni includono:

Ragionamento in linguaggio naturale: determinare la relazione tra due frasi (contenimento, contraddizione, neutralità)

Domande e risposte e ragionamento basato sul buon senso: inserisci un articolo e diverse risposte e fornisci l'accuratezza della risposta

Riconoscimento della somiglianza semantica: determina se due frasi sono semanticamente correlate

Categoria: determina a quale categoria appartiene il testo immesso

Sebbene GPT-1 abbia alcuni effetti su compiti non ottimizzati, la sua capacità di generalizzazione è molto inferiore a quella dei compiti supervisionati ottimizzati, pertanto GPT-1 può essere considerato solo uno strumento di comprensione del linguaggio abbastanza buono piuttosto che uno strumento conversazionale.

Anche GPT-2 è arrivato come previsto nel 2019. Tuttavia, GPT-2 non ha apportato molte innovazioni strutturali e progettazioni sulla rete originale, ha utilizzato solo più parametri di rete e un set di dati più ampio: il modello massimo totale ha 48 livelli e 1,5 miliardi di parametri.L'obiettivo di apprendimento utilizza un modello di pre-formazione non supervisionato per eseguire compiti supervisionati. In termini di prestazioni, oltre alle capacità di comprensione, GPT-2 ha mostrato per la prima volta un forte talento nella generazione: leggere riassunti, chattare, continuare a scrivere, inventare storie e persino generare notizie false, email di phishing o giochi di ruolo. online. Non è un problema. Dopo essere "diventato più grande", GPT-2 ha dimostrato le sue capacità universali e potenti e ha ottenuto le migliori prestazioni dell'epoca su molteplici attività di modellazione linguistica specifica.

Successivamente è apparso GPT-3. Come modello non supervisionato (ora spesso chiamato modello auto-supervisionato), può quasi completare la maggior parte dei compiti di elaborazione del linguaggio naturale, come la ricerca orientata ai problemi, la comprensione della lettura, l'inferenza semantica e la traduzione automatica. ., generazione di articoli e domande e risposte automatiche, ecc. Inoltre, il modello funziona bene in molti compiti, come raggiungere l’attuale livello di avanguardia nelle attività di traduzione automatica francese-inglese e tedesco-inglese. Gli articoli generati automaticamente sono quasi impossibili da distinguere tra esseri umani e macchine (solo (tasso di precisione del 52%) , paragonabile all'ipotesi casuale), e ciò che è ancora più sorprendente è che raggiunge una precisione quasi del 100% su attività di addizione e sottrazione a due cifre e può persino generare automaticamente codice in base alla descrizione dell'attività. Un modello non supervisionato ha molte funzioni e buoni effetti e sembra che le persone vedano la speranza nell’intelligenza artificiale generale, e questo potrebbe essere il motivo principale per cui GPT-3 ha un così grande impatto.

Cos'è esattamente il modello GPT-3?

In effetti, GPT-3 è un semplice modello di linguaggio statistico. Dal punto di vista dell’apprendimento automatico, i modelli linguistici modellano la distribuzione di probabilità delle sequenze di parole, utilizzando cioè i frammenti che sono stati pronunciati come condizioni per prevedere la distribuzione di probabilità delle diverse parole che appariranno nel momento successivo. Da un lato, il modello linguistico può misurare il grado di conformità di una frase alla grammatica della lingua (ad esempio, misurare se la risposta generata automaticamente dal sistema di dialogo uomo-computer è naturale e fluente), e può anche essere utilizzato prevedere e generare nuove frasi. Ad esempio, per una clip "Sono le 12, andiamo insieme al ristorante", il modello linguistico può prevedere le parole che potrebbero apparire dopo "ristorante". Un modello linguistico generale prevede che la parola successiva sarà "mangia". Un modello linguistico potente può acquisire le informazioni temporali e prevedere la parola "mangia pranzo" adatta al contesto.

Di solito, se un modello linguistico è potente dipende principalmente da due punti: in primo luogo, se il modello può utilizzare tutte le informazioni del contesto storico. Nell'esempio precedente, se non può catturare le informazioni semantiche a lungo raggio di "12 mezzogiorno", il modello linguistico sarà quasi incapace di prevedere la prossima volta.Una sola parola "pranzare". In secondo luogo, dipende anche se esiste un contesto storico sufficientemente ricco da consentire l'apprendimento del modello, vale a dire se il corpus di formazione è sufficientemente ricco. Poiché il modello linguistico è un apprendimento autosuperato, l'obiettivo di ottimizzazione è massimizzare la probabilità del modello linguistico del testo visto, in modo che qualsiasi testo possa essere utilizzato come dati di addestramento senza etichettatura.

Grazie alle prestazioni più elevate di GPT-3 e al numero significativamente maggiore di parametri, contiene più testo degli argomenti, il che è ovviamente migliore rispetto alla generazione precedente GPT-2. Essendo la più grande rete neurale densa attualmente disponibile, GPT-3 può convertire le descrizioni delle pagine web in codici corrispondenti, imitare le narrazioni umane, creare poesie personalizzate, generare script di giochi e persino imitare filosofi defunti, prevedendo il vero significato della vita. E GPT-3 non richiede messa a punto, richiede solo alcuni campioni del tipo di output (una piccola quantità di apprendimento) per affrontare difficili problemi grammaticali. Si può dire che GPT-3 sembra aver soddisfatto tutta la nostra fantasia di esperti linguistici.

Nota: Quanto sopra si riferisce principalmente ai seguenti articoli:

1. GPT 4 sta per essere rilasciato ed è paragonabile al cervello umano, molti grandi player del settore non riescono a stare fermi! -Xu Jiecheng, Yun Zhao -Account pubblico 51 CTO Technology Stack-2022-11-24 18:08

2. Rispondi alla tua curiosità su GPT-3 in un articolo! Cos'è GPT-3? Perché è così eccellente? -Zhang Jiajun Institute of Automation, Accademia cinese delle scienze Pubblicato a Pechino il 2020-11-11 17:25

3.Il lotto: 329 | InstructGPT, un modello linguistico-account pubblico più amichevole e gentile DeeplearningAI-2022-02-07 12:30

Quali sono i problemi con GPT-3?

Ma GTP-3 non è perfetto. Uno dei problemi principali che preoccupano di più gli utenti dell'intelligenza artificiale è che i chatbot e gli strumenti di generazione di testi possono apprendere tutti i testi su Internet in modo indiscriminato e di qualità. A loro volta, in modo errato, maliziosamente offensivo, o addirittura viene prodotto un linguaggio offensivo, che influenzerà completamente la loro prossima applicazione.

OpenAI ha anche proposto che nel prossimo futuro venga rilasciato un GPT-4 più potente:

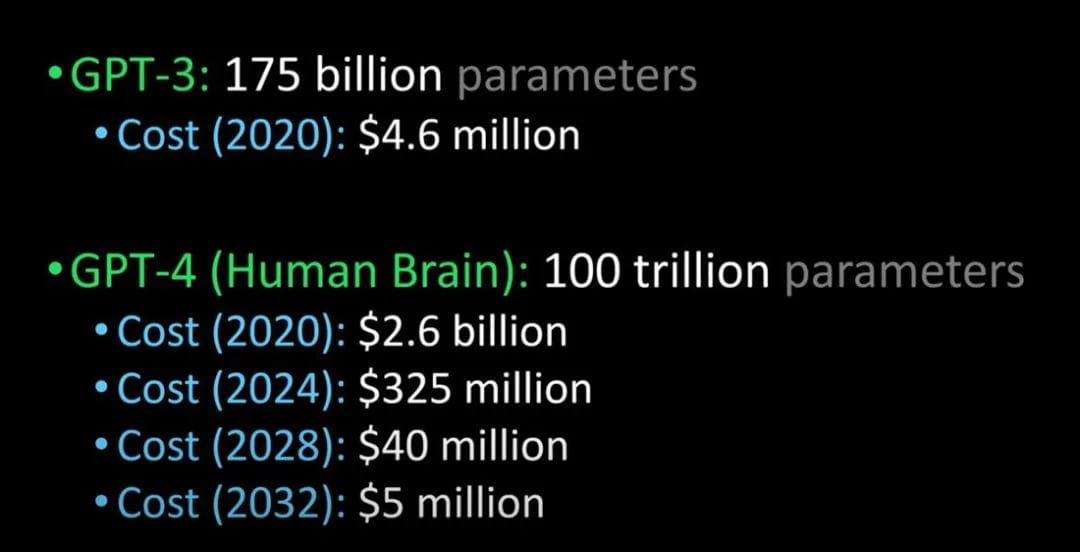

Confronto tra GPT-3 e GPT-4 e il cervello umano (Credito immagine: Lex Fridman @youtube)

Si dice che GPT-4 verrà rilasciato l'anno prossimo. Può superare il test di Turing ed essere così avanzato da essere indistinguibile dall'uomo. Inoltre, anche il costo per l'introduzione di GPT-4 per le aziende sarà notevolmente ridotto.

ChatGP e InstructGPT

ChatGPT e InstructGPT

Quando si parla di Chatgpt, dobbiamo parlare del suo "predecessore" InstructGPT.

All'inizio del 2022, OpenAI ha rilasciato InstructGPT; in questa ricerca, rispetto a GPT-3, OpenAI ha utilizzato la ricerca di allineamento per addestrare un modello linguistico che è più realistico, più innocuo e segue meglio le intenzioni dell'utente. versione di GPT-3 che riduce al minimo l'output dannoso, irrealistico e distorto.

Come funziona InstructGPT?

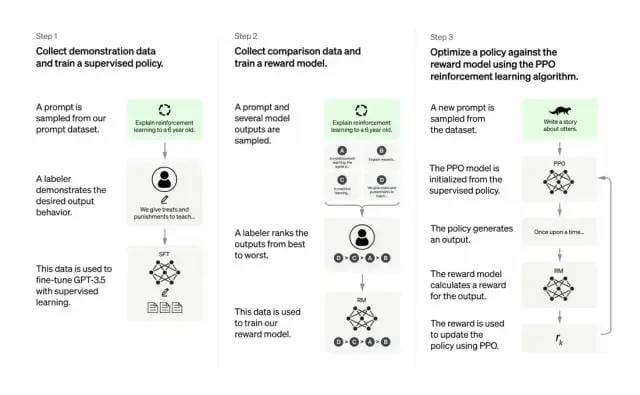

Gli sviluppatori lo fanno combinando apprendimento supervisionato + apprendimento di rinforzo dal feedback umano. Per migliorare la qualità dell'output di GPT-3. In questo tipo di apprendimento, gli esseri umani classificano i potenziali risultati di un modello; gli algoritmi di apprendimento per rinforzo premiano i modelli che producono materiale simile all’output di alto livello.

Il set di dati di addestramento inizia creando suggerimenti, alcuni dei quali sono basati sull'input degli utenti GPT-3, come "Raccontami una storia su una rana" o "Spiega lo sbarco sulla Luna a un bambino di 6 anni in poche frasi". "

Gli sviluppatori hanno diviso il messaggio in tre parti e hanno creato risposte diverse per ciascuna parte:

Gli scrittori umani rispondono alla prima serie di suggerimenti. Gli sviluppatori hanno messo a punto un GPT-3 addestrato e lo hanno trasformato in InstructGPT per generare risposte esistenti per ciascun prompt.

Il passo successivo è addestrare un modello per premiare le risposte migliori con ricompense più elevate. Per la seconda serie di prompt, il modello ottimizzato genera più risposte. I valutatori umani classificano ciascuna risposta. Dato un prompt e due risposte, un modello di ricompensa (un altro GPT-3 pre-addestrato) ha imparato a calcolare una ricompensa più alta per la risposta con punteggio elevato e una ricompensa inferiore per la risposta con punteggio basso.

Gli sviluppatori hanno ulteriormente perfezionato il modello linguistico utilizzando una terza serie di suggerimenti e il metodo di apprendimento per rinforzo Proximal Policy Optimization (PPO). Quando viene fornito un prompt, il modello linguistico genera una risposta e il modello di ricompensa la premia di conseguenza. PPO utilizza i premi per aggiornare il modello linguistico.

Riferimento per questo paragrafo: The Batch: 329 | InstructGPT, un modello linguistico più amichevole e gentile-account pubblico DeeplearningAI- 2022-02-07 12:30

Cosa è importante? Il nocciolo della questione è che l’intelligenza artificiale deve essere un’intelligenza artificiale responsabile

Il modello linguistico di OpenAI può aiutare nei campi dell'istruzione, dei terapisti virtuali, degli ausili per la scrittura, dei giochi di ruolo, ecc. In questi campi, l'esistenza di pregiudizi sociali, disinformazione e informazioni tossiche è più problematica e i sistemi che possono evitare questi difetti possono essere più capace Utilità.

Quali sono le differenze tra i processi di formazione di Chatgpt e InstructGPT?

In generale, Chatgpt, come InstructGPT sopra, viene addestrato utilizzando RLHF (Reinforcement Learning from Human Feedback). La differenza sta nel modo in cui i dati vengono impostati per l'addestramento (e raccolti). (Spiegazione qui: il precedente modello InstructGPT forniva un output per un input e poi lo confrontava con i dati di addestramento. Sì, c'erano premi e non penalità; l'attuale Chatgpt è un input e il modello fornisce più output, quindi le persone dare Questo ordinamento dei risultati di output consente al modello di classificare questi risultati da "più simili a quelli umani" a "senza senso", consentendo al modello di apprendere il modo in cui gli esseri umani ordinano. Questa strategia è chiamata apprendimento supervisionato. Grazie al Dr. Zhang Zijie per questo paragrafo)

Quali sono i limiti di ChatGPT?

come segue:

a) Durante la fase di formazione dell'apprendimento per rinforzo (RL), non esiste una fonte specifica di verità e risposte standard alle tue domande.

b) Il modello è addestrato a essere più cauto e può rifiutare le risposte (per evitare falsi positivi delle richieste).

c) La formazione supervisionata può indurre in errore/distorcere il modello verso la conoscenza della risposta ideale, piuttosto che il modello generi un insieme casuale di risposte e solo i revisori umani scelgano le risposte buone/migliori

Nota: ChatGPT è sensibile alle parole. , a volte il modello finisce per non rispondere a una frase, ma con una leggera modifica alla domanda/frase, finisce per rispondere correttamente. I formatori tendono a preferire risposte più lunghe perché potrebbero sembrare più complete, portando a una tendenza a risposte più lunghe e all'uso eccessivo di alcune frasi nel modello. Se il suggerimento o la domanda iniziale sono ambigui, il modello non chiederà chiarimenti in modo appropriato.

Le limitazioni autoidentificate di ChatGPT sono le seguenti.

Risposte apparentemente plausibili ma errate:

a) Non esiste una vera fonte di verità per risolvere questo problema durante la fase di formazione di Reinforcement Learning (RL).

b) Il modello formativo per essere più cauto può erroneamente rifiutarsi di rispondere (falso positivo di suggerimenti fastidiosi).

c) La formazione supervisionata può fuorviare/distorcere il modello tende a conoscere la risposta ideale piuttosto che il modello che genera una serie casuale di risposte e solo i revisori umani che selezionano una risposta buona/altamente classificataChatGPT è sensibile alla fraseologia. A volte il modello finisce per non ottenere alcuna risposta per una frase, ma con una leggera modifica alla domanda/frase, finisce per rispondere correttamente.

I formatori preferiscono risposte più lunghe che potrebbero sembrare più complete, il che porta a una propensione verso risposte dettagliate e all'uso eccessivo di determinate frasi. Il modello non chiede in modo appropriato chiarimenti se la richiesta o la domanda iniziale è ambigua. Un livello di sicurezza per rifiutare richieste inappropriate tramite l'API di moderazione è stato implementato. Tuttavia, possiamo ancora aspettarci risposte false negative e positive.

Riferimenti:

1.https://medium.com/inkwater-atlas/chatgpt-the-new-frontier-of-artificial-intelligence-9 aee 81287677

2.https://pub.towardsai.net/openai-debuts-chatgpt-50 dd 611278 a 4

3.https://openai.com/blog/chatgpt/

4. GPT 4 sta per essere rilasciato ed è paragonabile al cervello umano, molti grandi player del settore non riescono a stare fermi! -Xu Jiecheng, Yun Zhao -Account pubblico 51 CTO Technology Stack-2022-11-24 18:08

5. Rispondi alla tua curiosità su GPT-3 in un articolo! Cos'è GPT-3? Perché è così eccellente? -Zhang Jiajun Institute of Automation, Accademia cinese delle scienze Pubblicato a Pechino il 11-11-2020 alle 17:25

6.Il lotto: 329 | InstructGPT, un modello linguistico-account pubblico più amichevole e gentile DeeplearningAI-2022-02-07 12:30