Meta ha presentado Segment Anything, su nuevo modelo básico para la segmentación de imágenes. El proceso de identificar qué píxeles de la imagen pertenecen a un objeto es una tarea crucial en la visión por computadora y se utiliza en una variedad de aplicaciones, desde el análisis de imágenes científicas hasta la edición de fotografías.

En su publicación introductoria del blog, la compañía preparó el escenario diciendo que la creación de modelos de segmentación precisos para tareas específicas en visión por computadora generalmente ha requerido trabajo especializado por parte de expertos técnicos con acceso a infraestructura de capacitación en IA y grandes volúmenes de datos en el dominio cuidadosamente anotados.

Sin embargo, esto podría cambiar pronto con el proyecto Segment Anything, ya que se espera que su nuevo conjunto de datos y modelo hagan que los modelos de segmentación precisos sean más accesibles para una audiencia más amplia, eliminando la necesidad de infraestructura y conocimientos técnicos especializados. Para lograrlo, los investigadores construyeron un modelo de indicaciones que se entrena con diversos datos y puede adaptarse a tareas específicas, de manera similar a cómo se utilizan las indicaciones en los modelos de procesamiento del lenguaje natural o chatbots.

Para democratizar aún más la segmentación, Meta está poniendo a disposición el enorme conjunto de datos SA-1B para fines de investigación, y el modelo Segment Anything está disponible bajo una licencia abierta permisiva (Apache 2.0). Además, la empresa ha desarrollado una demostración que permite a los usuarios probar SAM con sus propias imágenes.

Meta ve casos de uso potenciales para SAM en los dominios de IA, AR/VR y creadores. SAM tiene el potencial de convertirse en un elemento crítico en sistemas de IA más grandes que apuntan a lograr una comprensión multimodal más general del mundo. Por ejemplo, puede facilitar la comprensión del contenido tanto visual como textual de una página web.

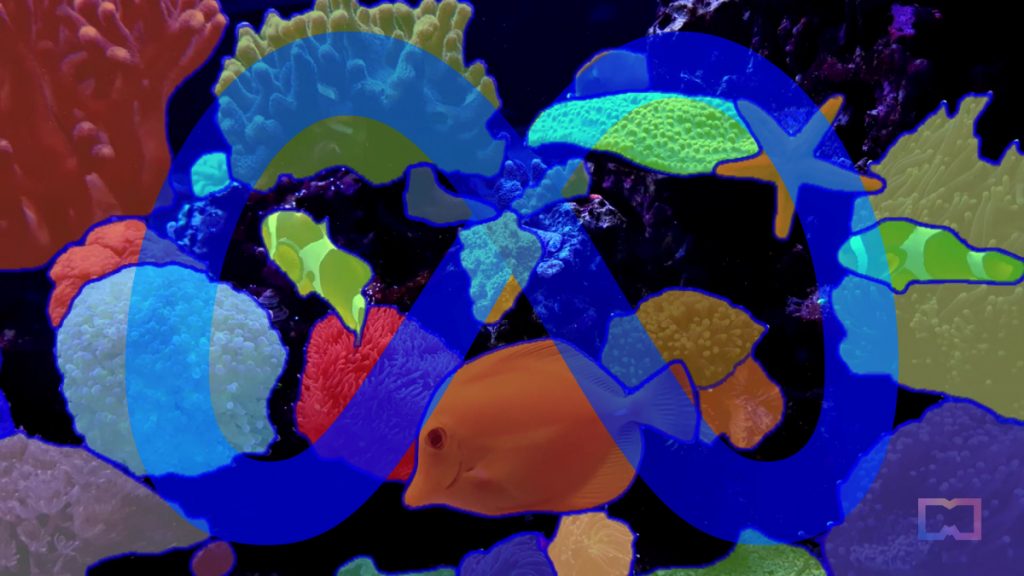

Además, en el dominio AR/VR, SAM podría permitir la selección de objetos según la mirada del usuario y permitir que el objeto se "levante" a 3D. Además, los creadores de contenido pueden utilizar SAM para mejorar aplicaciones creativas, como extraer regiones de imágenes para collages o edición de videos.

Meta ha estado intensificando sus esfuerzos en materia de IA en medio del auge de la IA generativa y el menguante interés en el metaverso. A pesar de la apuesta de 70 mil millones de dólares de la compañía en el metaverso, su división de metaverso, Reality Labs, experimentó una pérdida de 13,7 mil millones de dólares el año pasado. Recientemente, Meta también suspendió sus operaciones NFT en Facebook e Instagram.

En una entrevista con Nikkei Asia el miércoles, el CTO de Meta, Chris Bosworth, dijo que los altos ejecutivos de Meta han pasado la mayor parte de su tiempo en IA. El director ejecutivo de Meta, Mark Zuckerberg, anunció en febrero un nuevo grupo de productos centrado en la IA generativa después de lanzar su nuevo modelo de lenguaje grande llamado LLaMA (Large Language Model Meta AI).

Se espera que la compañía presente algunas aplicaciones de inteligencia artificial para la creación de anuncios este año, dijo Bosworth a Nikkei.

Leer más:

Square Enix planea expansión para hacer crecer la estrategia Metaverse

Samsung Latam ingresa al metaverso con “House of Sam” en Decentraland

Meta: los usuarios ahora pueden realizar publicaciones cruzadas de NFT en Instagram y Facebook

La CFTC revela nuevos cargos contra Sam Bankman-Fried, FTX y Alameda

El CEO de OpenAI afirma que el sistema educativo debería adaptarse a ChatGPT, no prohibirlo

La publicación Meta presenta Segment Anything, su nuevo modelo de inteligencia artificial para la segmentación de imágenes apareció por primera vez en Metaverse Post.