Se acaba de lanzar la versión de código abierto del modelo Flamingo de DeepMind, OpenFlamingo. OpenFlamingo es fundamentalmente un marco que permite la capacitación y evaluación de modelos multimodales (LMM) de gran tamaño. OpenFlamingo se basa en el modelo de lenguaje grande LLaMA desarrollado por Meta AI.

Leer más: Cómo utilizar Midjourney gratis para siempre: 5 sencillos pasos

Leer más: Cómo utilizar Midjourney gratis para siempre: 5 sencillos pasos

Las contribuciones de los desarrolladores a esta primera versión son las siguientes:

Un conjunto de datos multimodal considerable que combina texto y secuencias visuales.

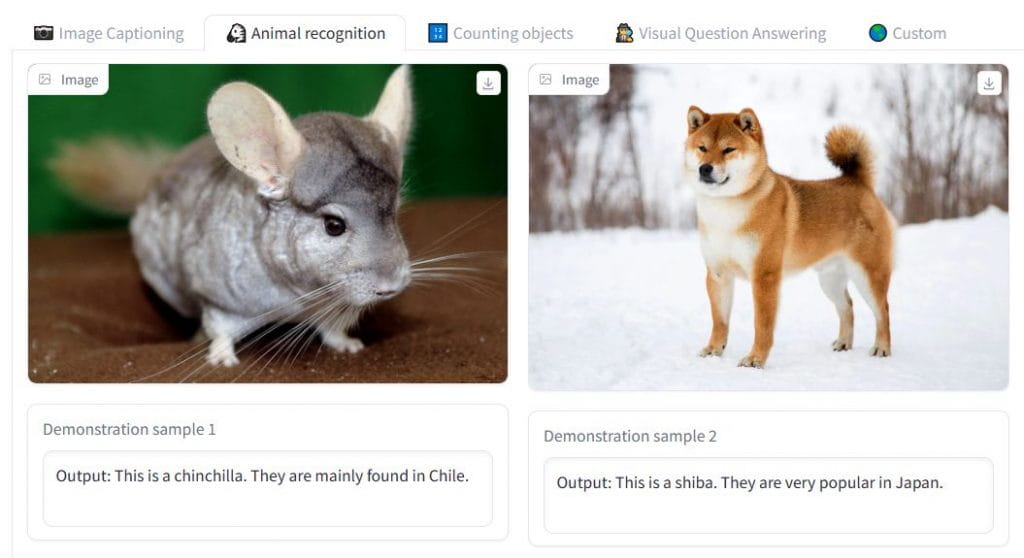

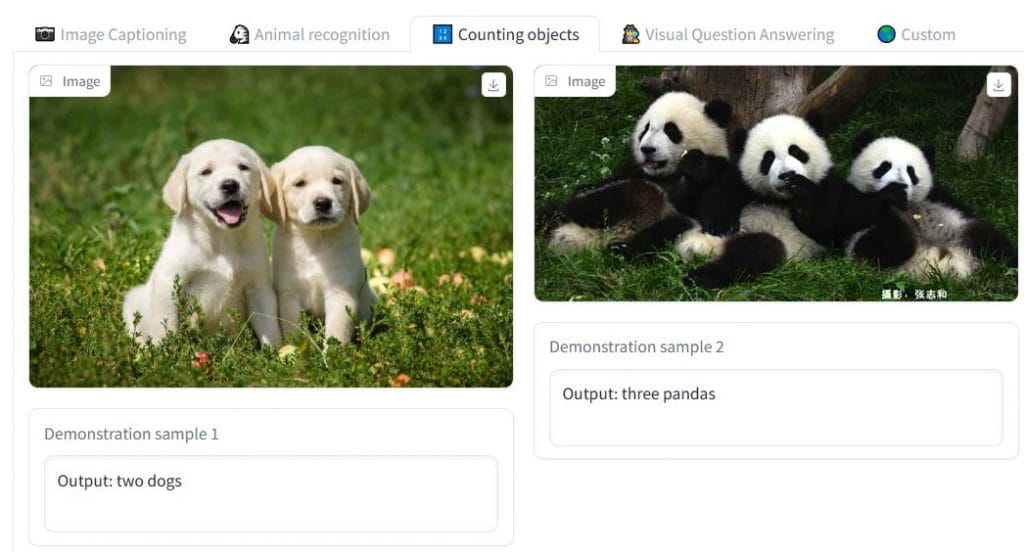

Un punto de referencia para la evaluación del aprendizaje en contexto para actividades que incluyen la visión y el lenguaje.

Una versión preliminar de nuestro modelo OpenFlamingo-9B basado en LLaMA.

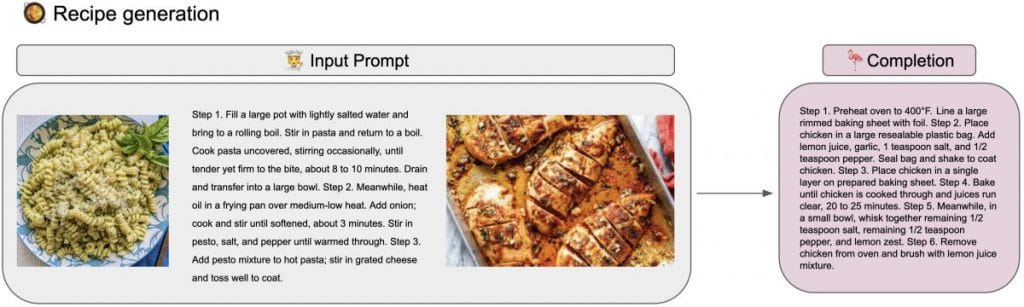

A través de OpenFlamingo, los desarrolladores esperan crear un sistema multimodal que pueda manejar una variedad de desafíos de visión y lenguaje. El objetivo final es igualar la fuerza y adaptabilidad de GPT-4 en el manejo de entrada visual y de texto. Para lograr este objetivo, los desarrolladores están desarrollando una versión de código abierto del modelo Flamingo de DeepMind, un LMM capaz de procesar y razonar sobre imágenes, videos y texto. Los desarrolladores se dedican a desarrollar modelos totalmente de código abierto porque creen que la transparencia es crucial para promover la cooperación, acelerar el desarrollo y democratizar el acceso a LMM de vanguardia.

Están proporcionando el punto de control inicial de nuestro modelo OpenFlamingo-9B. Aunque el modelo aún no está completamente optimizado, muestra la promesa del proyecto. Los desarrolladores pueden formar mejores LMM cooperando y obteniendo comentarios de la comunidad. Invitan al público a dar su opinión y agregar contenido al repositorio para participar en el proceso de desarrollo.

La implementación se parece mucho a la de Flamingo. Los modelos de Flamingo deben entrenarse en conjuntos de datos web a gran escala con texto y gráficos intercalados para equiparlos con habilidades de aprendizaje de pocas tomas en contexto. La misma arquitectura que se sugirió en el estudio original de Flamingo (resamplers de Perceiver, capas de atención cruzada) se implementa en OpenFlamingo. Pero, dado que los datos de entrenamiento de Flamingo no son accesibles al público en general, los desarrolladores utilizan conjuntos de datos de código abierto para entrenar modelos. El punto de control OpenFlamingo-9B recientemente publicado se entrenó específicamente en muestras de 10 millones de LAION-2B y muestras de 5 millones del nuevo conjunto de datos Multimodal C4.

Los desarrolladores también incluyen un punto de control de nuestro LMM OpenFlamingo-9B inacabado, que se basa en LLaMA 7B y CLIP ViT/L-14, como parte del lanzamiento. Aunque este concepto aún se está desarrollando, es posible que la comunidad ya se beneficie enormemente de él.

Para comenzar, consulte la fuente y la demostración de GitHub.

Lea más sobre la IA:

Se espera que los costos de capacitación de modelos de IA aumenten de $100 millones a $500 millones para 2030

Ada, el nuevo agente de IA adaptativo de DeepMind, es casi tan inteligente como un humano

DeepMind lanzó la herramienta de inteligencia artificial Dramatron, que genera un borrador completo del guión de una película o programa de televisión.

La publicación OpenFlamingo: un nuevo marco de imagen a texto de código abierto de Meta AI y LAION apareció por primera vez en Metaverse Post.