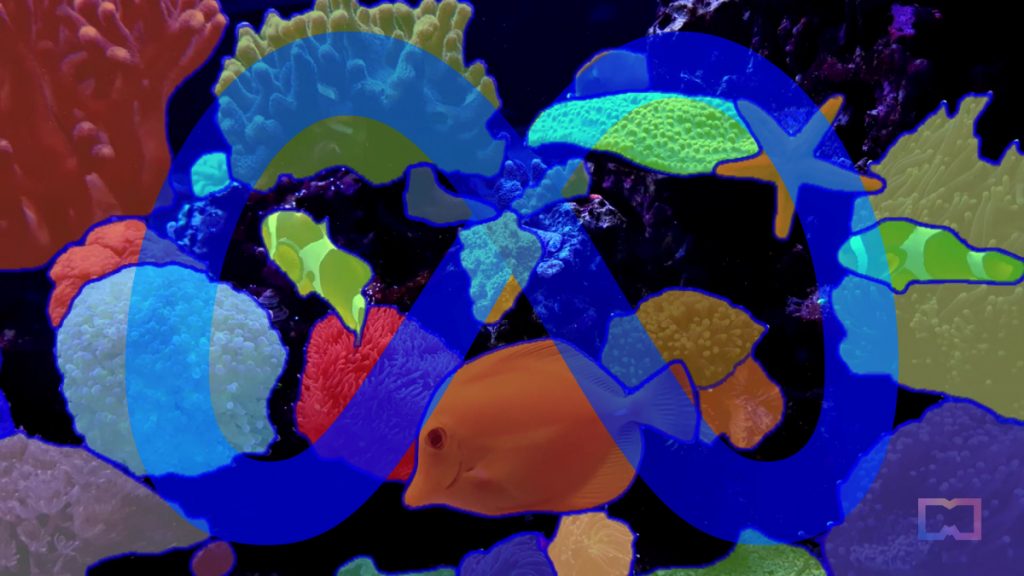

Meta hat Segment Anything vorgestellt, sein neues Basismodell für die Bildsegmentierung. Der Prozess der Identifizierung, welche Bildpixel zu einem Objekt gehören, ist eine entscheidende Aufgabe in der Computervision und wird in einer Vielzahl von Anwendungen eingesetzt, von der Analyse wissenschaftlicher Bilder bis zur Fotobearbeitung.

In seinem einführenden Blogbeitrag stellte das Unternehmen die Weichen mit der Aussage, dass die Erstellung präziser Segmentierungsmodelle für bestimmte Aufgaben der Computer Vision normalerweise die Spezialarbeit von technischen Experten mit Zugriff auf eine KI-Trainingsinfrastruktur und große Mengen sorgfältig annotierter domänenbezogener Daten erfordere.

Dies könnte sich jedoch mit dem Segment Anything-Projekt bald ändern, da der neue Datensatz und das neue Modell genaue Segmentierungsmodelle einem breiteren Publikum zugänglich machen sollen, sodass kein spezielles technisches Fachwissen und keine spezielle Infrastruktur mehr erforderlich sind. Um dies zu erreichen, haben die Forscher ein aufforderungsfähiges Modell erstellt, das anhand unterschiedlicher Daten trainiert wird und sich an bestimmte Aufgaben anpassen kann, ähnlich wie Eingabeaufforderungen in Modellen zur Verarbeitung natürlicher Sprache oder Chatbots verwendet werden.

Um die Segmentierung weiter zu demokratisieren, stellt Meta den riesigen SA-1B-Datensatz für Forschungszwecke zur Verfügung und das Segment Anything-Modell ist unter einer freizügigen offenen Lizenz (Apache 2.0) erhältlich. Darüber hinaus hat das Unternehmen eine Demo entwickelt, mit der Benutzer SAM mit ihren eigenen Bildern ausprobieren können.

Meta sieht potenzielle Anwendungsfälle für SAM in den Bereichen KI, AR/VR und Creator. SAM hat das Potenzial, ein entscheidendes Element in größeren KI-Systemen zu werden, die ein allgemeineres multimodales Verständnis der Welt anstreben. So kann es beispielsweise das Verständnis sowohl visueller als auch textlicher Inhalte auf einer Webseite erleichtern.

Darüber hinaus könnte SAM im AR/VR-Bereich die Objektauswahl basierend auf dem Blick des Benutzers ermöglichen und das Objekt in 3D „anheben“. Darüber hinaus können Inhaltsersteller SAM verwenden, um kreative Anwendungen zu verbessern, beispielsweise das Extrahieren von Bildbereichen für Collagen oder die Videobearbeitung.

Meta hat seine KI-Bemühungen inmitten des Booms der generativen KI und des schwindenden Interesses am Metaverse verstärkt. Trotz der 70-Milliarden-Dollar-Wette des Unternehmens auf das Metaverse verzeichnete seine Metaverse-Abteilung Reality Labs im vergangenen Jahr einen Verlust von 13,7 Milliarden US-Dollar. Vor kurzem hat Meta auch seine NFT-Aktivitäten auf Facebook und Instagram eingestellt.

In einem Interview mit Nikkei Asia am Mittwoch sagte Meta-CTO Chris Bosworth, dass die Top-Führungskräfte von Meta die meiste Zeit mit KI verbringen. Meta-CEO Mark Zuckerberg kündigte im Februar eine neue Produktgruppe an, die sich auf generative KI konzentriert, nachdem er sein neues großes Sprachmodell namens LLaMA (Large Language Model Meta AI) veröffentlicht hatte.

Das Unternehmen werde voraussichtlich in diesem Jahr einige KI-Anwendungen zur Anzeigenerstellung auf den Markt bringen, sagte Bosworth gegenüber Nikkei.

Mehr lesen:

Square Enix plant Expansion zur Weiterentwicklung der Metaverse-Strategie

Samsung Latam betritt mit „House of Sam“ in Decentraland das Metaversum

Meta: Benutzer können NFTs jetzt auf Instagram und Facebook kreuzposten

CFTC erhebt neue Anklage gegen Sam Bankman-Fried, FTX und Alameda

Der CEO von OpenAI erklärt, dass das Bildungssystem sich an ChatGPT anpassen und es nicht verbieten sollte

Der Beitrag „Meta stellt Segment Anything vor, sein neues KI-Modell zur Bildsegmentierung“ erschien zuerst auf Metaverse Post.