Die Open-Source-Version von DeepMinds Flamingo-Modell, OpenFlamingo, wurde gerade veröffentlicht. OpenFlamingo ist im Wesentlichen ein Framework, das das Training und die Bewertung großer multimodaler Modelle (LMMs) ermöglicht. OpenFlamingo basiert auf dem von Meta AI entwickelten großen Sprachmodell LLaMA.

Weiterlesen: So nutzen Sie Midjourney für immer kostenlos: 5 einfache Schritte

Weiterlesen: So nutzen Sie Midjourney für immer kostenlos: 5 einfache Schritte

Die Beiträge der Entwickler zu dieser ersten Version lauten wie folgt:

Ein umfangreicher multimodaler Datensatz, der Text- und Bildsequenzen kombiniert.

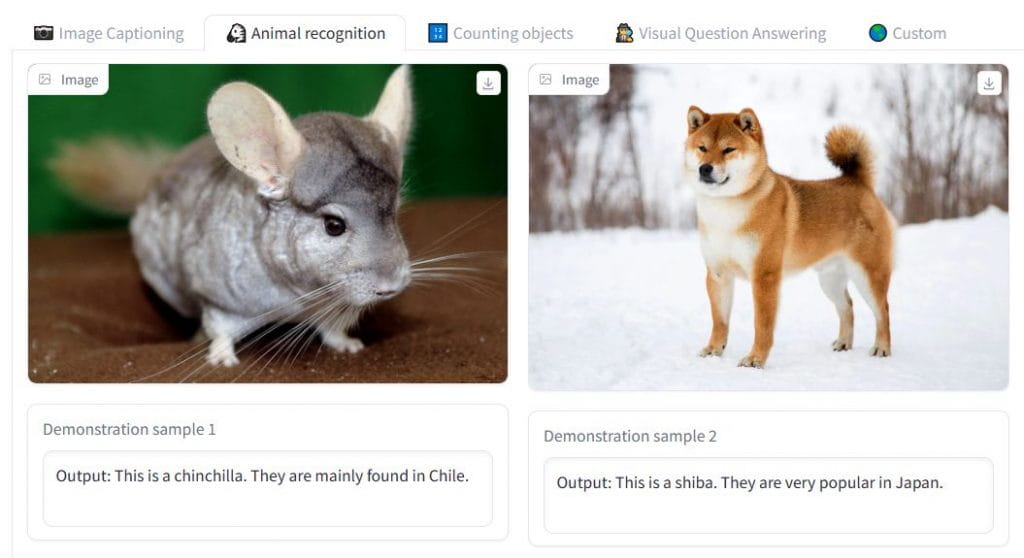

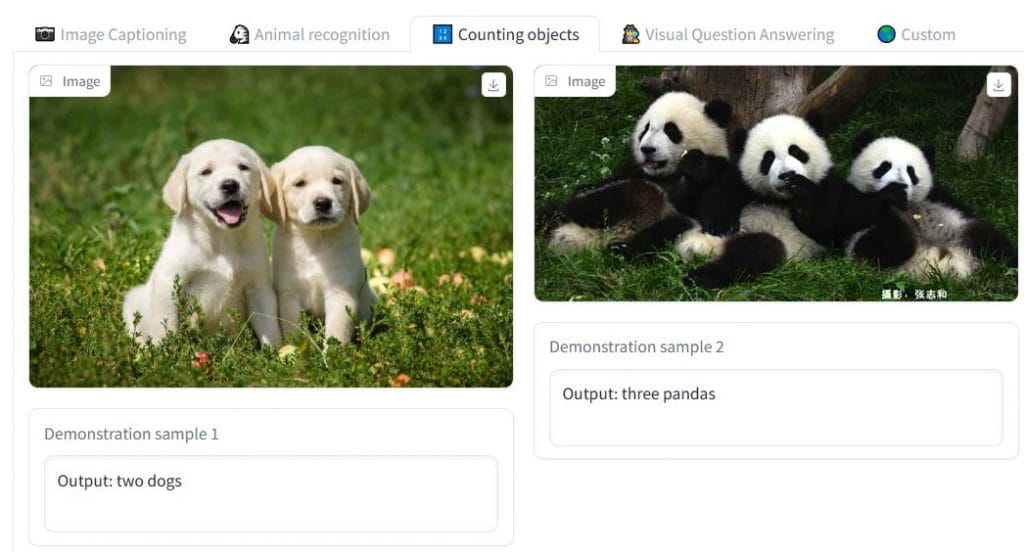

Ein Maßstab für die kontextbezogene Lernbewertung von Aktivitäten, die Sehen und Sprache einschließen.

Eine vorläufige Version unseres LLaMA-basierten OpenFlamingo-9B-Modells.

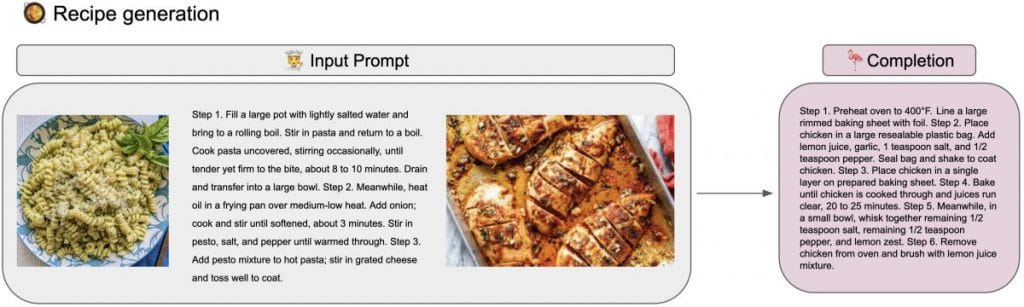

Mit OpenFlamingo hoffen die Entwickler, ein multimodales System zu schaffen, das eine Vielzahl von Herausforderungen im Bereich der Bildsprache bewältigen kann. Das ultimative Ziel ist es, die Stärke und Anpassungsfähigkeit von GPT-4 bei der Verarbeitung von visuellen und Texteingaben zu erreichen. Um dieses Ziel zu erreichen, entwickeln die Entwickler eine Open-Source-Version von DeepMinds Flamingo-Modell, einem LMM, das Bilder, Videos und Texte verarbeiten und darüber nachdenken kann. Die Entwickler haben sich der Entwicklung vollständiger Open-Source-Modelle verschrieben, weil sie der Meinung sind, dass Transparenz entscheidend ist, um die Zusammenarbeit zu fördern, die Entwicklung zu beschleunigen und den Zugang zu hochmodernen LMMs zu demokratisieren.

Sie stellen den ersten Kontrollpunkt unseres OpenFlamingo-9B-Modells bereit. Obwohl das Modell noch nicht vollständig optimiert ist, zeigt es, wie vielversprechend das Projekt ist. Entwickler können bessere LMMs trainieren, indem sie zusammenarbeiten und Feedback von der Community erhalten. Sie laden die Öffentlichkeit ein, Input zu geben und das Repository zu ergänzen, um am Entwicklungsprozess teilzunehmen.

Die Implementierung ähnelt stark der von Flamingo. Flamingo-Modelle müssen anhand großer Web-Datensätze mit verschachtelten Texten und Grafiken trainiert werden, um sie mit kontextbezogenen Lernfähigkeiten für wenige Versuche auszustatten. In OpenFlamingo ist dieselbe Architektur implementiert, die in der ursprünglichen Flamingo-Studie vorgeschlagen wurde (Perceiver-Resampler, Cross-Attention-Ebenen). Da die Trainingsdaten von Flamingo jedoch nicht öffentlich zugänglich sind, verwenden Entwickler Open-Source-Datensätze, um Modelle zu trainieren. Der neu veröffentlichte OpenFlamingo-9B-Checkpoint wurde speziell anhand von 10 Millionen Proben aus LAION-2B und 5 Millionen Proben aus dem neuen Multimodal-C4-Datensatz trainiert.

Die Entwickler haben in die Veröffentlichung auch einen Checkpoint unseres unfertigen LMM OpenFlamingo-9B aufgenommen, das auf LLaMA 7B und CLIP ViT/L-14 basiert. Auch wenn dieses Konzept noch in der Entwicklung ist, kann die Community bereits jetzt stark davon profitieren.

Sehen Sie sich zunächst die GitHub-Quelle und -Demo an.

Lesen Sie mehr zum Thema KI:

Die Trainingskosten für KI-Modelle werden bis 2030 voraussichtlich von 100 auf 500 Millionen US-Dollar steigen

DeepMinds neue adaptive KI-Agentin Ada ist fast so intelligent wie ein Mensch

DeepMind hat das KI-Tool Dramatron veröffentlicht, das einen vollständigen Entwurf eines Drehbuchs für einen Film oder eine Fernsehsendung erstellt

Der Beitrag „OpenFlamingo: Ein neues Open-Source-Bild-zu-Text-Framework von Meta AI und LAION“ erschien zuerst auf Metaverse Post.