Das Problem, das in dem Artikel „XLM-V: Überwindung des Wortschatzengpasses in mehrsprachigen maskierten Sprachmodellen“ angesprochen wird, besteht darin, dass die Größe des Wortschatzes unverändert bleibt, wenn die Parameter und die Tiefe der Sprachmodelle zunehmen. Beispielsweise hat das mT5-Modell 13 Milliarden Parameter, aber einen Wortschatz von 250.000 Wörtern, der mehr als 100 Sprachen unterstützt. Somit hat jede Sprache ungefähr 2.500 einzigartige Token, was offensichtlich eine sehr kleine Zahl ist.

@Midjourney/Shalv

@Midjourney/Shalv

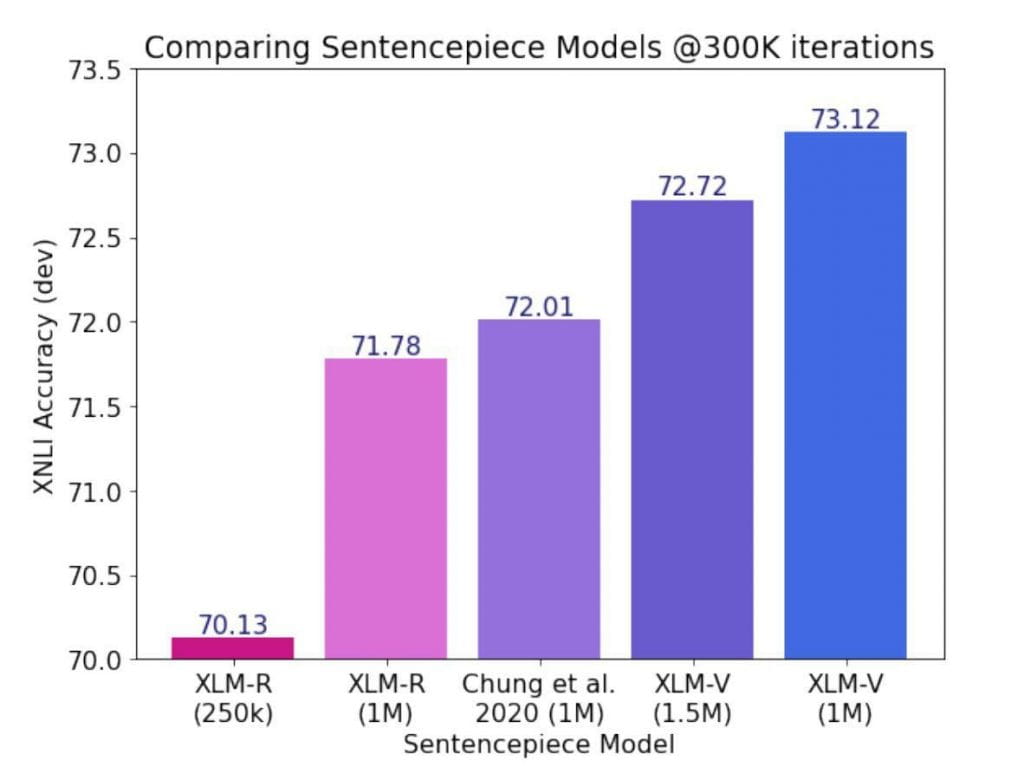

Welche Maßnahmen ergreifen die Autoren? Sie beginnen auf unerwartete Weise mit dem Training eines neuen Modells mit 1 Million Token aus dem Vokabular. XLM-R existierte zuvor, wird jedoch mit diesem Upgrade zu XLM-V. Die Autoren waren entschlossen herauszufinden, welche Art von Verbesserung sie mit einer so deutlichen Erhöhung der Token erzielen könnten.

Verwandter Artikel: Die Trainingskosten für KI-Modelle werden bis 2030 voraussichtlich von 100 Millionen auf 500 Millionen Dollar steigen

Was ist an XLM-V neu, was bei XLM-R nicht der Fall war?

Die Methode „Verbesserung mehrsprachiger Modelle mit sprachgeclusterten Vokabularen“ wird verwendet, um lexikalische Darstellungsvektoren für jede Sprache wie folgt zu konstruieren: Für jede Sprache im Satz von Sprachen bilden sie einen binären Vektor, dessen jedes Element ein bestimmtes Wort in der Sprache ist. Eins gibt an, dass das Wort im Wörterbuch der Sprache enthalten ist (Sie können ein Bild mit einer grafischen Beschreibung in den Anhängen sehen). Indem die Autoren jedoch einen Vektor erstellen, der die negative logarithmische Wahrscheinlichkeit des Auftretens jedes Lexems nutzt, verbessern sie die Art und Weise, wie Referenzen erstellt werden.

Anschließend werden die Vektoren gruppiert. Zusätzlich wird an jedem einzelnen Cluster ein Satzteilmodell trainiert, um den Transfer von Vokabeln zwischen lexikalisch nicht verwandten Sprachen zu verhindern.

Das ALP beurteilt die Fähigkeit eines Wörterbuchs, eine bestimmte Sprache darzustellen.

Der nächste Schritt besteht in der Verwendung des Algorithmus zum Erstellen von ULM-Wörterbüchern. Dabei wird mit einem großen Anfangswörterbuch begonnen und dieses schrittweise verkleinert, bis die Anzahl der Token unter einem bestimmten Schwellenwert für die Wörterbuchgröße liegt.

Lesen Sie mehr zum Thema KI:

Top 120+ KI-generierte Inhalte im Jahr 2023: Bilder, Musik, Videos

Die 10 besten KI-gestützten SEO-Tools im Jahr 2023 für digitale Vermarkter

Top 10 Mobile AI Art Generator Apps im Jahr 2023 für Android und iOS

Der Beitrag „XLM-V: Eine neue Methode mehrsprachiger maskierter Sprachmodelle, die das Problem des Wortschatzengpasses zu lösen versucht“ erschien zuerst auf Metaverse Post.