Právě byla vydána open-source verze modelu Flamingo od DeepMind, OpenFlamingo. OpenFlamingo je v zásadě rámec, který umožňuje školení a hodnocení velkých multimodálních modelů (LMM). OpenFlamingo je postaveno na velkém jazykovém modelu LLaMA vyvinutém Meta AI.

Přečtěte si více: Jak používat Midjourney zdarma navždy: 5 jednoduchých kroků

Přečtěte si více: Jak používat Midjourney zdarma navždy: 5 jednoduchých kroků

Příspěvky vývojářů k tomuto prvnímu vydání jsou následující:

Rozsáhlá multimodální datová sada, která kombinuje textové a vizuální sekvence.

Referenční měřítko pro evaluaci učení v kontextu pro činnosti včetně vize a jazyka.

Předběžná verze našeho modelu OpenFlamingo-9B založeného na LLaMA.

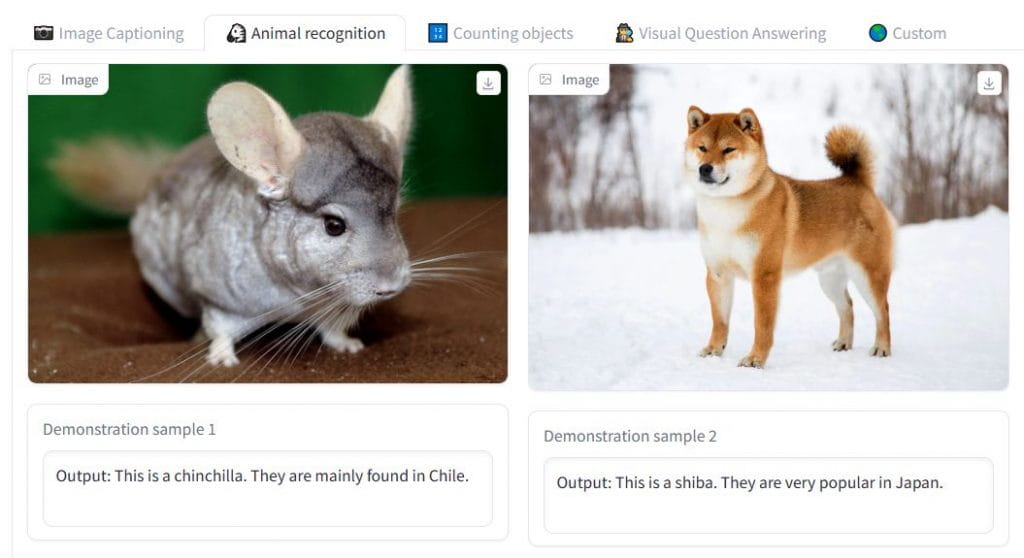

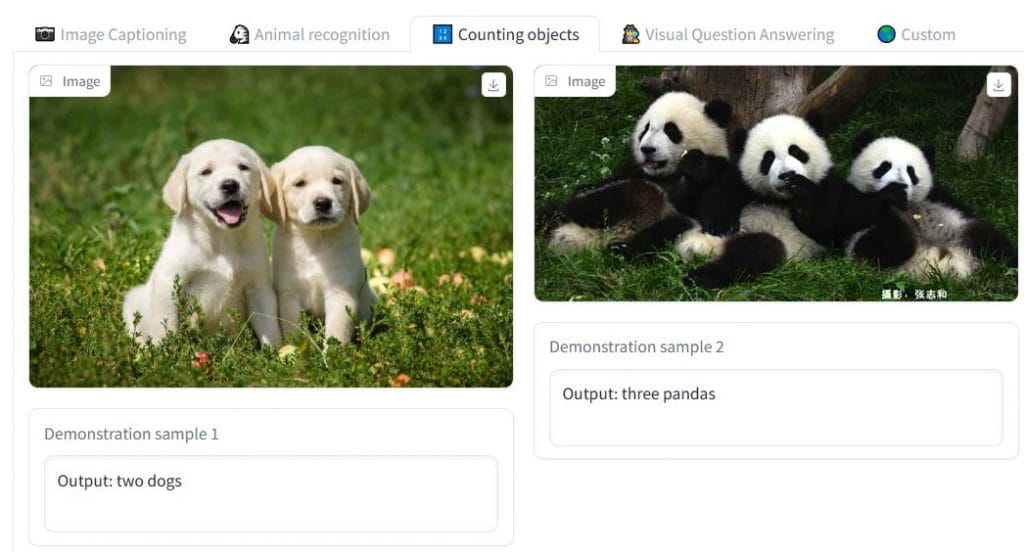

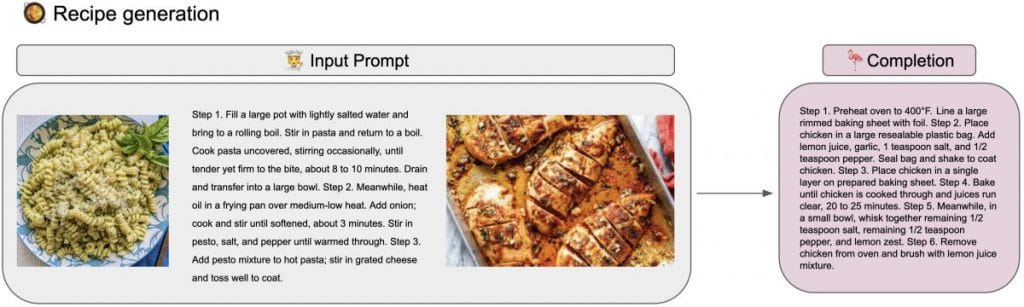

Vývojáři doufají, že prostřednictvím OpenFlamingo vytvoří multimodální systém, který zvládne různé výzvy v oblasti vizuálního jazyka. Konečným cílem je vyrovnat se síle a přizpůsobivosti GPT-4 při zpracování vizuálního a textového vstupu. Vývojáři vyvíjejí open-source verzi modelu Flamingo od DeepMind, LMM schopného zpracovávat obrázky, videa a text a uvažovat o nich, aby tohoto cíle dosáhli. Vývojáři se věnují vývoji zcela open-source modelů, protože si myslí, že transparentnost je zásadní pro podporu spolupráce, urychlení vývoje a demokratizaci přístupu k nejmodernějším LMM.

Poskytují počáteční kontrolní bod našeho modelu OpenFlamingo-9B. Přestože model ještě není zcela optimalizován, ukazuje příslib projektu. Vývojáři mohou trénovat lepší LMM díky spolupráci a získávání zpětné vazby od komunity. Vyzývají veřejnost, aby poskytla informace a přidala do úložiště, aby se mohla zúčastnit procesu vývoje.

Implementace se velmi podobá implementaci Flaminga. Modely plameňáků musí být trénovány na rozsáhlých webových datových sadách s prokládaným textem a grafikou, aby se vybavily dovednostmi v kontextu několika výukových dovedností. Stejná architektura, která byla navržena v původní studii Flamingo (Perceiver resamplery, cross-attention vrstvy) je implementována v OpenFlamingo. Ale protože tréninková data Flaminga nejsou přístupná široké veřejnosti, vývojáři používají k trénování modelů open source datové sady. Nově publikovaný kontrolní bod OpenFlamingo-9B byl speciálně trénován na 10M vzorcích z LAION-2B a 5M vzorcích z nového Multimodal C4 datasetu.

Vývojáři také zahrnují kontrolní bod z našeho nedokončeného LMM OpenFlamingo-9B, který je založen na LLaMA 7B a CLIP ViT/L-14 jako součást vydání. I když se tento koncept stále vyvíjí, komunita z něj již může mít velký užitek.

Chcete-li začít, podívejte se na zdroj a demo GitHub.

Přečtěte si více o AI:

Očekává se, že náklady na školení AI Model do roku 2030 vzrostou ze 100 milionů USD na 500 milionů USD

Nová adaptivní AI Agentka DeepMind Ada je téměř stejně inteligentní jako člověk

DeepMind vydala nástroj AI Dramatron, který generuje plnohodnotný návrh scénáře filmu nebo televizního pořadu

The post OpenFlamingo: Nový Open-Source Image-to-Text Framework od Meta AI a LAION appeared first on Metaverse Post.