Více než 2 600 technologických lídrů a výzkumníků podepsalo otevřený dopis, v němž naléhali na dočasnou „pauzu“ v dalším vývoji umělé inteligence (AI), z obavy „hlubokých rizik pro společnost a lidstvo“.

Generální ředitel Tesly Elon Musk, spoluzakladatel Applu Steve Wozniak a řada generálních ředitelů, CTO a výzkumníků AI byli mezi signatáři dopisu, jehož autorem byl americký think-tank Future of Life Institute (FOLI) z 22. března.

Institut vyzval všechny společnosti zabývající se umělou inteligencí, aby „okamžitě pozastavily“ školení systémů umělé inteligence, které jsou výkonnější než GPT-4, po dobu nejméně šesti měsíců, přičemž sdílí obavy, že „lidská konkurenční inteligence může představovat mimo jiné hluboká rizika pro společnost a lidstvo“. :

„Pokročilá umělá inteligence by mohla představovat hlubokou změnu v historii života na Zemi a měla by být plánována a řízena s přiměřenou péčí a zdroji. Bohužel k této úrovni plánování a řízení nedochází,“ napsal ústav ve svém dopise.

GPT-4 je nejnovější iterací chatbota OpenAI poháněného umělou inteligencí, který byl vydán 14. března. K dnešnímu dni složil některé z nejpřísnějších amerických středních škol a právnických zkoušek v rámci 90. percentilu. Rozumí se, že je 10krát pokročilejší než původní verze ChatGPT.

Mezi firmami zabývajícími se umělou inteligencí probíhá „závod mimo kontrolu“ ve vývoji výkonnější umělé inteligence, kterou „nikdo – ani jejich tvůrci – nemůže pochopit, předvídat nebo spolehlivě ovládat,“ tvrdil FOLI.

Mezi hlavní obavy patřilo, zda by stroje mohly zaplavit informační kanály, potenciálně „propagandou a nepravdou“ a zda stroje „zautomatizují“ všechny pracovní příležitosti.

FOLI posunul tyto obavy ještě o krok dále a naznačil, že podnikatelské úsilí těchto společností s umělou inteligencí může vést k existenční hrozbě:

„Měli bychom vyvinout nelidské mysli, které by nás nakonec mohly převýšit, přechytračit, zastaraly a nahradit nás? Měli bychom riskovat ztrátu kontroly nad naší civilizací?"

"Taková rozhodnutí nesmí být delegována na nevolené technologické lídry," dodal dopis.

Institut také souhlasil s nedávným prohlášením zakladatele OpenAI Sama Altmana, že před školením budoucích systémů umělé inteligence může být vyžadována nezávislá revize.

Altman ve svém příspěvku na blogu z 24. února zdůraznil potřebu připravit se na roboty s umělou obecnou inteligencí (AGI) a umělou superinteligencí (ASI).

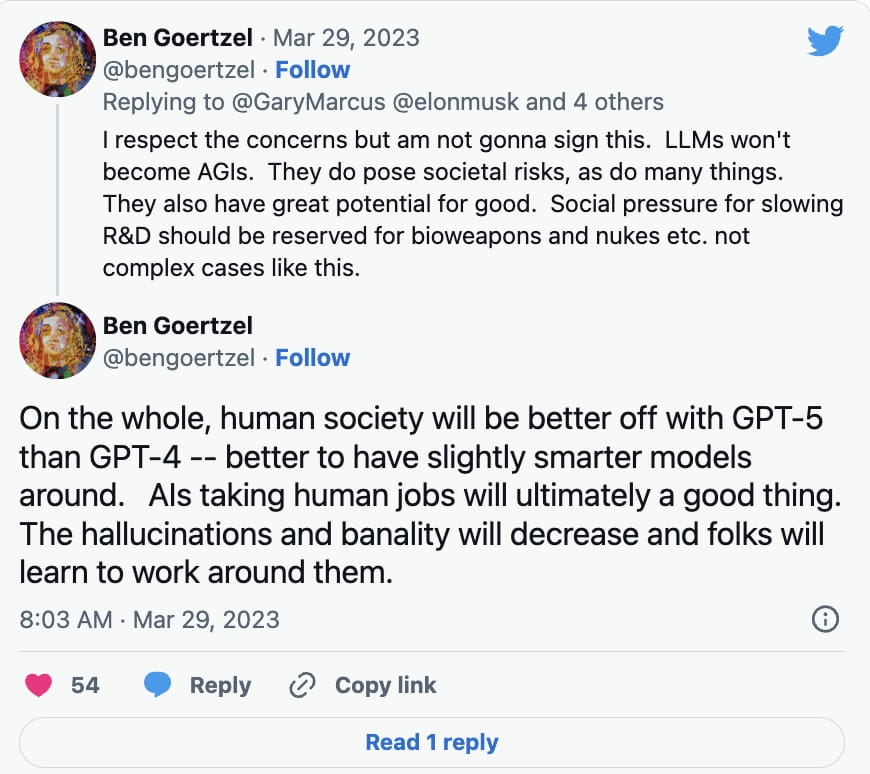

Ne všichni učenci AI však s podpisem petice spěchali. Ben Goertzel, generální ředitel SingularityNET, v odpovědi na Twitteru z 29. března Garymu Marcusovi, autorovi Rebooting.AI, vysvětlil, že modely jazykového vzdělávání (LLM) se nestanou AGI, které se dosud jen málo vyvíjely.

Místo toho řekl, že výzkum a vývoj by měl být zpomalen pro věci, jako jsou biologické zbraně a jaderné zbraně:

Kromě modelů výuky jazyků, jako je ChatGPT, byla k vytváření přesvědčivých obrazů, zvukových a video podvodů použita technologie deep fake využívající umělou inteligenci. Tato technologie byla také použita k vytvoření uměleckých děl generovaných umělou inteligencí, přičemž se objevily určité obavy, zda by v určitých případech nemohla porušovat zákony o autorských právech.

Generální ředitel společnosti Galaxy Digital Mike Novogratz nedávno řekl investorům, že byl šokován množstvím regulační pozornosti, která byla věnována kryptoměnám, zatímco umělé inteligenci byla věnována jen malá pozornost.

„Když přemýšlím o AI, šokuje mě, že tolik mluvíme o regulaci kryptoměn a nic o regulaci AI. Myslím, myslím, že to vláda postavila úplně naruby,“ uvedl během telefonátu akcionářů 28. března.

FOLI tvrdilo, že pokud by pauza ve vývoji umělé inteligence nebyla uzákoněna rychle, vlády by se měly zapojit do moratoria.

„Tato pauza by měla být veřejná a ověřitelná a měla by zahrnovat všechny klíčové aktéry. Pokud takovou pauzu nelze uzákonit rychle, vlády by měly zasáhnout a zavést moratorium,“ napsalo.